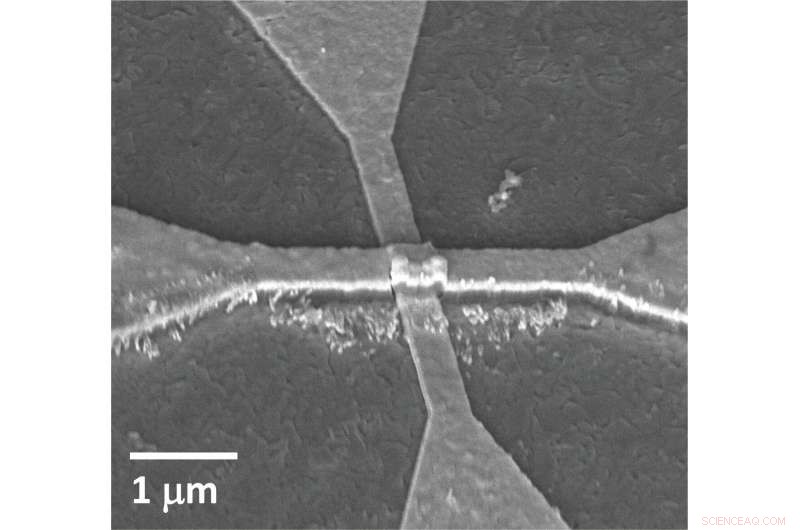

Immagine SEM del dispositivo del neurone artificiale. Credito:Sangheon Oh/Nature Nanotechnology

Addestrare le reti neurali per eseguire compiti, come riconoscere immagini o navigare in auto a guida autonoma, potrebbe un giorno richiedere meno potenza di calcolo e hardware grazie a un nuovo dispositivo di neuroni artificiali sviluppato dai ricercatori dell'Università della California a San Diego. Il dispositivo può eseguire calcoli di rete neurale utilizzando da 100 a 1000 volte meno energia e area rispetto all'hardware esistente basato su CMOS.

I ricercatori riportano il loro lavoro in un articolo pubblicato il 18 marzo in Nanotecnologia della natura .

Le reti neurali sono una serie di strati collegati di neuroni artificiali, dove l'output di uno strato fornisce l'input al successivo. La generazione di tale input viene eseguita applicando un calcolo matematico chiamato funzione di attivazione non lineare. Questa è una parte fondamentale dell'esecuzione di una rete neurale. Ma l'applicazione di questa funzione richiede molta potenza di calcolo e circuiti perché comporta il trasferimento di dati avanti e indietro tra due unità separate:la memoria e un processore esterno.

Ora, I ricercatori dell'UC San Diego hanno sviluppato un dispositivo di dimensioni nanometriche in grado di svolgere in modo efficiente la funzione di attivazione.

"I calcoli della rete neurale nell'hardware diventano sempre più inefficienti man mano che i modelli di rete neurale diventano più grandi e più complessi, " disse Duygu Kuzum, un professore di ingegneria elettrica e informatica presso la UC San Diego Jacobs School of Engineering. "Abbiamo sviluppato un singolo dispositivo di neuroni artificiali su nanoscala che implementa questi calcoli nell'hardware in un modo molto efficiente in termini di area ed energia".

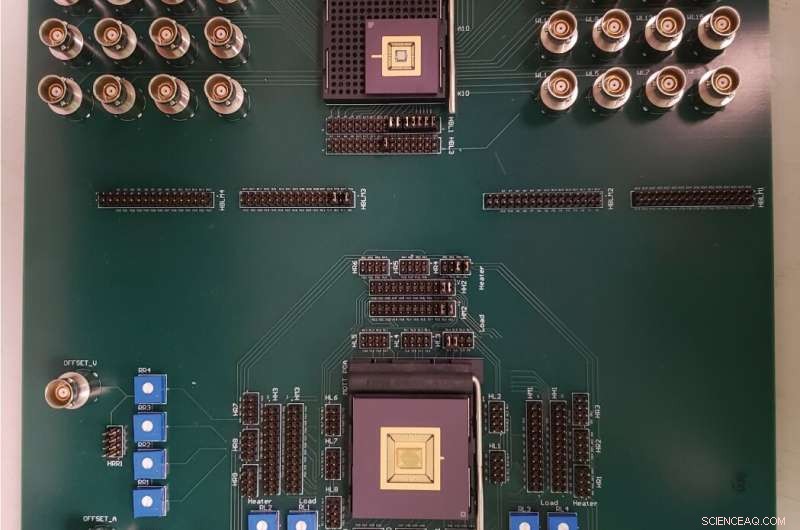

Un circuito stampato personalizzato costruito con una serie di dispositivi di attivazione (o neuroni) e una serie di dispositivi sinaptici. Credito:Sangheon Oh/Nature Nanotechnology

Il nuovo studio, guidato da Kuzum e dal suo dottorato di ricerca. studente Sangheon Oh, è stato eseguito in collaborazione con un DOE Energy Frontier Research Center guidato dal professore di fisica dell'UC San Diego Ivan Schuller, che si concentra sullo sviluppo di implementazioni hardware di reti neurali artificiali ad alta efficienza energetica.

Il dispositivo implementa una delle funzioni di attivazione più comunemente utilizzate nell'addestramento della rete neurale chiamata unità lineare rettificata. La particolarità di questa funzione è che necessita di hardware che possa subire un graduale cambiamento di resistenza per funzionare. Ed è esattamente ciò per cui i ricercatori della UC San Diego hanno progettato il loro dispositivo:può passare gradualmente da uno stato isolante a uno stato conduttivo, e lo fa con l'aiuto di un po' di calore.

Questo interruttore è quello che viene chiamato una transizione Mott. Si svolge in uno strato sottile di nanometri di biossido di vanadio. Sopra questo strato c'è un riscaldatore a nanofili in titanio e oro. Quando la corrente scorre attraverso il nanofilo, lo strato di biossido di vanadio si riscalda lentamente, provocando un lento, interruttore controllato da isolante a conduttore.

"Questa architettura del dispositivo è molto interessante e innovativa, " ha detto ah, chi è il primo autore dello studio. Tipicamente, i materiali in una transizione di Mott subiscono un brusco passaggio da isolante a conduttore perché la corrente scorre direttamente attraverso il materiale, Lui ha spiegato. "In questo caso, facciamo scorrere la corrente attraverso un nanofilo sopra il materiale per riscaldarlo e indurre un cambiamento di resistenza molto graduale".

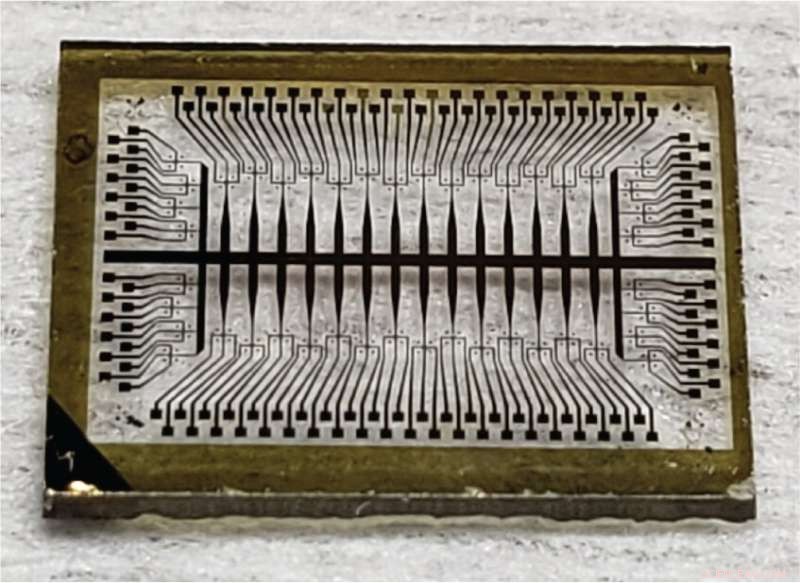

Un array dei dispositivi di attivazione (o neurone). Credito:Sangheon Oh/Nature Nanotechnology

Per implementare il dispositivo, i ricercatori hanno prima fabbricato una serie di questi cosiddetti dispositivi di attivazione (o neuroni), insieme a un array di dispositivi sinaptici. Quindi hanno integrato i due array su un circuito stampato personalizzato e li hanno collegati tra loro per creare una versione hardware di una rete neurale.

I ricercatori hanno utilizzato la rete per elaborare un'immagine, in questo caso, una foto della Biblioteca Geisel all'Università di San Diego. La rete ha eseguito un tipo di elaborazione delle immagini chiamata rilevamento dei bordi, che identifica i contorni oi bordi degli oggetti in un'immagine. Questo esperimento ha dimostrato che il sistema hardware integrato può eseguire operazioni di convoluzione essenziali per molti tipi di reti neurali profonde.

I ricercatori affermano che la tecnologia potrebbe essere ulteriormente ampliata per svolgere compiti più complessi come il riconoscimento facciale e di oggetti nelle auto a guida autonoma. Con l'interesse e la collaborazione dell'industria, questo potrebbe accadere, ha notato Kuzum.

"Proprio adesso, questa è una prova del concetto, " Kuzum ha detto. "È un piccolo sistema in cui abbiamo accatastato solo uno strato di sinapsi con uno strato di attivazione. Impilando più di questi insieme, potresti creare un sistema più complesso per diverse applicazioni."