Credito:Oliver, Lanillos e Cheng.

Una sfida chiave per i ricercatori di robotica è lo sviluppo di sistemi in grado di interagire con gli esseri umani e l'ambiente circostante in situazioni che comportano vari gradi di incertezza. Infatti, mentre gli esseri umani possono imparare continuamente dalle loro esperienze e percepire il loro corpo come un tutt'uno mentre interagiscono con il mondo, i robot non hanno ancora queste capacità.

I ricercatori dell'Università tecnica di Monaco hanno recentemente condotto uno studio ambizioso in cui hanno cercato di applicare "l'inferenza attiva, " un costrutto teorico che descrive la capacità di unire percezione e azione, a un robot umanoide. Il loro studio fa parte di un più ampio progetto finanziato dall'UE chiamato SELFCEPTION, che collega robotica e psicologia cognitiva con l'obiettivo di sviluppare robot più percettivi.

"La domanda di ricerca originale che ha dato il via a questo lavoro era quella di fornire ai robot umanoidi e agli agenti artificiali in generale la capacità di percepire il proprio corpo come fanno gli umani, "Pablo Lanillos, uno dei ricercatori che ha condotto lo studio, ha detto a TechXplore. "L'obiettivo principale era migliorare le loro capacità di interagire in condizioni di incertezza. Sotto l'ombrello del progetto Selfception.eu Marie Skłodowska-Curie abbiamo inizialmente definito una tabella di marcia per includere alcune caratteristiche della percezione e dell'azione umana nei robot".

Nel loro studio, Lanillos e i suoi colleghi hanno cercato di comprendere meglio la percezione umana e poi l'hanno modellata in un robot umanoide. Questo si è rivelato un compito molto difficile, quanti più dettagli di come le informazioni sensoriali (visive, tattile, ecc.) viene elaborato dall'uomo sono ancora sconosciuti. I ricercatori hanno tratto ispirazione dal lavoro di Hermann Von Helmholtz e Karl Friston, in particolare dalla loro teoria dell'inferenza attiva, che è tra i costrutti neuroscientifici più influenti.

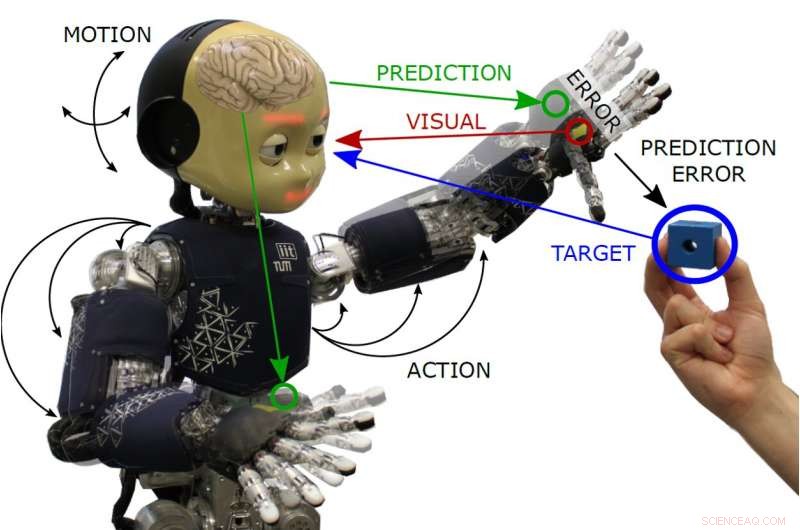

"In sostanza, proponiamo che il robot si avvicini continuamente al suo corpo usando i suoi modelli appresi imperfetti, "Guillermo Oliver, un altro ricercatore coinvolto nello studio, ha detto a TechXplore. "L'algoritmo basato sul principio dell'energia libera, presenta la percezione e l'azione che lavorano per un obiettivo comune:ridurre l'errore di previsione. In questo approccio, l'azione fa in modo che i dati sensoriali corrispondano meglio alla previsione fatta dal modello interno."

Lanillos, Oliver e il Prof. Gordon Cheng furono i primi ad applicare l'inferenza attiva a un vero robot. Infatti, finora, l'inferenza attiva è stata testata solo teoricamente o in simulazioni parzialmente distorte dalla semplificazione dei modelli utilizzati.

Il loro approccio cerca di riprodurre la capacità degli umani di cambiare le loro azioni (ad esempio la loro andatura) in particolari situazioni, ad esempio, quando si avvicinano a una scala mobile della metropolitana, ma scoprono improvvisamente che è rotto o fuori servizio, e adattare i loro movimenti di conseguenza. L'algoritmo di percezione e controllo sviluppato da Lanillos, Oliver e Cheng replicano un meccanismo simile nei robot.

Per esempio, in un compito di portata in cui un robot ha bisogno di toccare un oggetto, il modello crea un errore nella posizione della mano desiderata che attiva un'azione verso l'oggetto. L'equilibrio (o minimizzazione) si ottiene quando la mano del robot e l'oggetto si trovano nella stessa posizione.

"Questo approccio è raro nella comunità della robotica, ma fornisce trattabilità, consente la combinazione di informazioni sensoriali provenienti da diverse fonti e consente la regolazione dell'affidabilità di ciascuna informazione del sensore, a seconda della precisione, " ha detto Oliviero.

I ricercatori hanno applicato il loro algoritmo a iCub, un robot umanoide cognitivo open source sviluppato come parte di un altro progetto finanziato dall'UE, e ha valutato le sue prestazioni in compiti che prevedevano il raggiungimento del doppio braccio e il monitoraggio attivo della testa. Nei loro test, il robot è stato in grado di eseguire comportamenti di raggiungimento avanzati e robusti, così come il tracciamento attivo della testa degli oggetti nel suo campo visivo.

"Il robot umanoide è stato in grado di eseguire robusti compiti di raggiungimento del doppio braccio e di tracciamento visivo di un oggetto utilizzando lo stesso modello matematico, " ha detto Oliver. "Con questo tipo di algoritmo, vorremmo cambiare la visione attuale della pipeline di percezione input-output (ad esempio reti neurali all'avanguardia) rafforzando l'idea della percezione a circuito chiuso, dove i passaggi avanti e indietro vengono elaborati online, e includendo l'azione come un'altra variabile inevitabile."

Lanillos, Oliver e Cheng sono i primi a implementare un modello basato sul principio dell'energia libera su un vero robot umanoide. I loro risultati suggeriscono che è possibile convalidare tali modelli in contesti del mondo reale, così come analizzare i vantaggi di questi modelli in presenza di informazioni sensoriali rumorose, occlusioni o quando sono disponibili solo informazioni parziali. I ricercatori stanno ora pianificando di applicare il loro modello ad altri robot e testarne la generalizzabilità.

"A lungo termine, vogliamo consentire lo sviluppo di agenti artificiali con le stesse capacità di adattamento corporeo e interazione degli umani, " disse Lanillos. "Nel frattempo, stiamo sviluppando nuovi algoritmi di intelligenza artificiale bio-ispirati. Nel futuro, useremo questo modello anche per indagare sulla proprietà del corpo e sull'agenzia, e chi lo sa, un giorno potremmo consentire l'autoriconoscimento nelle macchine."

© 2019 Scienza X Rete