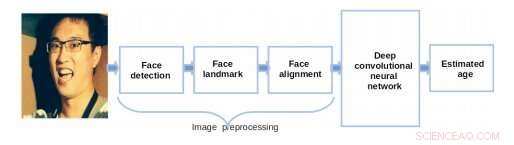

Un diagramma del sistema di stima dell'età proposto. Credito:Agbo-Ajala &Viriri.

Negli ultimi anni, i ricercatori hanno creato un numero crescente di tecniche di riconoscimento facciale basate sull'apprendimento automatico (ML), che potrebbe avere numerose interessanti applicazioni, ad esempio, migliorare il monitoraggio della sorveglianza, controllo di sicurezza, e potenzialmente anche forense art. Oltre al riconoscimento facciale, i progressi nel machine learning hanno anche consentito lo sviluppo di strumenti per prevedere o stimare qualità specifiche (ad es. sesso o età) di una persona analizzando le immagini dei loro volti.

In un recente studio, ricercatori dell'Università del Kwazulu-Natal, in Sud Africa, ha sviluppato un modello basato sull'apprendimento automatico per stimare l'età delle persone analizzando le immagini dei loro volti scattate in ambienti casuali della vita reale. Questa nuova architettura è stata introdotta in un paper pubblicato da Spinger e presentato pochi giorni fa alla International Conference on Computational Collective Intelligence (ICCCI) 2019.

La maggior parte degli approcci tradizionali per la classificazione dell'età si comporta bene solo quando si analizzano le immagini del viso scattate in ambienti controllati, ad esempio, in laboratorio o negli studi fotografici. D'altra parte, pochissimi di questi sono in grado di stimare l'età delle persone nelle immagini scattate in contesti reali di vita quotidiana.

"I metodi di deep learning si sono dimostrati efficaci nel risolvere questo problema, soprattutto con la disponibilità sia di una grande quantità di dati per l'addestramento che di macchine di fascia alta, " hanno scritto i ricercatori nel loro articolo. "In considerazione di ciò, proponiamo una soluzione di deep learning per stimare l'età da volti reali."

Il team di ricercatori dell'Università del Kwazulu-Natal ha sviluppato un'architettura basata su una rete neurale convoluzionale profonda (CNN) con sei strati. Il loro modello è stato addestrato per stimare l'età degli individui da immagini di volti scattate in ambienti non controllati. L'architettura raggiunge questo obiettivo imparando quali rappresentazioni facciali sono più cruciali per la stima dell'età e concentrandosi su queste particolari caratteristiche.

La fase di pre-elaborazione dell'immagine. Credito:Agbo-Ajala &Viriri.

Per migliorare le prestazioni del loro modello basato sulla CNN, i ricercatori lo hanno preaddestrato su un grande set di dati chiamato IMDB-WIKI, che contiene oltre mezzo milione di immagini di volti prese da IMDB e Wikipedia, etichettato con l'età di ogni soggetto. Questa formazione iniziale ha permesso loro di adattare la loro architettura al contenuto dell'immagine.

Successivamente, i ricercatori hanno messo a punto il modello utilizzando immagini di altri due database, vale a dire MORPH-II e OUI-Adience, allenandolo a cogliere peculiarità e differenze. MORPH-II contiene circa 70, 000 immagini etichettate di volti, mentre OUI-Adience ne contiene 26, 580 immagini del viso scattate in ambienti reali ideali.

Quando hanno valutato il loro modello su immagini scattate in ambienti non controllati, i ricercatori hanno scoperto che questa formazione estesa ha portato a prestazioni notevoli. Il loro modello ha ottenuto risultati all'avanguardia, superando molti altri metodi basati sulla CNN per la stima dell'età.

"I nostri esperimenti dimostrano l'efficacia del nostro metodo per la stima dell'età in natura quando valutato sul benchmark OUI-Adience, che è noto per contenere immagini di volti acquisiti in condizioni ideali e non vincolate, " hanno scritto i ricercatori. "Il metodo di classificazione dell'età proposto raggiunge nuovi risultati all'avanguardia, con un miglioramento della precisione dell'8,6 percento (esatto) e del 3,4 percento (una tantum) rispetto al miglior risultato riportato sul set di dati OUI-Adience."

Nel futuro, la nuova architettura basata sulla CNN sviluppata da questi ricercatori potrebbe consentire implementazioni più efficaci della stima dell'età in una varietà di contesti della vita reale. Il team prevede inoltre di aggiungere livelli al modello e addestrarlo su altri set di dati di immagini del viso scattate in ambienti non controllati non appena saranno disponibili, al fine di migliorarne ulteriormente le prestazioni.

© 2019 Scienza X Rete