Una configurazione di correlazione (in alto a sinistra) viene ridotta utilizzando una trasformazione block-cluster di nuova concezione (in alto a destra). Sia la configurazione originale che quella ridotta hanno una tecnica di stima migliorata applicata per fornire coppie di configurazioni di dimensioni diverse (riga in basso). Utilizzando queste coppie di allenamento, una CNN può imparare a convertire piccoli modelli in grandi, ottenere una trasformazione RG inversa di successo. Credito:Università metropolitana di Tokyo

I ricercatori della Tokyo Metropolitan University hanno migliorato le tecniche di apprendimento automatico "super-risoluzione" per studiare le transizioni di fase. Hanno identificato le caratteristiche chiave di come si comportano grandi array di particelle interagenti a diverse temperature simulando piccoli array prima di utilizzare una rete neurale convoluzionale per generare una buona stima di come sarebbe un array più grande utilizzando le configurazioni di correlazione. L'enorme risparmio nei costi computazionali può realizzare modi unici di capire come si comportano i materiali.

Siamo circondati da diversi stati o fasi della materia, cioè gas, liquidi, e solidi. Lo studio delle transizioni di fase, come una fase si trasforma in un'altra, è al centro della nostra comprensione della materia nell'universo, e rimane un argomento caldo per i fisici. In particolare, l'idea di universalità, in cui materiali molto diversi si comportano in modo simile grazie a poche caratteristiche condivise, è potente. Ecco perché i fisici studiano i sistemi modello, spesso semplici griglie di particelle su un array che interagiscono tramite semplici regole. Questi modelli distillano l'essenza della fisica comune condivisa dai materiali e, sorprendentemente, mostrano ancora molte delle proprietà dei materiali reali, come le transizioni di fase. Per la loro elegante semplicità, queste regole possono essere codificate in simulazioni che ci dicono come appaiono i materiali in condizioni diverse.

Però, come tutte le simulazioni, il problema inizia quando vogliamo guardare molte particelle contemporaneamente. Il tempo di calcolo richiesto diventa particolarmente proibitivo in prossimità delle transizioni di fase, dove la dinamica rallenta, e la lunghezza di correlazione, una misura di come lo stato di un atomo si relaziona allo stato di un altro a una certa distanza, diventa sempre più grande. Questo è un vero dilemma se vogliamo applicare questi risultati al mondo reale:i materiali reali generalmente contengono sempre molti più ordini di grandezza di atomi e molecole rispetto alla materia simulata.

Ecco perché un team guidato dai professori Yutaka Okabe e Hiroyuki Mori della Tokyo Metropolitan University, in collaborazione con i ricercatori dello Shibaura Institute of Technology e del Bioinformatics Institute di Singapore, hanno studiato come estrapolare in modo affidabile simulazioni più piccole a quelle più grandi utilizzando un concetto noto come gruppo di rinormalizzazione inverso (RG). Il gruppo di rinormalizzazione è un concetto fondamentale nella comprensione delle transizioni di fase e ha portato Wilson a ricevere il Premio Nobel per la Fisica nel 1982. Recentemente, il campo ha incontrato un potente alleato nelle reti neurali convoluzionali (CNN), lo stesso strumento di apprendimento automatico che aiuta la visione artificiale a identificare oggetti e decifrare la scrittura a mano. L'idea sarebbe quella di dare a un algoritmo lo stato di un piccolo array di particelle e farlo stimare come sarebbe un array più grande. C'è una forte analogia con l'idea di immagini ad alta risoluzione, dove blocchi, le immagini pixelate vengono utilizzate per generare immagini più uniformi a una risoluzione più elevata.

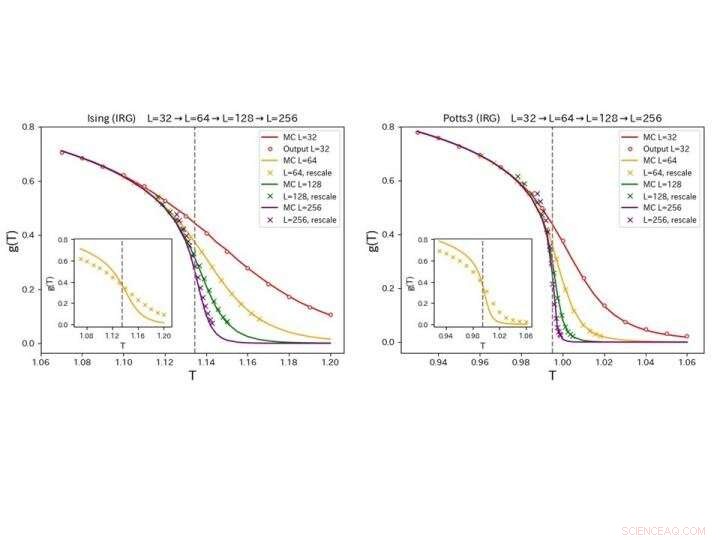

Le tendenze trovate dalle simulazioni di sistemi più grandi sono riprodotte fedelmente dalle CNN addestrate sia per i modelli Ising (a sinistra) che per quelli di Potts a tre stati (a destra). (riquadro) Il corretto ridimensionamento della temperatura si ottiene utilizzando dati di dimensioni arbitrarie del sistema. Credito:Università metropolitana di Tokyo

Il team ha esaminato come questo viene applicato a modelli di materia di rotazione, dove le particelle interagiscono con altre particelle vicine attraverso la direzione dei loro spin. I precedenti tentativi hanno particolarmente faticato ad applicare questo ai sistemi a temperature superiori a una transizione di fase, dove le configurazioni tendono a sembrare più casuali. Ora, invece di usare configurazioni di spin, cioè semplici istantanee della direzione in cui puntano gli spin delle particelle, hanno considerato configurazioni di correlazione, dove ogni particella è caratterizzata da quanto il suo spin sia simile a quello di altre particelle, in particolare quelli che sono molto lontani. Si scopre che le configurazioni di correlazione contengono code più sottili su come sono disposte le particelle, soprattutto a temperature più elevate.

Come tutte le tecniche di apprendimento automatico, la chiave è essere in grado di generare un set di allenamento affidabile. Il team ha sviluppato un nuovo algoritmo chiamato trasformazione block-cluster per le configurazioni di correlazione per ridurle a modelli più piccoli. Applicando una tecnica di stima migliorata sia ai modelli originali che a quelli ridotti, avevano coppie di configurazioni di dimensioni diverse basate sulle stesse informazioni. Non resta che addestrare la CNN a convertire i modelli piccoli in quelli più grandi.

Il gruppo ha considerato due sistemi, il modello 2D di Ising e il modello di Potts a tre stati, entrambi punti di riferimento chiave per gli studi sulla materia condensata. Per entrambi, hanno scoperto che la loro CNN potrebbe utilizzare una simulazione di una serie molto piccola di punti per riprodurre come una misura della correlazione g(T) è cambiata attraverso un punto di transizione di fase in sistemi molto più grandi. Confrontando le simulazioni dirette di sistemi più grandi, le stesse tendenze sono state riprodotte per entrambi i sistemi, combinato con un semplice ridimensionamento della temperatura basato su dati a una dimensione di sistema arbitraria.

Un'implementazione di successo delle trasformazioni RG inverse promette di dare agli scienziati un'idea delle dimensioni del sistema precedentemente inaccessibili, e aiutare i fisici a comprendere le caratteristiche su larga scala dei materiali. Il team ora spera di applicare il proprio metodo ad altri modelli in grado di mappare caratteristiche più complesse come una gamma continua di giri, così come lo studio dei sistemi quantistici.