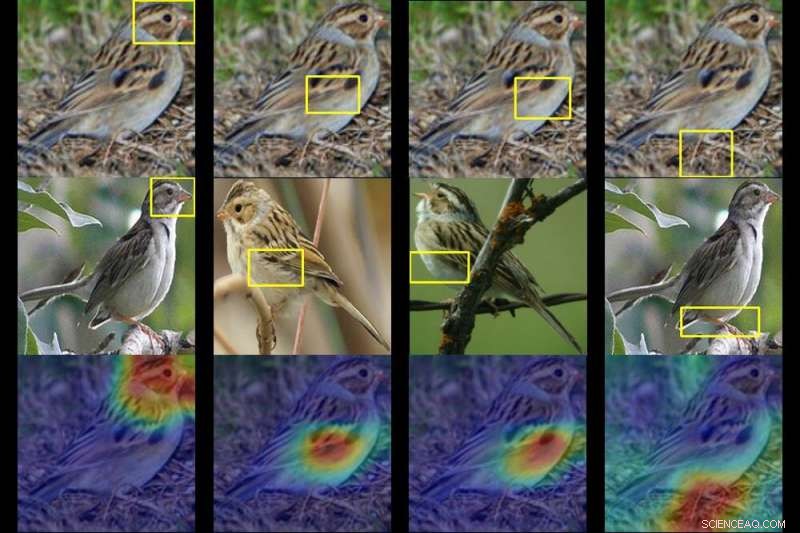

Un team di Duke ha addestrato un computer a identificare fino a 200 specie di uccelli da una semplice foto. Data una foto di un uccello misterioso (in alto), l'A.I. sputa mappe di calore che mostrano quali parti dell'immagine sono più simili alle caratteristiche tipiche delle specie che ha visto prima. Credito:Duke University

Possono essere necessari anni di esperienza nel birdwatching per distinguere una specie dall'altra. Ma usando una tecnica di intelligenza artificiale chiamata deep learning, I ricercatori della Duke University hanno addestrato un computer a identificare fino a 200 specie di uccelli da una semplice foto.

La vera innovazione, però, è che l'A.I. strumento mostra anche il suo pensiero, in un modo che può capire anche chi non conosce un pinguino da un pulcinella di mare.

Il team ha addestrato la propria rete neurale profonda, algoritmi basati sul modo in cui funziona il cervello, alimentandola 11. 788 foto di 200 specie di uccelli da cui imparare, che vanno dalle anatre che nuotano ai colibrì in bilico.

I ricercatori non hanno mai detto alla rete "questo è un becco" o "queste sono le penne delle ali". Data una foto di un uccello misterioso, la rete è in grado di individuare modelli importanti nell'immagine e azzardare un'ipotesi confrontando tali modelli con i tratti tipici delle specie che ha visto prima.

Lungo la strada sputa una serie di mappe di calore che essenzialmente dicono:"Questo non è solo un warbler. È un warbler incappucciato, ed ecco le caratteristiche, come la testa mascherata e il ventre giallo, che lo tradiscono."

Dottore in informatica Duke lo studente Chaofan Chen e lo studente universitario Oscar Li hanno condotto la ricerca, insieme ad altri membri del team del Prediction Analysis Lab diretto dalla professoressa Duke Cynthia Rudin.

Hanno scoperto che la loro rete neurale è in grado di identificare la specie corretta fino all'84% delle volte, alla pari con alcune delle sue controparti più performanti, che non rivelano come sono in grado di raccontare, dire, un passero dall'altro.

Rudin dice che il loro progetto va oltre il nominare gli uccelli. Si tratta di visualizzare ciò che le reti neurali profonde stanno realmente vedendo quando guardano un'immagine.

Una tecnologia simile viene utilizzata per taggare le persone sui siti di social network, individuare sospetti criminali nelle telecamere di sorveglianza, e addestrare auto a guida autonoma per rilevare cose come semafori e pedoni.

Il problema, Rudino dice, è che la maggior parte degli approcci di apprendimento profondo alla visione artificiale sono notoriamente opachi. A differenza dei software tradizionali, il software di deep learning apprende dai dati senza essere programmato in modo esplicito. Di conseguenza, esattamente come questi algoritmi "pensano" quando classificano un'immagine non è sempre chiaro.

Rudin e i suoi colleghi stanno cercando di dimostrare che l'A.I. non deve essere così. Lei e il suo laboratorio stanno progettando modelli di deep learning che spiegano il ragionamento alla base delle loro previsioni, chiarendo esattamente perché e come hanno fornito le loro risposte. Quando un tale modello commette un errore, la sua trasparenza incorporata permette di capire perché.

Per il loro prossimo progetto, Rudin e il suo team stanno usando il loro algoritmo per classificare le aree sospette nelle immagini mediche come le mammografie. Se funziona, il loro sistema non solo aiuterà i medici a rilevare i grumi, calcificazioni e altri sintomi che potrebbero essere segni di cancro al seno. Mostrerà anche su quali parti della mammografia si sta dirigendo, rivelando quali caratteristiche specifiche assomigliano di più alle lesioni cancerose che ha visto prima in altri pazienti.

In quel modo, Rudino dice, la loro rete è progettata per imitare il modo in cui i medici fanno una diagnosi. "È un ragionamento basato sui casi, " Rudin ha detto. "Speriamo di poter spiegare meglio ai medici o ai pazienti perché la loro immagine è stata classificata dalla rete come maligna o benigna".

Il team presenta un documento sui risultati ottenuti alla XXXIII Conferenza sui sistemi di elaborazione delle informazioni neurali (NeurIPS 2019) a Vancouver il 12 dicembre.