Un robot e un essere umano che interagiscono. Credito:Tommy Ton, tontommy.com, CC BY-ND

L'intelligenza artificiale sta entrando nelle nostre vite in molti modi:sui nostri smartphone, nelle nostre case, nelle nostre auto. Questi sistemi possono aiutare le persone a fissare appuntamenti, guidare e persino diagnosticare malattie. Ma poiché i sistemi di intelligenza artificiale continuano a svolgere ruoli importanti e collaborativi nella vita delle persone, una domanda naturale è:posso fidarmi di loro? Come faccio a sapere che faranno quello che mi aspetto?

Explainable AI (XAI) è una branca della ricerca AI che esamina come gli agenti artificiali possono essere resi più trasparenti e affidabili per i loro utenti umani. L'affidabilità è essenziale se i robot e le persone devono lavorare insieme. XAI cerca di sviluppare sistemi di intelligenza artificiale che gli esseri umani trovano affidabili, pur svolgendo bene le attività progettate.

Al Centro per la Visione, Cognizione, Apprendimento, e Autonomia all'UCLA, noi e i nostri colleghi siamo interessati a quali fattori rendono le macchine più affidabili, e come i diversi algoritmi di apprendimento consentono la fiducia. Il nostro laboratorio utilizza un tipo di rappresentazione della conoscenza, un modello del mondo che un'intelligenza artificiale utilizza per interpretare l'ambiente circostante e prendere decisioni, che può essere più facilmente compreso dagli esseri umani. Questo naturalmente aiuta nella spiegazione e nella trasparenza, migliorando così la fiducia degli utenti umani.

Nella nostra ultima ricerca, abbiamo sperimentato diversi modi in cui un robot potrebbe spiegare le sue azioni a un osservatore umano. interessante, le forme di spiegazione che hanno favorito la fiducia più umana non corrispondevano agli algoritmi di apprendimento che hanno prodotto le migliori prestazioni del compito. Ciò suggerisce che le prestazioni e la spiegazione non sono intrinsecamente dipendenti l'una dall'altra:l'ottimizzazione per l'una da sola potrebbe non portare al miglior risultato per l'altra. Questa divergenza richiede progetti di robot che tengano conto sia delle buone prestazioni del compito che di spiegazioni affidabili.

Robot didattici

Nell'intraprendere questo studio, il nostro gruppo era interessato a due cose. In che modo un robot impara al meglio a svolgere un compito particolare? Quindi, come rispondono le persone alla spiegazione del robot delle sue azioni?

Abbiamo insegnato a un robot a imparare dalle dimostrazioni umane come aprire un flacone di medicinali con un lucchetto di sicurezza. Una persona indossava un guanto tattile che registrava le pose e le forze della mano umana mentre apriva la bottiglia. Queste informazioni hanno aiutato il robot a imparare ciò che l'essere umano ha fatto in due modi:simbolico e tattile. Simbolico si riferisce a rappresentazioni significative delle tue azioni:ad esempio, la parola "afferrare". Haptic si riferisce alle sensazioni associate alle posture e ai movimenti del tuo corpo:ad esempio, la sensazione delle tue dita che si chiudono.

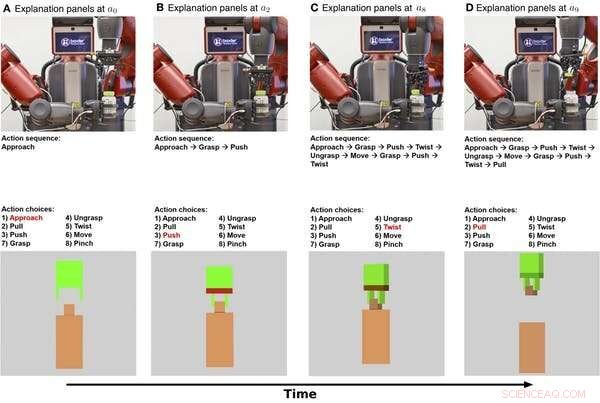

Spiegazioni simboliche e tattili di un robot che apre una bottiglia di medicinale mostrata nel tempo. La riga superiore è costituita da immagini fisse di un video del robot che esegue il compito. La riga centrale mostra una spiegazione simbolica dell'attività. La riga in basso mostra una spiegazione tattile. Credito:Edmonds et al., Sci. Robot. 4, eaay4663 (2019)

Primo, il robot ha appreso un modello simbolico che codifica la sequenza di passaggi necessari per completare l'operazione di apertura della bottiglia. Secondo, il robot ha appreso un modello tattile che consente al robot di "immaginare" se stesso nel ruolo del dimostratore umano e prevedere quale azione intraprenderebbe una persona quando incontra particolari pose e forze.

Si scopre che il robot è stato in grado di ottenere le sue migliori prestazioni combinando i componenti simbolici e tattili. Il robot ha sfruttato meglio la conoscenza dei passaggi per eseguire l'attività e il rilevamento in tempo reale dalla sua pinza rispetto all'utilizzo di entrambi da soli.

Guadagnare la fiducia umana

Ora che il robot sa cosa fare, come può spiegare il suo comportamento a una persona? E quanto bene questa spiegazione favorisce la fiducia umana?

Per spiegare le sue azioni, il robot può attingere al suo processo decisionale interno così come al suo comportamento. Il modello simbolico fornisce descrizioni passo passo delle azioni del robot, e il modello tattile fornisce un senso di ciò che la pinza del robot "sente".

Nel nostro esperimento, abbiamo aggiunto un'ulteriore spiegazione per gli umani:un testo scritto che ha fornito un riepilogo dopo che il robot ha finito di tentare di aprire la bottiglia della medicina. Volevamo vedere se le descrizioni riassuntive sarebbero state efficaci quanto la spiegazione simbolica passo dopo passo per guadagnare la fiducia umana.

Abbiamo chiesto a 150 partecipanti umani, diviso in quattro gruppi, osservare il robot che tenta di aprire il flacone del medicinale. Il robot ha quindi dato a ciascun gruppo una spiegazione diversa del compito:simbolico, passo dopo passo, aptico:posizioni e movimenti delle braccia, riassunto del testo, o simbolico e tattile insieme. Un gruppo di riferimento ha osservato solo un video del robot che tentava di aprire la bottiglia, senza fornire ulteriori spiegazioni.

Abbiamo scoperto che fornire spiegazioni sia simboliche che tattili ha favorito la massima fiducia, con la componente simbolica che contribuisce maggiormente. interessante, la spiegazione sotto forma di riassunto testuale non ha incoraggiato più fiducia che semplicemente guardare il robot eseguire il compito, indicando che gli umani preferiscono che i robot diano spiegazioni passo passo di ciò che stanno facendo.

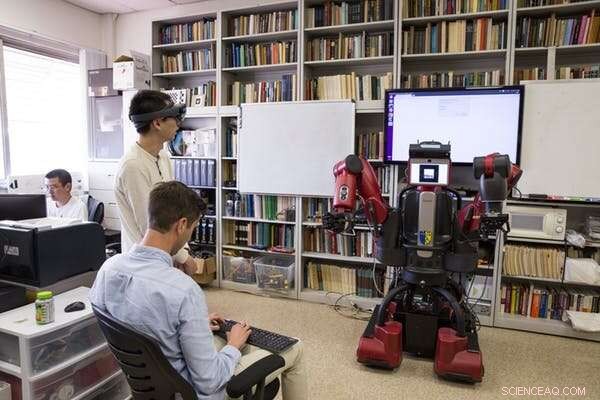

I ricercatori dell'UCLA testano un robot dopo che ha imparato ad aprire una bottiglia di medicinale dall'osservazione di manifestanti umani. Credito:UCLA Samueli School of Engineering, CC BY-ND

Progettare per prestazioni e fiducia

Il risultato più interessante di questa ricerca è che ciò che fa funzionare bene i robot non è lo stesso di ciò che fa sì che le persone li considerino affidabili. Il robot aveva bisogno sia dei componenti simbolici che di quelli tattili per svolgere al meglio il lavoro. Ma è stata la spiegazione simbolica che ha spinto le persone a fidarsi di più del robot.

Questa divergenza evidenzia obiettivi importanti per la futura ricerca sull'intelligenza artificiale e la robotica:concentrarsi sul perseguimento sia delle prestazioni delle attività che della spiegabilità. Concentrarsi solo sulle prestazioni del compito potrebbe non portare a un robot che si spieghi bene. Il nostro laboratorio utilizza un modello ibrido per fornire sia alte prestazioni che spiegazioni affidabili.

L'esecuzione e la spiegazione non si completano naturalmente a vicenda, quindi entrambi gli obiettivi devono essere una priorità fin dall'inizio durante la creazione di sistemi di intelligenza artificiale. Questo lavoro rappresenta un passo importante nello studio sistematico di come si sviluppano le relazioni uomo-macchina, ma molto di più deve essere fatto. Un passo impegnativo per la ricerca futura sarà passare da "Mi fido del robot per fare X" a "Mi fido del robot".

Affinché i robot si guadagnino un posto nella vita quotidiana delle persone, gli umani hanno bisogno di fidarsi delle loro controparti robotiche. Comprendere come i robot possono fornire spiegazioni che promuovono la fiducia umana è un passo importante per consentire a uomini e robot di lavorare insieme.

Questo articolo è stato ripubblicato da The Conversation con una licenza Creative Commons. Leggi l'articolo originale.