Credito:Università di Cambridge

Outfield Technologies è una start-up agro-tecnologica con sede a Cambridge che utilizza droni e intelligenza artificiale, per aiutare i frutticoltori a massimizzare il raccolto dalle colture dei frutteti.

I fondatori di Outfield Technologies Jim McDougall e Oli Hilbourne hanno lavorato con Ph.D. lo studente Tom Roddick del Machine Intelligence Laboratory del Dipartimento per sviluppare le proprie capacità tecnologiche per essere in grado di contare i fiori e le mele su un albero tramite droni che rilevano enormi meleti.

"Una valutazione accurata della fioritura o una stima del raccolto consente ai coltivatori di essere più produttivi, sostenibile e rispettosa dell'ambiente", spiega il direttore commerciale di Outfield Jim McDougall.

"La nostra analisi delle immagini aeree si concentra sulla stima della resa ed è molto ricercata a livello internazionale. Uno dei maggiori problemi che stiamo affrontando nel settore della frutta è la previsione accurata della resa. Questo sistema è stato sviluppato con i coltivatori per pianificare il lavoro, logistica e stoccaggio. È necessario in tutto il settore, pianificare il marketing e la distribuzione, e per garantire che ci siano sempre mele sugli scaffali. Le stime sono attualmente fatte dai coltivatori, e fanno un lavoro fantastico, ma i frutteti sono incredibilmente variabili e le stime sono spesso sbagliate fino al 20%. Ciò si traduce in una perdita di reddito, operazioni inefficienti e può comportare una notevole quantità di sprechi nel raccolto invenduto".

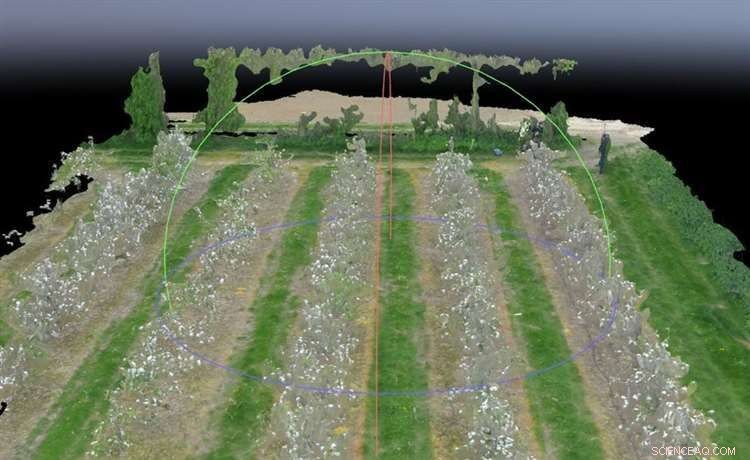

Ricostruzione computerizzata 3D di un frutteto del Regno Unito fiorito nell'aprile 2019. Crediti:Università di Cambridge

I metodi di identificazione di Outfield sono un'eccellente applicazione della ricerca che Ph.D. studente Tom Roddick, supervisionato dal Professor Roberto Cipolla, sta lavorando. Tom fa parte del Computer Vision and Robotics Group che si concentra sull'intelligenza artificiale e sull'apprendimento automatico, utilizzando metodi di Deep Learning, tramite reti neurali artificiali (ANN).

Le ANN sono sistemi di calcolo modellati liberamente sul cervello umano, progettati per riconoscere i modelli. Interpretano i dati sensoriali etichettando o raggruppando input non elaborati. I modelli che riconoscono sono numerici, in cui tutti i dati del mondo reale, siano immagini, suono, testo o serie temporali, è tradotto.

Tali sistemi "imparano" a svolgere compiti analizzando esempi, generalmente senza essere programmato con regole specifiche del compito. Per esempio, nel riconoscimento delle immagini, la ANN potrebbe imparare a identificare le immagini che contengono mele analizzando immagini di esempio che sono state etichettate manualmente come "mela" o "nessuna mela" e utilizzando i risultati per identificare le mele in altre immagini. Lo fanno senza alcuna conoscenza preliminare delle mele, Per esempio, colori o forme di mela. Anziché, generano automaticamente caratteristiche identificative dagli esempi che elaborano.

Le ANN raggruppano e classificano rilevando prima modelli semplici nei dati, come bordi nelle immagini o suoni nel parlato, e poi costruire gradualmente una gerarchia di concetti fino a quando nei dati emergono caratteristiche complesse come volti o frasi. L'obiettivo originale dell'approccio ANN era risolvere i problemi nello stesso modo in cui lo farebbe un cervello umano. Però, col tempo, l'attenzione si è spostata sull'esecuzione di compiti specifici. Le ANN sono state utilizzate per una varietà di compiti, compresa la visione artificiale, riconoscimento vocale, traduzione automatica, filtro dei social network, giocare da tavolo e videogiochi e diagnosi medica.

Durante il suo dottorato di ricerca, Tom ha lavorato sulla guida autonoma, guardando scene di strada catturate dalla fotocamera, annotare ed etichettare ogni elemento. Egli individua dove sono le auto, i pedoni, il cordolo ecc. Per fare questo usa uno strumento chiamato segmentazione semantica per etichettare ogni singolo pixel per dare una comprensione di alto livello di cosa sta succedendo. Outfield ha bisogno di identificare mele e fiori nelle fotografie dei loro frutteti e un modo per farlo è usare questo metodo di segmentazione semantica.

Un altro aspetto del metodo di raccolta dati di Outfield è individuare dove si trovano i loro droni in ogni momento e c'è un altro filone di visione artificiale che si concentra sulla localizzazione, capire dove ti trovi nel mondo e cosa stai guardando. Alunno Kesar Breen, consulente indipendente di machine learning e visione artificiale, ha preso del tempo fuori dalla sua fitta agenda per consigliare Jim e Oli. Kesar li ha aiutati con una panoramica delle tecnologie che potrebbero utilizzare per la modellazione e l'analisi dei frutteti per scoprire dove si trovano le colture, e ha redatto un potenziale algoritmo per farlo, con tempi e requisiti. Kesar dice, "Outfield sta facendo cose molto interessanti lavorando con alcune tecnologie interessanti ma comprovate, su un importante problema aziendale. Penso che sia molto probabile che sia commercialmente fattibile".

Parlando del suo lavoro con Outfield, Tom dice, "Le esigenze di segmentazione semantica di Outfield hanno alcune sottigliezze molto specifiche che sono molto interessanti dal punto di vista della ricerca, ad esempio. Sono abituato a guardare le immagini per identificare oggetti di grandi dimensioni come automobili, che sono facili da individuare, ma ciò che Outfield ha sono queste enormi immagini aeree di frutteti che sono milioni e milioni di pixel e vuole rilevare ogni fiore che sboccia o ogni frutto per calcolare quanti ce ne sono. Ho esaminato come farlo in modo efficiente e robusto per essere in grado di distinguere tra cose come; questa è una mela su un albero? O questa è una mela per terra?"

Jim dice, "Il Regno Unito dispone di alcune delle migliori tecnologie e dei migliori scienziati tecnologici al mondo. Attualmente stiamo effettuando dei beta test che includono l'utilizzo del modello con colture diverse dalle mele.

"Abbiamo un piano solido per i prossimi due o tre anni, e stiamo aprendo un round di investimenti nell'ottobre 2019 per chiuderlo nel primo trimestre del 2020. Questo ci consentirà di coinvolgere più membri del team a tempo pieno e testare i prodotti su larga scala in Nuova Zelanda e nel Regno Unito nel prossimo anno".