Ci sono persone laggiù che hanno bisogno di aiuto? Credito:Fotografia Roschetzky/Shutterstock.com

Quando si verificano disastri, che si tratti di un disastro naturale come un'inondazione o un terremoto, o uno causato dall'uomo come una sparatoria o un bombardamento di massa:può essere estremamente pericoloso inviare i primi soccorritori, anche se ci sono persone che hanno un disperato bisogno di aiuto.

I droni sono utili, e stanno aiutando nella ripresa dopo i micidiali tornado dell'Alabama, ma la maggior parte richiede piloti individuali, che pilotano l'aereo senza pilota tramite telecomando. Ciò limita la velocità con cui i soccorritori possono visualizzare un'intera area colpita, e può ritardare l'aiuto effettivo dal raggiungere le vittime.

I droni autonomi potrebbero coprire più terreno più rapidamente, ma sarebbero più efficaci solo se fossero in grado di aiutare da soli i soccorritori a identificare le persone bisognose. Presso il Vision Lab dell'Università di Dayton, stiamo lavorando allo sviluppo di sistemi che possono aiutare a individuare persone o animali, specialmente quelli che potrebbero essere intrappolati da detriti caduti. La nostra tecnologia imita il comportamento di un soccorritore umano, esaminando brevemente vaste aree e scegliendo rapidamente regioni specifiche su cui concentrarsi, da esaminare più da vicino.

Alla ricerca di un oggetto in una scena caotica

Le aree disastrate sono spesso ingombrate da alberi abbattuti, edifici crollati, strade dissestate e altro disordine che può rendere molto difficile individuare le vittime che necessitano di soccorso.

Il mio team di ricerca ha sviluppato un sistema di rete neurale artificiale che può funzionare in un computer a bordo di un drone. Questo sistema può emulare alcuni degli eccellenti modi in cui funziona la visione umana. Analizza le immagini catturate dalla fotocamera del drone e comunica risultati notevoli ai supervisori umani.

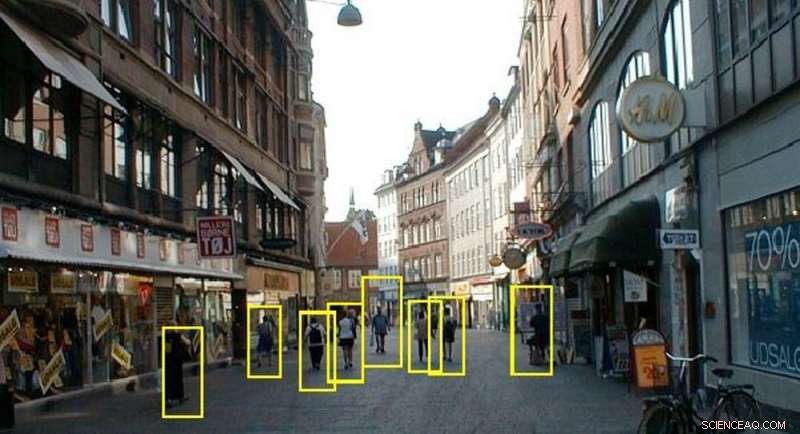

Il nostro sistema può individuare le persone in un ambiente affollato. Credito:Laboratorio di visione dell'Università di Dayton, CC BY-ND

Primo, il nostro sistema elabora le immagini per migliorarne la nitidezza. Proprio come gli umani strizzano gli occhi per regolare la messa a fuoco, le nostre tecnologie prendono stime dettagliate delle regioni più scure in una scena e alleggeriscono computazionalmente le immagini. Quando le immagini sono troppo confuse o nebbiose, il sistema riconosce che sono troppo luminosi e riduce il bianco dell'immagine per vedere più chiaramente la scena reale.

In un ambiente piovoso, i cervelli umani usano una strategia brillante per vedere chiaramente. Notando le parti di una scena che non cambiano - e quelle che lo fanno, quando cadono le gocce di pioggia, le persone possono vedere abbastanza bene nonostante la pioggia. La nostra tecnologia utilizza la stessa strategia, indagando continuamente i contenuti di ogni luogo in una sequenza di immagini per ottenere informazioni chiare sugli oggetti in quel luogo.

Abbiamo anche sviluppato una tecnologia in grado di ingrandire le immagini di una telecamera montata su un drone, più luminoso e più chiaro. Espandendo le dimensioni dell'immagine, sia gli algoritmi che le persone possono vedere le caratteristiche chiave in modo più chiaro.

Confermare oggetti di interesse

Il nostro sistema può identificare persone in varie posizioni, come sdraiarsi prono o rannicchiato in posizione fetale, anche da diversi angoli di visuale e in diverse condizioni di illuminazione.

Il cervello umano può guardare una vista di un oggetto e immaginare come apparirebbe da altre angolazioni. Quando la polizia emette un avviso chiedendo al pubblico di cercare qualcuno, spesso includono una foto fissa, sapendo che la mente degli spettatori immaginerà viste tridimensionali di come potrebbe apparire quella persona, e riconoscerli per strada, anche se non ottengono la stessa identica vista della foto offerta. Utilizziamo questa strategia calcolando modelli tridimensionali di persone:forme umane generali o proiezioni più dettagliate di persone specifiche. Questi modelli sono usati per abbinare le somiglianze quando una persona appare in una scena.

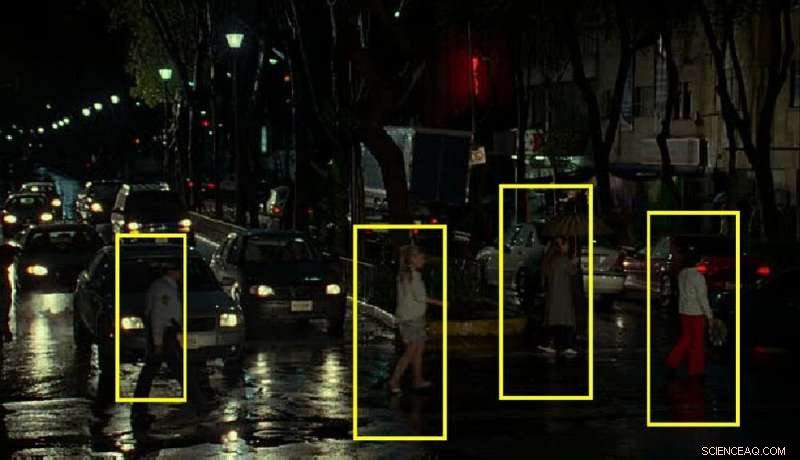

Un'illuminazione confusa e scarsa può rendere difficile l'identificazione delle persone. Credito:Laboratorio di visione dell'Università di Dayton, CC BY-ND

Abbiamo anche sviluppato un modo per rilevare parti di un oggetto, senza vedere tutto. Il nostro sistema può essere addestrato a rilevare e localizzare una gamba che sporge da sotto le macerie, una mano che saluta a distanza, o una testa che spunta sopra un mucchio di blocchi di legno. Può distinguere una persona o un animale da un albero, cespuglio o veicolo.

Mettere insieme i pezzi

Durante la sua prima scansione del paesaggio, il nostro sistema imita l'approccio di uno spotter in volo, esaminando il terreno per trovare possibili oggetti di interesse o regioni meritevoli di approfondimento, e poi guardando più da vicino. Per esempio, un pilota di aerei che sta cercando un camion a terra di solito presterà meno attenzione ai laghi, stagni, campi agricoli e campi da gioco, perché è meno probabile che i camion si trovino in quelle aree. La nostra tecnologia autonoma impiega la stessa strategia per concentrare l'area di ricerca sulle regioni più significative della scena.

Quindi il nostro sistema esamina ogni regione selezionata per ottenere informazioni sulla forma, struttura e consistenza degli oggetti presenti. Quando rileva un insieme di caratteristiche che corrisponde a un essere umano o parte di un essere umano, lo contrassegna come posizione di una vittima.

Il drone raccoglie anche dati GPS sulla sua posizione, e rileva la distanza dagli altri oggetti che sta fotografando. Queste informazioni consentono al sistema di calcolare esattamente la posizione di ogni persona che necessita di assistenza, e allertare i soccorritori.

Tutto questo processo – catturare un'immagine, elaborarlo per la massima visibilità e analizzarlo per identificare le persone che potrebbero essere intrappolate o nascoste:impiega circa un quinto di secondo sul normale computer portatile trasportato dal drone, insieme alla sua fotocamera ad alta risoluzione.

L'esercito americano è interessato a questa tecnologia. Abbiamo lavorato con la ricerca medica dell'esercito degli Stati Uniti e il comando dei materiali per trovare persone ferite in un campo di battaglia che hanno bisogno di soccorso. Abbiamo adattato questo lavoro per servire le società di servizi pubblici alla ricerca di intrusioni nei percorsi delle condutture da parte di attrezzature da costruzione o veicoli che potrebbero danneggiare le condutture. Anche le società di servizi sono interessate a rilevare eventuali nuove costruzioni di edifici in prossimità dei percorsi dei gasdotti. Tutti questi gruppi – e molti altri ancora – sono interessati alla tecnologia che può vedere come gli umani possono vedere, specialmente in posti in cui gli umani non possono essere.

Questo articolo è stato ripubblicato da The Conversation con una licenza Creative Commons. Leggi l'articolo originale.