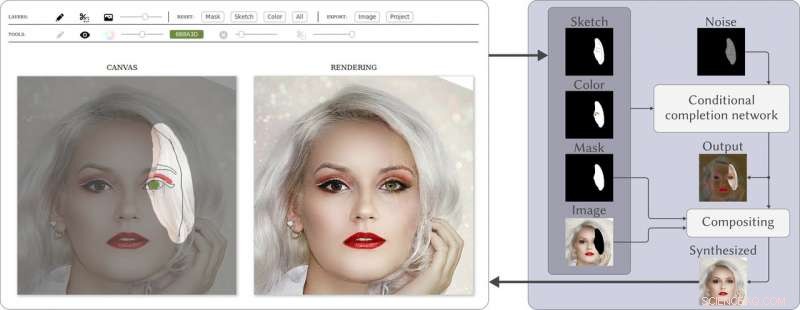

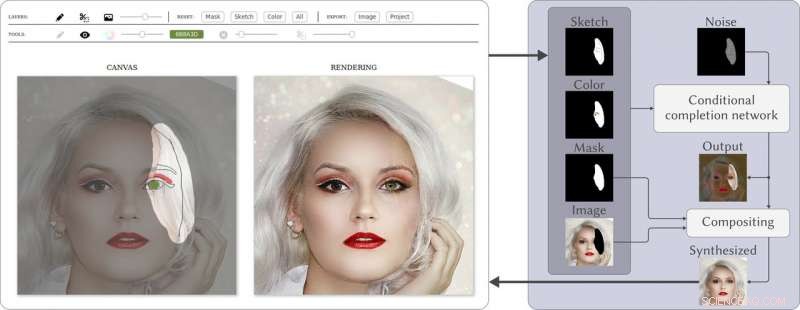

Faceshop consiste in un'interfaccia utente basata sul web (a sinistra) che consente a un utente di specificare una regione da modificare. Inoltre, l'utente può disegnare tratti e scarabocchi di colore per guidare il processo di modifica. Il nucleo del back-end (a destra) è una rete di completamento dell'immagine profonda che prende l'input dell'utente e l'immagine originale per sintetizzare il risultato modificato. Credito:Tiziano Protenier

Su piattaforme di social media popolari, gli utenti pubblicano innumerevoli immagini ogni giorno. Solo su Instagram, ci sono più di 40 miliardi di foto caricate, una cifra che sale alle stelle di 95 milioni ogni giorno. Ciò presenta una chiara necessità di strumenti di fotoritocco intuitivi ma robusti che consentano all'utente medio di eseguire funzioni di modifica avanzate.

E mentre c'è una precisa necessità di editing interattivo delle immagini rispetto ai social media, strumenti e sistemi di editing migliorati rimangono anche un aspetto importante della computer grafica e della computer vision. Però, mancano strumenti con funzioni di modifica più complesse per utenti inesperti, come cambiare l'espressione facciale in una foto.

Un gruppo di ricerca, guidato da scienziati informatici dell'Università di Berna-Svizzera e dell'Università del Maryland-College Park, hanno ideato un framework di editing basato su sketch che consente a un utente di modificare le proprie foto "disegnando" alcuni tratti su di esse. Il loro sistema, chiamato FaceShop, offre anche una funzione copia-incolla, che consente agli utenti di modificare qualsiasi parte di una foto copiando e incollando la parte da modificare da un'altra (migliore) foto, eliminando la necessità di disegnare a mano o disegnare qualsiasi cosa.

L'approccio del team si basa su tecniche di apprendimento automatico, quale, alla fine, offrono agli utenti un maggiore controllo sulle modifiche desiderate in tempo reale e producono risultati più realistici.

"La maggior parte degli altri approcci si basa su metodi più tradizionali, tecniche artigianali, che impongono alcune limitazioni. Ad esempio, questi sistemi sono o [in base alla progettazione] limitati a insiemi limitati di operazioni di modifica predefinite, oppure sono molto flessibili ma difficili da usare e richiedono agli utenti esperti di dedicare una notevole quantità di tempo per eseguire modifiche piuttosto basilari, "dice Tiziano Protenier, autore principale del lavoro e dottorato di ricerca. candidato all'Università di Berna. "In contrasto, il nostro sistema è molto flessibile e consente agli utenti inesperti di eseguire modifiche complesse in pochi minuti utilizzando un'interfaccia intuitiva."

Faceshop consiste in un'interfaccia utente basata sul web (a sinistra) che consente a un utente di specificare una regione da modificare. Inoltre, l'utente può disegnare tratti e scarabocchi di colore per guidare il processo di modifica. Il nucleo del back-end (a destra) è una rete di completamento dell'immagine profonda che prende l'input dell'utente e l'immagine originale per sintetizzare il risultato modificato. Credito:Tiziano Protenier

Protenier ha sviluppato il nuovo sistema con i collaboratori Qiyang Hu, Attila Szabo, Siavash Arjomand Bigdeli e Paolo Favaro dell'Università di Berna, e Matthias Zwicker dell'Università del Maryland. Il team presenterà il proprio lavoro al SIGGRAPH 2018, tenutosi dal 12 al 16 agosto a Vancouver, British Columbia. Questo incontro annuale mette in mostra i principali professionisti del mondo, accademici, e menti creative all'avanguardia nella computer grafica e nelle tecniche interattive.

Nella loro carta, "FaceShop:modifica delle immagini del viso basata su schizzi profondi, " i ricercatori dimostrano il loro nuovo sistema attraverso diversi esempi. In uno, il naso di una donna è leggermente manipolato, e una ciocca di capelli è tagliata in modo che sia allontanata dal suo viso, rimuovendo un'ombra scura che era apparsa su un solo lato del suo viso nella foto originale. Un'altra foto mostra come un utente è in grado di migliorare il trucco degli occhi di una donna e far risaltare il colore dei suoi occhi. Gli esempi evidenziati nel documento mostrano come funziona il nuovo sistema, intuitivamente, e produce alta qualità, risultati realistici.

Il metodo del team si basa su reti neurali generative avversarie (GAN), una forma di intelligenza artificiale (AI) che, negli ultimi anni, ha suscitato molto interesse nella ricerca per la sua capacità di generare immagini dall'aspetto realistico. Questi GAN sono costituiti da due AI che combattono l'uno contro l'altro. Il primo componente cerca di distinguere le immagini generate dalle immagini autentiche, mentre il secondo componente cerca di produrre immagini che ingannano l'altra IA. Durante l'allenamento, le due componenti imparano l'una dall'altra, alla fine risultando in un sistema che ha imparato autonomamente a produrre immagini dall'aspetto realistico, senza alcun giudizio umano nel ciclo.

A differenza di altri metodi di modifica delle immagini basati sull'intelligenza artificiale, una volta che il sistema è stato addestrato, gli utenti hanno più controllo sulle modifiche alle loro foto. "Il nostro sistema offre un grado di controllo ottimale, il che lo rende molto interessante dal punto di vista applicativo, " osserva Portenier. "Altre tecniche che cercano di incorporare il controllo dell'utente sono limitate nell'ambito delle possibili modifiche o hanno dimostrato di funzionare bene sui dati utilizzati per addestrare i sistemi, ma non riescono a produrre risultati convincenti con l'input dell'utente reale. Stiamo presentando una tecnica che mitiga questo problema, risultando in un sistema che funziona sorprendentemente bene nella pratica."

Nel lavoro futuro, i ricercatori intendono esplorare ulteriori strumenti di interazione con l'utente da aggiungere al loro framework, e considera come sfruttare l'intelligenza artificiale per l'editing di video basato su schizzi.