Le aziende tecnologiche hanno l'imperativo economico di evitare di affrontare troppo seriamente le questioni etiche relative all'utilizzo dei dati. Credito:Shutterstock

Il nostro rapporto con le aziende tecnologiche è cambiato in modo significativo negli ultimi 18 mesi. Violazioni di dati in corso, e le rivelazioni sullo scandalo Cambridge Analytica, hanno sollevato preoccupazioni su chi possiede i nostri dati, e come viene utilizzato e condiviso.

Le aziende tecnologiche hanno promesso di fare di meglio. Dopo le sue critiche sia dal Congresso degli Stati Uniti che dal Parlamento dell'UE, CEO di Facebook, Mark Zuckerberg, ha detto che Facebook cambierà il modo in cui condivide i dati con fornitori di terze parti. Ci sono alcune prove che questo sta accadendo, soprattutto con gli inserzionisti.

Ma le aziende tecnologiche hanno davvero cambiato i loro modi? Dopotutto, i dati sono ora una risorsa primaria nell'economia moderna.

Per scoprire se c'è stato un significativo riallineamento tra le aspettative della comunità e il comportamento aziendale, abbiamo analizzato i principi e le iniziative di etica dei dati che varie organizzazioni globali hanno intrapreso da quando sono scoppiati i vari scandali.

Quello che abbiamo trovato è preoccupante. Alcune delle più grandi organizzazioni non hanno dimostrato pratiche alterate, invece sottoscrivendo iniziative etiche che non sono né imposte né esecutive.

Come abbiamo tracciato queste informazioni

Prima di discutere i nostri risultati, alcuni punti di chiarimento.

in primo luogo, le questioni dei dati, intelligenza artificiale (AI), apprendimento automatico e algoritmi sono difficili da separare, e la loro portata è contestata. Infatti, per la maggior parte di queste organizzazioni, i concetti sono ammassati insieme, mentre per i ricercatori e i responsabili politici presentano sfide nettamente diverse.

Per esempio, apprendimento automatico, mentre un ramo di AI, riguarda la costruzione di macchine per imparare da sole senza supervisione. Come tale, i responsabili politici devono garantire che gli algoritmi di apprendimento automatico siano privi di pregiudizi e tengano conto di varie questioni sociali ed economiche, piuttosto che trattare tutti allo stesso modo.

In secondo luogo, le politiche, le dichiarazioni e le linee guida delle società che abbiamo esaminato non sono situate in posizione centrale, presentato in modo coerente o semplice da decifrare.

Tenendo conto della mancanza di un approccio coerente all'etica dei dati adottato dalle aziende tecnologiche, il nostro metodo consisteva nel rilevare i passi visibili intrapresi, e di guardare ai grandi principi etici abbracciati.

Cinque grandi categorie di etica dei dati

Alcune aziende, come Microsoft, IBM, e Google, hanno pubblicato i propri principi etici dell'IA.

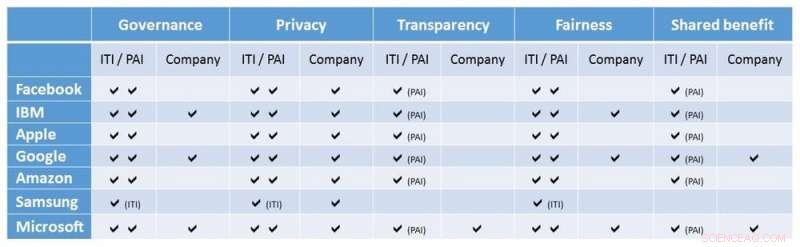

Più aziende, inclusi Facebook e Amazon, hanno scelto di mantenere un approccio di libera concorrenza all'etica unendosi a consorzi, come Partnership on AI (PAI) e Information and Technology Industry Council (ITI). Questi due consorzi hanno pubblicato dichiarazioni contenenti principi etici. I principi sono volontari, e non hanno obblighi di segnalazione, standard oggettivi o supervisione.

Iniziative a cui le grandi aziende tecnologiche hanno aderito in particolari categorie di etica dei dati. Autore fornito

Abbiamo esaminato il contenuto delle linee guida etiche pubblicate di queste società e consorzi, e ha scoperto che i principi rientravano in cinque grandi categorie.

La correttezza e la trasparenza sono importanti

La nostra ricerca suggerisce che le conversazioni sull'etica dei dati sono in gran parte incentrate sulla privacy e sulla governance. Ma questi principi sono il minimo previsto in un quadro giuridico. Se qualcosa, gli scandali del passato ci hanno dimostrato che questo non basta.

Facebook è nota come azienda che mantiene un approccio di libera concorrenza all'etica. È membro di Partnership on AI e Information and Technology Industry Council, ma ha evitato la pubblicazione dei propri principi di etica dei dati. E mentre ci sono state voci su un cosiddetto rilevatore di bias di apprendimento automatico "Fairness Flow", e le voci di un team etico su Facebook, i dettagli per uno di questi sviluppi sono approssimativi.

Nel frattempo, la misura in cui il partenariato sull'intelligenza artificiale e il Consiglio dell'industria dell'informazione e della tecnologia influenzano il comportamento delle aziende associate è altamente discutibile. Il partenariato sull'intelligenza artificiale, che conta più di 70 membri, è stata costituita nel 2016, ma deve ancora dimostrare alcun risultato tangibile oltre la pubblicazione dei principi chiave.

È necessaria una migliore regolamentazione

Per le aziende tecnologiche, potrebbe esserci un compromesso tra il trattamento etico dei dati e quanti soldi possono guadagnare da quei dati. C'è anche una mancanza di consenso tra le aziende su quale sia l'approccio etico corretto. Così, per tutelare il pubblico, è necessaria una guida e una supervisione esterna.

Sfortunatamente, il governo ha attualmente mantenuto la sua attenzione nella nuova legislazione sulla condivisione e rilascio dei dati del governo australiano sulla privacy, un principio che è coperto dalla legislazione altrove.

Gli eventi relativi ai dati degli ultimi anni hanno confermato che abbiamo bisogno di una maggiore attenzione ai dati come diritto del cittadino, non solo un diritto del consumatore. Come tale, abbiamo bisogno di maggiore attenzione all'equità, trasparenza e vantaggi condivisi, tutte aree attualmente trascurate dalle aziende e dal governo.

Questo articolo è stato ripubblicato da The Conversation con una licenza Creative Commons. Leggi l'articolo originale.