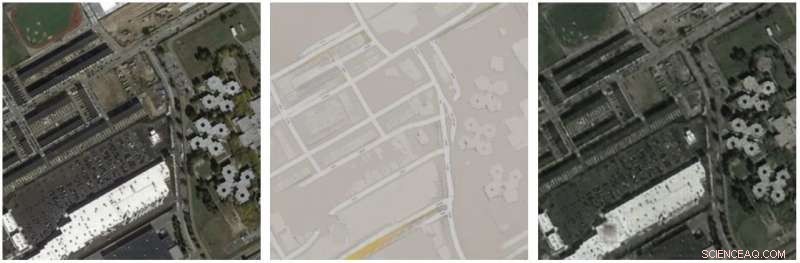

I dettagli in x sono ricostruiti in GF x, nonostante non appaia nella mappa intermedia F x. Attestazione:arXiv:1712.02950 [cs.CV]

chiamalo intelligente, bollalo come un imbroglione, ma non vergognarti di trovarlo terribilmente interessante. Il "esso" è CycleGAN, e il suo collegamento alla steganografia, dove messaggi e informazioni sono nascosti all'interno di testo o dati non segreti.

Così, nel 2019 non può essere così scioccante per le persone apprendere che una macchina, non un essere umano, può ingannare la sua strada anche se un compito. L'IA in questo caso, come buone spie umane e truffatori, imparato quando nascondere alcune informazioni che possono essere utilizzate in seguito.

In pacchetto , Bhagyashree R ha scritto che "I ricercatori hanno scoperto che la macchina stava codificando i dati della mappa aerea nei modelli di rumore della mappa stradale in basso. Il codice era così sottile che sarebbe stato invisibile all'occhio umano. Ma a un esame più attento, quando i dettagli erano stati amplificati, era chiaro che la macchina aveva apportato migliaia di piccoli cambiamenti di colore che indicavano dati visivi che potevano essere usati come un foglietto quando si ricreava l'immagine aerea, da qui i lucernari che riapparivano magicamente".

Nel frattempo, un articolo molto citato sull'argomento (la ricerca è stata coperta da numerosi siti di osservazione della tecnologia, in realtà) ha incapsulato ciò che i ricercatori hanno scoperto. "Un agente di apprendimento automatico destinato a trasformare le immagini aeree in mappe stradali e ritorno è stato scoperto barare nascondendo informazioni di cui avrebbe avuto bisogno in seguito in 'quasi impercettibile, segnale ad alta frequenza, " disse TechCrunch .

Lily Hay Newman in Cablato nel 2017 ha ricordato ai lettori che la steganografia è una pratica antica, niente è nato ieri. Pensa a Da Vinci che incorpora un significato segreto in un dipinto; o le spie di un tempo che scrivono con inchiostro invisibile.

Se la pratica è antica, anche se, ci sono alcuni problemi contemporanei. Noi siamo, Dopotutto, in un mondo digitale dove tutti i vizi e le virtù hanno assunto nuovi processi online.

La steganografia diventerà sempre più difficile da individuare, disse BancaInfoSicurezza , ed è stato "già utilizzato da cattivi attori".

Mathew Schwartz ha affermato che la steganografia digitale sembra rendere la vita più difficile alle forze dell'ordine e ha citato un professore universitario che ha espresso un'osservazione simile. "La crittografia del disco steganografica perfettamente negabile sarà un incubo quando si tratta di raccogliere prove digitali, " ha detto Alan Woodward, un professore di informatica presso l'Università del Surrey.

Avanti veloce ai rapporti che sono ora, che un gruppo di ricercatori di Stanford e Google ha eseguito uno studio su come una rete neurale, CicloGAN, impara a barare. Il documento:CycleGAN, un Master of Steganography è su arXiv e i tre autori sono Casey Chu (Stanford), Andrey Zhmoginov (Google) e Mark Sandler (Google).

Scrissero, "CycleGAN impara a 'nascondere' le informazioni su un'immagine sorgente nelle immagini che genera in modo quasi impercettibile, segnale ad alta frequenza."

Come parte della loro sezione Discussione, gli autori sottolineano che "Codificando le informazioni in questo modo, CycleGAN diventa particolarmente vulnerabile agli attacchi avversari; un utente malintenzionato può far sì che una delle trasformazioni apprese produca un'immagine a sua scelta perturbando qualsiasi immagine sorgente scelta."

Il loro consiglio? Hanno scritto che "la presenza di questo fenomeno indica che è necessaria cautela quando si progettano funzioni di perdita che coinvolgono composizioni di reti neurali:tali modelli possono comportarsi in modi non intuitivi se un componente sfrutta la capacità dell'altro componente di supportare esempi contraddittori".

Quadri comuni, secondo gli autori, come le reti generative avversarie e le perdite percettive utilizzano queste composizioni. Hanno affermato che "questi framework dovrebbero essere analizzati attentamente per assicurarsi che gli esempi contraddittori non siano un problema".

Ma aspetta. Dovremmo correre per le colline con paure urlanti che i robot e l'intelligenza artificiale ci finiranno tutti? Fortunatamente, Devin Coldewey ha calmato i lettori in TechCrunch . L'evento "rivela semplicemente un problema con i computer che esiste da quando sono stati inventati:fanno esattamente quello che gli dici di fare".

Cosa voleva dire Coldewey con questo? "L'intenzione dei ricercatori era, come puoi immaginare, per accelerare e migliorare il processo di trasformazione delle immagini satellitari nelle famose mappe accurate di Google. A tal fine il team stava lavorando con quello che viene chiamato CycleGAN, una rete neurale che impara a trasformare le immagini di tipo X e Y l'una nell'altra, nel modo più efficiente ma accurato possibile, attraverso una grande quantità di sperimentazione."

Il computer è arrivato a una soluzione "che fa luce su una possibile debolezza di questo tipo di rete neurale:che il computer, se non espressamente impedito di farlo, essenzialmente troverà un modo per trasmettersi i dettagli nell'interesse di risolvere un dato problema in modo rapido e semplice."

© 2019 Scienza X Rete