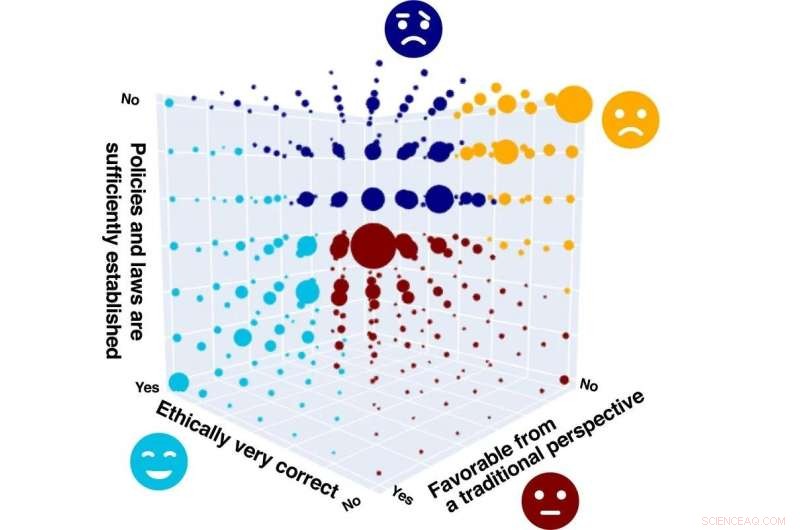

Le risposte degli intervistati in Giappone, Stati Uniti e Germania si sono separate in risposte etiche, legali e tradizionali. Mediante la segmentazione, le risposte possono essere codificate a colori a seconda che la risposta dell'intervistato sia positiva (azzurro), negativa (arancione), preoccupata per questioni legali (marina) o non preoccupata per questioni legali (cremisi). Credito:Ikkatai et al./Kavli IPMU

Le persone in Giappone, negli Stati Uniti e in Germania mostrano preoccupazioni diverse riguardo all'uso dell'intelligenza artificiale (IA) nell'intrattenimento, nei servizi di acquisto o per aiutare a trovare criminali, riporta un nuovo studio su AI ed etica .

Secondo lo studio, i giapponesi tendevano a segnalare una maggiore preoccupazione per l'IA utilizzata per combattere il crimine, mentre tedeschi e americani tendevano a segnalare una maggiore preoccupazione per gli aspetti etici e sociali dell'utilizzo dell'IA nell'intrattenimento.

"Abbiamo scoperto che c'è una differenza nei livelli di comprensione dell'IA e dell'ELSI [questioni etiche, legali e sociali] tra i paesi. Penso che diventerà importante condurre discussioni approfondite sulle questioni legali e politiche che circondano l'IA", ha affermato per primo autore e Professore Associato dell'Università di Kanazawa Yuko Ikkatai.

L'IA è attualmente utilizzata in un'ampia gamma di campi, il che ha sollevato atteggiamenti positivi e negativi nel pubblico in generale. Le politiche etiche differiscono da paese a paese, come in Giappone, dove le linee guida enfatizzano la regolamentazione dell'IA e la diminuzione delle preoccupazioni delle persone, mentre negli Stati Uniti sottolineano la necessità di massimizzare i benefici sociali dell'IA e menzionano i rischi a lungo termine, mentre in Europa le linee guida enfatizzano i diritti e le responsabilità delle persone.

Un gruppo di ricerca guidato dal professor Hiromi Yokoyama, Ikkatai dell'Istituto Kavli per la fisica e la matematica dell'universo (Kavli IPMU) e l'assistente professore Tilman Hartwig dell'Istituto per la fisica dell'intelligence dell'Università di Tokyo, ha notato gli atteggiamenti etici nei confronti dell'IA, una tecnologia universale e avanzata tecnologia, varia da paese a paese. I ricercatori affermano che il riconoscimento degli atteggiamenti pubblici nei confronti dell'IA in diversi paesi diventerà sempre più importante prima di implementare nuove tecnologie di intelligenza artificiale.

Il loro studio prevedeva la realizzazione di un sondaggio online in Giappone, Stati Uniti e Germania, chiedendo agli intervistati di esaminare quattro diversi scenari di intelligenza artificiale e rispondere a tre domande su ciascuno di essi, prendendo in considerazione le questioni etiche, legali e sociali (ELSI) . Il primo scenario prevedeva l'utilizzo dell'IA per i cantanti generati dall'IA, il secondo scenario, gli acquisti dei clienti dell'IA, il terzo, le armi autonome dell'IA e, infine, le previsioni dell'IA delle attività criminali. Sono stati scelti circa 1.000 intervistati in ciascun paese, in base all'età, al sesso e all'ubicazione della popolazione del proprio paese.

Dopo aver analizzato i loro risultati, i ricercatori sono stati in grado di separare le risposte in quattro gruppi:persone con opinioni ottimistiche, persone con opinioni negative, persone preoccupate per questioni legali e quelle non preoccupate per questioni legali. Il team ha chiamato questo segmento AI ed ELSI.

I ricercatori avevano precedentemente sviluppato una metrica visiva ottagonale, analoga a un sistema di valutazione, che potrebbe essere utile ai ricercatori di intelligenza artificiale che desideravano sapere come il loro lavoro potrebbe essere percepito dal pubblico. Lo sviluppo del segmento AI ed ELSI è dovuto al fatto che i ricercatori hanno riscontrato che la metrica visiva ottagonale ha una versatilità limitata se applicata a nuove tecnologie diverse dall'IA.

Nello studio più recente del team, hanno scoperto che, nel complesso, più l'intervistato è anziano, maggiore è la preoccupazione che nutriva per i problemi di AI ed ELSI, mentre gli intervistati che hanno più familiarità con l'IA hanno affermato di essere più preoccupati per le questioni legali.

Per quanto riguarda ogni scenario, gli intervistati tedeschi e statunitensi erano più preoccupati per le questioni etiche e sociali riguardanti i cantanti generati dall'IA.

Per quanto riguarda l'utilizzo dell'IA per lo shopping, gli intervistati tedeschi erano più preoccupati per le questioni etiche, mentre gli intervistati giapponesi erano più preoccupati per le questioni legali.

Per quanto riguarda le armi autonome dell'IA, gli intervistati giapponesi e tedeschi erano più preoccupati per le questioni etiche e anche gli intervistati giapponesi erano più preoccupati per le questioni sociali e legali.

Infine, per quanto riguarda l'utilizzo dell'IA per catturare i criminali, gli intervistati statunitensi erano più preoccupati per le questioni etiche, sociali e legali.

"È entusiasmante poter segmentare le risposte in modo così chiaro in quattro gruppi e la caratteristica più distintiva è la percezione delle questioni legali relative all'IA. Questo è solido tra i tre paesi e mostra che la comunicazione sulle leggi e le politiche relative all'IA è molto importante ", ha detto Hartwig.

I dettagli del loro studio sono stati pubblicati in AI ed Etica il 1 settembre. + Esplora ulteriormente