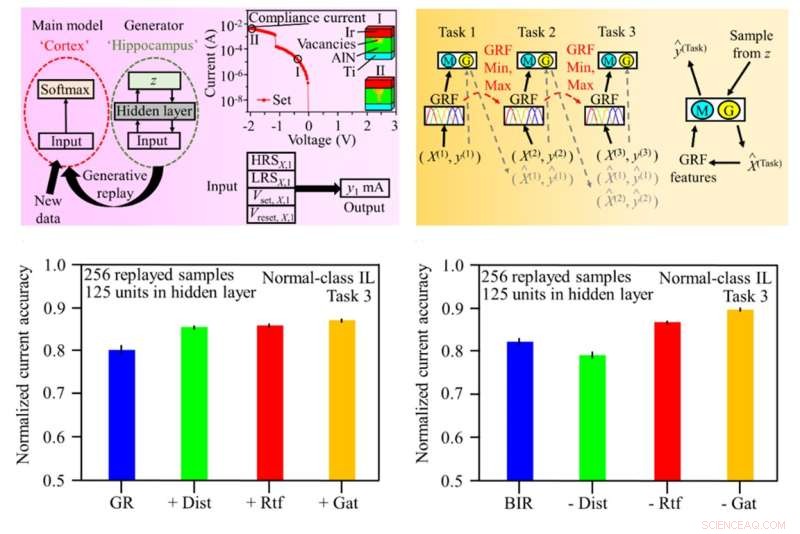

Grafica della configurazione del replay generativo (pannello in alto a sinistra) e schema per l'allenamento della rete neurale artificiale (ANN) con replay generativo (pannello in alto a destra). La precisione della corrente elettrica normalizzata per i modelli convenzionali (pannello in basso a sinistra) e BIR (riquadro in basso a destra) ispirati al cervello. Credito:SUTD

Come dimostrato dalle scoperte in vari campi dell'intelligenza artificiale (AI), come l'elaborazione delle immagini, l'assistenza sanitaria intelligente, i veicoli a guida autonoma e le città intelligenti, questo è senza dubbio il periodo d'oro del deep learning. Nel prossimo decennio circa, l'IA e i sistemi informatici saranno dotati della capacità di apprendere e pensare come fanno gli esseri umani, di elaborare il flusso continuo di informazioni e interagire con il mondo reale.

Tuttavia, gli attuali modelli di IA subiscono una perdita di prestazioni quando vengono addestrati consecutivamente su nuove informazioni. Questo perché ogni volta che vengono generati nuovi dati, questi vengono scritti sopra i dati esistenti, cancellando così le informazioni precedenti. Questo effetto è noto come "oblio catastrofico". Una difficoltà nasce dal problema della stabilità-plasticità, in cui il modello di IA deve aggiornare la sua memoria per adattarsi continuamente alle nuove informazioni e, allo stesso tempo, mantenere la stabilità delle sue attuali conoscenze. Questo problema impedisce all'IA all'avanguardia di apprendere continuamente dalle informazioni del mondo reale.

I sistemi di edge computing consentono di spostare l'elaborazione dal cloud storage e dai data center vicino alla fonte originale, come i dispositivi connessi all'Internet of Things (IoT). Applicare l'apprendimento continuo in modo efficiente su sistemi di edge computing con risorse limitate rimane una sfida, sebbene molti modelli di apprendimento continuo siano stati proposti per risolvere questo problema. I modelli tradizionali richiedono un'elevata potenza di calcolo e una grande capacità di memoria.

Un nuovo tipo di codice per realizzare un sistema di apprendimento continuo efficiente dal punto di vista energetico è stato recentemente progettato da un team di ricercatori della Singapore University of Technology and Design (SUTD), tra cui Shao-Xiang Go, Qiang Wang, Bo Wang, Yu Jiang e Natasa Bajalović. Il team era guidato dal ricercatore principale, l'assistente del professor Desmond Loke di SUTD. Lo studio di questi ricercatori, "Continual Learning Electrical Conduction in Resistive-Switching-Memory Materials", è stato pubblicato sulla rivista Advanced Theory and Simulations .

Il team ha proposto Brain-Inspired Replay (BIR), un modello ispirato al cervello, che esegue l'apprendimento continuo in modo naturale. Il modello BIR, basato sull'uso di una rete neurale artificiale e di un autoencoder variazionale, imita le funzioni del cervello umano e può funzionare bene in situazioni di apprendimento incrementale di classe senza memorizzare dati. I ricercatori hanno anche utilizzato il modello BIR per rappresentare la crescita del filamento conduttivo utilizzando la corrente elettrica nei sistemi di memoria digitale.

"In questo modello, la conoscenza è preservata all'interno di modelli addestrati al fine di ridurre al minimo la perdita di prestazioni all'introduzione di compiti aggiuntivi, senza la necessità di fare riferimento ai dati di lavori precedenti", ha spiegato il professore assistente Loke. "Quindi, questo ci fa risparmiare una notevole quantità di energia."

"Inoltre, è stata raggiunta un'accuratezza all'avanguardia dell'89% nel sfidare la conformità alle attività di apprendimento correnti senza archiviare i dati, che è circa due volte superiore a quella dei tradizionali modelli di apprendimento continuo, nonché un'elevata efficienza energetica,' " ha aggiunto.

Per consentire al modello di elaborare le informazioni sul posto nel mondo reale in modo indipendente, il team prevede di espandere la capacità regolabile del modello nella fase successiva della ricerca.

"Sulla base di dimostrazioni su piccola scala, questa ricerca è ancora nelle sue fasi iniziali", ha affermato il professore assistente Loke. "Ci si aspetta che l'adozione di questo approccio consenta ai sistemi di intelligenza artificiale periferici di progredire in modo indipendente senza il controllo umano". + Esplora ulteriormente