Le decisioni prese dagli ingegneri oggi determineranno come guideranno tutte le auto. Attestazione:Grendelkhan, CC BY-SA

Molte discussioni e riflessioni etiche sulle auto a guida autonoma si sono concentrate su tragici dilemmi, come ipotesi in cui un'auto deve decidere se investire un gruppo di scolari o precipitare da un precipizio, uccidendo i suoi stessi occupanti. Ma questo tipo di situazioni sono casi estremi.

Come l'incidente più recente, in cui un'auto a guida autonoma ha ucciso un pedone a Tempe, Arizona – dimostra, il mondano, situazioni quotidiane ad ogni passaggio pedonale, svolta e intersezione presentano dilemmi etici molto più difficili e più ampi.

Etica degli estremi

Come filosofo che lavora con gli ingegneri del Center for Automotive Research di Stanford, Inizialmente sono rimasto sorpreso dal fatto che abbiamo trascorso le nostre riunioni di laboratorio a discutere di quella che pensavo fosse una domanda facile:come dovrebbe un'auto a guida autonoma avvicinarsi a un passaggio pedonale?

La mia ipotesi era che avremmo pensato a come un'auto dovrebbe decidere tra la vita dei suoi passeggeri e la vita dei pedoni. Sapevo come pensare a tali dilemmi perché questi scenari di incidenti assomigliano a un famoso rompicapo filosofico chiamato "problema del carrello". Immagina che un carrello fuori controllo stia precipitando lungo i binari e sia destinato a colpire un gruppo di cinque persone o una singola persona:ne uccideresti uno per salvarne cinque?

Però, molti filosofi oggi dubitano che indagare su tali questioni sia una fruttuosa strada di ricerca. Barbara Fritti, un collega di Stanford, Per esempio, ha sostenuto che i tragici dilemmi fanno credere alle persone che i dilemmi etici sorgono principalmente in circostanze estreme e terribili.

Infatti, i dilemmi etici sono onnipresenti. Ogni giorno, le situazioni mondane sono sorprendentemente disordinate e complesse, spesso in modo sottile. Ad esempio:la tua città dovrebbe spendere soldi per un programma di prevenzione del diabete o per più assistenti sociali? Se il tuo dipartimento di sanità pubblica locale dovesse assumere un altro ispettore per gli standard di igiene del ristorante, o continuare un programma che fornisce aghi e forniture per iniezione gratuiti?

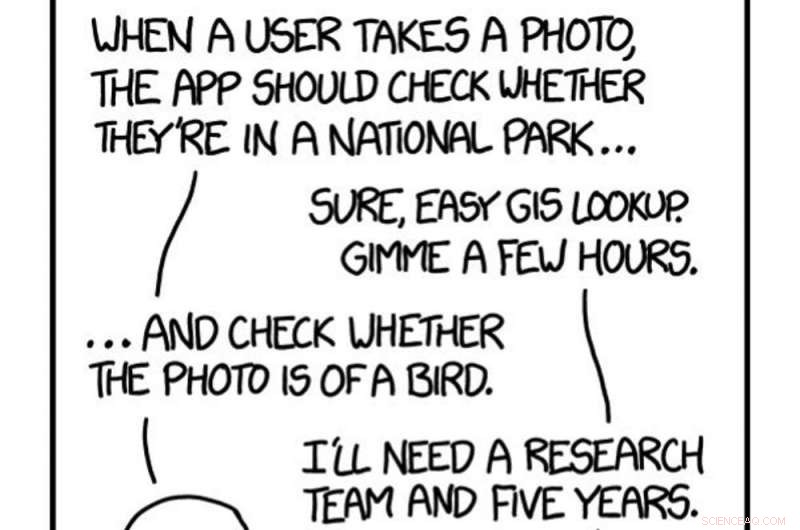

Facile per gli umani spesso significa difficile per i computer. Credito:XKCD, CC BY-SA

È estremamente difficile rispondere a queste domande a causa delle incertezze sulle conseguenze, ad esempio chi sarà interessato e in quale misura. Le soluzioni che i filosofi hanno proposto per situazioni estreme e disperate sono di scarso aiuto qui.

Il problema è simile con le auto a guida autonoma. Pensare a situazioni estreme e scenari di incidenti non può aiutare a rispondere alle domande che sorgono in situazioni banali.

Una sfida alle strisce pedonali

si potrebbe chiedere, cosa può esserci di così difficile in situazioni di traffico ordinarie come avvicinarsi a un passaggio pedonale, attraversando un incrocio, o svoltando a sinistra.Anche se la visibilità al passaggio pedonale è limitata e talvolta è difficile dire se un pedone nelle vicinanze voglia effettivamente attraversare la strada, i conducenti affrontano questo problema ogni giorno.

Ma per le auto a guida autonoma, tali situazioni banali rappresentano una sfida in due modi.

Primo, c'è il fatto che ciò che è facile per gli umani è spesso difficile per le macchine. Che si tratti di riconoscere volti o andare in bicicletta, siamo bravi nella percezione e nei compiti meccanici perché l'evoluzione ha costruito queste abilità per noi. Quella, però, rende queste abilità difficili da insegnare o progettare. Questo è noto come "Paradosso di Moravec".

Secondo, in un futuro in cui tutte le auto sono auto a guida autonoma, piccole modifiche al comportamento di guida farebbero una grande differenza nel complesso. Le decisioni prese dagli ingegneri oggi, in altre parole, determinerà non come guida un'auto, ma come guidano tutte le auto. Gli algoritmi diventano policy.

Gli ingegneri insegnano ai computer come riconoscere volti e oggetti utilizzando metodi di apprendimento automatico. Possono utilizzare l'apprendimento automatico anche per aiutare le auto a guida autonoma a imitare il modo in cui guidano gli umani. Ma questa non è una soluzione:non risolve il problema che le decisioni ad ampio raggio in materia di sicurezza e mobilità sono prese dagli ingegneri.

Per di più, le auto a guida autonoma non dovrebbero guidare come le persone. Gli umani non sono in realtà dei buoni guidatori. E guidano in modi eticamente problematici, decidere se cedere alle strisce pedonali, in base all'età dei pedoni, razza e reddito. Per esempio, ricercatori a Portland hanno scoperto che i pedoni neri passano il doppio delle auto e hanno dovuto aspettare un terzo in più dei pedoni bianchi prima di poter attraversare.

Le auto a guida autonoma dovrebbero guidare in modo più sicuro, e più equamente di quanto non facciano le persone.

Etica mondana

I problemi etici si approfondiscono quando ci si occupa dei conflitti di interesse che emergono in situazioni banali come strisce pedonali, svolte e incroci.

Per esempio, la progettazione delle auto a guida autonoma deve bilanciare la sicurezza degli altri – pedoni o ciclisti – con gli interessi dei passeggeri delle auto. Non appena un'auto va più veloce del passo d'uomo, non è in grado di evitare di sbattere contro un bambino che potrebbe finire sulla strada nell'ultimo secondo. Ma il ritmo di camminata è, Certo, troppo lento. Tutti hanno bisogno di raggiungere i posti. Quindi, come dovrebbero gli ingegneri trovare l'equilibrio tra sicurezza e mobilità? E quale velocità è abbastanza sicura?

Ci sono anche altre questioni etiche che emergono. Gli ingegneri devono trovare un compromesso tra mobilità e impatto ambientale. Quando vengono applicati su tutte le auto del paese, piccoli cambiamenti nell'accelerazione controllata dal computer, le curve e le frenate possono avere enormi effetti sul consumo di energia e sulle emissioni inquinanti. In che modo gli ingegneri dovrebbero bilanciare l'efficienza dei viaggi con l'impatto ambientale?

Quale dovrebbe essere il futuro del traffico?

Le situazioni banali pongono nuovi problemi ingegneristici ed etici, ma portano anche le persone a mettere in discussione i presupposti di base del sistema del traffico.

Per me, Ho iniziato a chiedermi se abbiamo davvero bisogno di posti chiamati "attraversamenti pedonali"? Dopotutto, le auto a guida autonoma possono potenzialmente rendere sicuro l'attraversamento di una strada ovunque.

E non sono solo le strisce pedonali che diventano inutili. Anche i semafori agli incroci potrebbero essere un ricordo del passato. Gli umani hanno bisogno dei semafori per assicurarsi che tutti possano attraversare l'incrocio senza incidenti e caos. Ma le auto a guida autonoma potrebbero coordinarsi tra loro senza problemi.

La domanda più grande qui è questa:dato che le auto a guida autonoma sono migliori dei guidatori umani, perché le auto dovrebbero essere soggette a regole progettate per la fallibilità umana e gli errori umani? E per estendere questo esperimento mentale, consideriamo anche la domanda più generale:se noi, come società, potrebbe progettare il nostro sistema di traffico da zero, come vorremmo che fosse?

Perché queste domande difficili riguardano tutti in una città o in una società, richiedono che una città o una società si accordino sulle risposte. Ciò significa bilanciare gli interessi in competizione in un modo che funzioni per tutti, indipendentemente dal fatto che le persone pensino solo alle strisce pedonali o al sistema del traffico nel suo insieme.

Con le auto a guida autonoma, le società possono ridisegnare i loro sistemi di traffico. Dalle strisce pedonali alla progettazione complessiva del traffico:sono le situazioni banali che sollevano domande davvero difficili. Le situazioni estreme sono una distrazione.

Il problema del carrello non risponde a queste difficili domande.

Questo articolo è stato originariamente pubblicato su The Conversation. Leggi l'articolo originale.