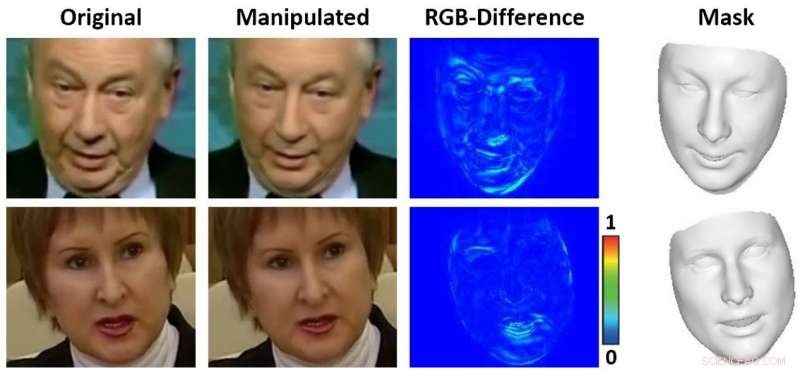

Falso o reale? Esempi del set di dati sull'auto-rievocazione di FaceForensics. Da sinistra a destra:immagine di input originale, immagine di output ricostruita da sé, grafico della differenza di colore e maschera facciale utilizzati durante la sintesi dell'immagine di output. Attestazione:arXiv:1803.09179 [cs.CV]

La manipolazione delle immagini in questa fase avanzata dell'era digitale non è tanto divertente ma un'arma rischiosa, all'ombra di notizie false, influenzare l'opinione pubblica e suscitare scandali.

Scambio di faccia, in particolare, sembra divertente se lo pensi come una risata a un tavolo di famiglia mentre bambini e adulti provano facce diverse su persone diverse. Però, è anche uno strumento per motivi molto peggiori. Swapna Krishna in Engadget ha osservato che "Le persone hanno, Certo, sfruttato questo strumento per alcuni usi inquietanti, compreso lo scambio di volti di persone in video pornografici, il revenge porn definitivo".

In Revisione della tecnologia del MIT , la "Tecnologia emergente da arXiv" ha detto, "Sui siti web sono emersi video pornografici chiamati 'deepfake' che mostrano i volti di personaggi famosi sovrapposti ai corpi degli attori".

Ricercatori, però, interessati ad esplorare lo strumento e a sapere se viene utilizzato, hanno inventato un algoritmo, dicono gli osservatori, che può superare altre tecniche disponibili. Hanno trovato un modo per rilevare uno scambio di volti tramite l'algoritmo, raccogliendo video falsi non appena pubblicati.

Analisi Vidhya commentato, "Era disperatamente necessario qualcosa di simile a questo algoritmo per condurre la battaglia contro gli scambi di volti utilizzati per le ragioni sbagliate. Nel rilasciare il documento di ricerca al pubblico, i ricercatori sperano che anche altri prendano il testimone e lavorino su questo studio per renderlo più accurato e preciso".

Andreas Rossler è stato il team leader dei partecipanti dell'Università tecnica di Monaco di Baviera, Università Federico II di Napoli e Università di Erlangen-Norimberga.

Hanno addestrato l'algoritmo, XceptionNet, utilizzando un ampio set di scambi di volti, disse Engadget .

"Abbiamo stabilito una solida base di risultati per rilevare una manipolazione facciale con moderne architetture di apprendimento profondo, " ha detto Rossler e il team in Revisione della tecnologia del MIT . Le dimensioni contavano.

La dimensione di questo database ha rappresentato un miglioramento significativo rispetto a quanto precedentemente disponibile. "Introduciamo un nuovo set di dati di video manipolati che supera in ordine di grandezza tutti i set di dati forensi disponibili pubblicamente esistenti, ", ha detto Rossler.

Nella loro carta, gli autori hanno affermato di aver introdotto un set di dati per la manipolazione del viso, FaceForensics, "di circa mezzo milione di immagini modificate (da oltre 1000 video)."

Il documento si intitola "FaceForensics:A Large Scale Video Dataset for Forgery Detection in Human Faces, " su arXiv. Gli autori sono Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christian Ries, Justus Thies e Matthias Nießner.

Gli autori hanno richiamato l'attenzione sulla difficoltà, per esseri umani e computer, nel tentativo di distinguere tra video originale e video manipolato, "soprattutto quando i video sono compressi o hanno una bassa risoluzione, come spesso accade sui social network".

Hanno anche richiamato l'attenzione sul fatto che "la ricerca sul rilevamento delle manipolazioni del viso è stata seriamente ostacolata dalla mancanza di set di dati adeguati".

C'è una sfumatura nel loro successo, anche se, anche questo merita attenzione. L'articolo "Emerging Technology from the arXiv" lo chiamava "il pungiglione nella coda". Che cos'è? "La stessa tecnica di deep learning che può individuare i video di scambio di volti può essere utilizzata anche per migliorare la qualità degli scambi di volti in primo luogo, e ciò potrebbe renderli più difficili da rilevare".

Engadget similmente detto, "XceptionNet supera chiaramente le sue tecniche rivali nel rilevare questo tipo di video fasullo, ma in realtà migliora anche la qualità dei falsi. Il team di Rossler può utilizzare i più grandi segni distintivi di uno scambio di volti per rendere la manipolazione più fluida. Non inganna XceptionNet, ma a lungo andare potrebbe rendere più difficile per altri metodi rilevare i video falsi."

Pranav Dar, in Analisi Vidhya , ha anche pesato su quello che ha definito "un avvertimento con questo algoritmo:può anche essere potenzialmente utilizzato per migliorare la qualità degli scambi di volti che renderanno più difficile rilevare il falso. Inoltre, non appena viene lanciato un algoritmo di rilevamento della contraffazione, i truffatori cercano sempre di perfezionare il loro modello per stare un passo avanti".

Ciò nonostante, gli autori hanno detto, "il nostro raffinatore migliora principalmente la qualità visiva, ma ingombra solo leggermente il rilevamento della contraffazione per il metodo di apprendimento profondo addestrato esattamente sui dati di output contraffatti."

© 2018 Tech Xplore