Credito:Microsoft

Un paio di documenti innovativi sulla visione artificiale aprono nuove prospettive sulle possibilità nei regni della creazione di immagini naturali dall'aspetto molto reale e della sintesi realistica, immagini facciali che preservano l'identità. In CVAE-GAN:generazione di immagini a grana fine attraverso l'allenamento asimmetrico, presentato lo scorso ottobre all'ICCV 2017 di Venezia, il team di ricercatori di Microsoft e dell'Università di Scienza e Tecnologia della Cina ha ideato un modello per la generazione di immagini basato su una rete generativa contraddittoria con codificatore automatico variazionale in grado di sintetizzare immagini naturali in quelle che sono note come categorie a grana fine. Le categorie a grana fine includerebbero volti di individui specifici, diciamo delle celebrità, o oggetti del mondo reale come tipi specifici di fiori o uccelli.

I ricercatori – Dong Chen, Fang Wen e Gang Hua di Microsoft, Jianmin Bao, uno stagista presso Microsoft Research, insieme a Houqiang Li della China's University of Science and Technology - nel cercare di costruire modelli generativi efficaci di immagini naturali, erano alle prese con un problema chiave della computer vision:come generare immagini molto diverse ma realistiche variando un numero finito di parametri latenti in relazione alla distribuzione naturale di qualsiasi immagine nel mondo. La sfida consisteva nel creare un modello generativo per acquisire quei dati. Hanno optato per un approccio che utilizza reti generative avversarie combinate con un codificatore automatico variazionale per creare il loro quadro di apprendimento. L'approccio modella qualsiasi immagine come una composizione di etichette e attributi latenti in un modello probabilistico. Variando l'etichetta di categoria a grana fine (ad esempio, "oriole" o "storno" per tipi di uccelli specifici, o i nomi di celebrità specifiche) che sarebbero stati inseriti nel modello generativo, il team è stato in grado di sintetizzare le immagini in categorie specifiche utilizzando valori estratti casualmente rispetto agli attributi latenti. È solo di recente che questo tipo di deep learning rende possibile la modellazione della distribuzione di immagini di oggetti specifici nel mondo, permettendoci di attingere a quel modello per sintetizzare sostanzialmente l'immagine, ha spiegato Gang Hua, ricercatore principale presso Microsoft Research a Redmond, Washington.

"Il nostro approccio ha due aspetti nuovi, " disse Hua. "In primo luogo, abbiamo adottato una perdita di entropia incrociata per la rete discriminante e classificatore, ma abbiamo optato per un obiettivo di discrepanza media per la rete generativa." La funzione di perdita asimmetrica risultante e il suo effetto sugli aspetti di apprendimento automatico del framework sono stati incoraggianti. "La perdita asimmetrica rende effettivamente la formazione dei GAN più stabile, " ha detto Hua. "Abbiamo progettato una perdita asimmetrica per affrontare il problema dell'instabilità nell'addestramento dei GAN vaniglia che affronta specificamente le difficoltà numeriche quando si abbinano due distribuzioni non sovrapposte".

L'altra innovazione è stata l'adozione di una rete di codificatori in grado di apprendere la relazione tra lo spazio latente e utilizzare la corrispondenza delle caratteristiche a coppie per mantenere la struttura delle immagini sintetizzate.

Sperimentare con immagini naturali:fotografie autentiche di cose reali trovate in natura come volti, fiori e uccelli, i ricercatori sono stati in grado di dimostrare che i loro modelli di apprendimento automatico potevano sintetizzare immagini riconoscibili con una varietà impressionante all'interno di categorie molto specifiche. Le potenziali applicazioni coprono tutto, dalla pittura di immagini, all'aumento dei dati e migliori modelli di riconoscimento facciale.

"La nostra tecnologia ha affrontato una sfida fondamentale nella generazione di immagini, quello della controllabilità dei fattori identitari. Questo ci permette di generare immagini come vogliamo che appaiano. ha detto Hua."

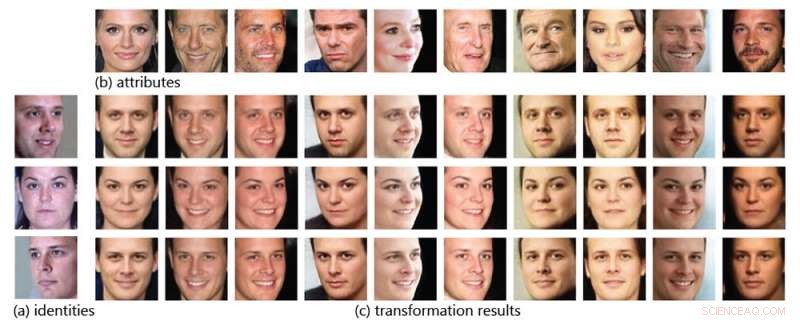

Sintetizzare volti

Come si fa a fare un passo avanti nella sintesi di immagini realistiche di fiori o uccelli? Guardi volti umani. Volti umani, se preso nel contesto dell'identità, sono tra le immagini più sofisticate che si possono catturare in natura. In Verso una sintesi aperta dei volti che preserva l'identità, presentato questo mese al CVPR 2018 a Salt Lake City, i ricercatori hanno sviluppato una struttura basata su GAN in grado di districare l'identità e gli attributi dei volti, con attributi che includono proprietà intrinseche come la forma del naso e della bocca o persino l'età, oltre a fattori ambientali, come l'illuminazione o se il trucco è stato applicato sul viso. Mentre i precedenti processi di sintesi dei volti che preservavano l'identità erano in gran parte limitati alla sintesi di volti con identità note che erano già contenute nel set di dati di addestramento, i ricercatori hanno sviluppato un metodo per ottenere la sintesi del volto che preserva l'identità in domini aperti, ovvero per un volto che non rientrava in alcun set di dati di addestramento. Per fare questo, sono atterrati su un metodo unico di utilizzare un'immagine di input di un soggetto che produrrebbe un vettore di identità e lo combinava con qualsiasi altra immagine di input (non della stessa persona) per estrarre un vettore di attributo, come posa, emozione o illuminazione. Il vettore identità e il vettore attributo vengono quindi ricombinati per sintetizzare un nuovo volto per il soggetto caratterizzato dall'attributo estratto. In particolare, il framework non deve annotare e classificare gli attributi di nessuno dei volti in alcun modo. È addestrato con una funzione di perdita asimmetrica per preservare meglio l'identità e stabilizzare gli aspetti di apprendimento automatico. Impressionante, può anche sfruttare efficacemente enormi quantità di immagini di volti di allenamento senza etichetta (si pensi a immagini facciali casuali) per migliorare ulteriormente la fedeltà o l'accuratezza dei volti sintetizzati.

Un'ovvia applicazione per i consumatori è il classico esempio della sfida del fotografo di scattare una foto di gruppo che include dozzine di soggetti; l'obiettivo comune è lo sfuggente scatto ideale in cui tutti i soggetti vengono catturati ad occhi aperti e persino sorridenti. "Con la nostra tecnologia, la cosa bella è che potrei letteralmente rendere un volto sorridente per ciascuno dei partecipanti allo scatto!" esclama Hua. Ciò che rende questo completamente diverso dal semplice editing delle immagini, dice Hua, è che l'identità effettiva del volto è preservata. In altre parole, sebbene sia sintetizzata l'immagine di un partecipante sorridente, un "momento" che in realtà non si è verificato, il volto è inequivocabilmente quello dell'individuo; la sua identità è stata preservata nel processo di alterazione dell'immagine.

Hua vede molte applicazioni utili che andranno a beneficio della società e vede miglioramenti costanti nel riconoscimento delle immagini, comprensione video e anche le arti.