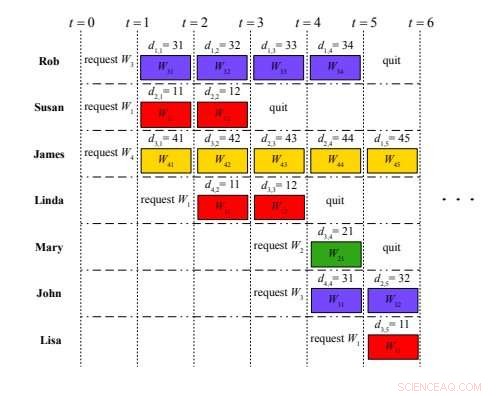

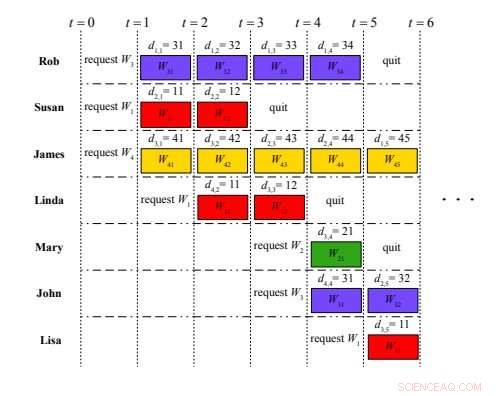

Illustrazione degli arrivi della domanda per un sistema di caching asincrono con N ≥ 4 file e Amax ≥ 3 per le fasce orarie t =da 1 a 6 della fase di consegna. Nell'impostazione di memorizzazione nella cache in esame, abbiamo a1 =3, a2 =1, a3 =0, a4 =2, a5 =1 richiede, e K(1) =3, K(2) =4, K(3) =3, K(4) =4, K(5) =3 utenti serviti in ogni fascia oraria. Credito:Yang, Amiri &Gündüz

I ricercatori dell'Imperial College di Londra hanno sviluppato un nuovo metodo per la memorizzazione nella cache codificata che potrebbe migliorare la distribuzione di contenuti video popolari online. Un documento di ricerca che delinea i loro risultati è stato pre-pubblicato su arXiv, delineando la tecnica e le sue prestazioni rispetto ad altri schemi di memorizzazione nella cache.

Sempre più persone trasmettono contenuti video online, e alcuni video diventano particolarmente popolari, domina il traffico dati wireless. Ciò ha portato allo sviluppo di sistemi di caching proattivi, che precaricano i contenuti video durante i periodi di traffico non di punta e li archiviano ai margini della rete o direttamente nei dispositivi degli utenti. Questi sistemi possono alleviare il carico di traffico e ridurre la latenza su contenuti video particolarmente popolari.

La memorizzazione nella cache proattiva ha due fasi:la fase di posizionamento, in cui il sistema riempie le cache degli utenti durante i periodi di traffico non di punta e la fase di consegna, che si verifica una volta che le richieste degli utenti vengono rivelate (nei momenti di maggiore traffico). I tradizionali schemi di memorizzazione nella cache non codificati utilizzano trasmissioni unicast ortogonali, che comportano un'associazione uno a uno tra il mittente dell'informazione e la sua destinazione, con ogni destinazione che identifica un singolo destinatario.

Un nuovo paradigma, chiamato cache codificata, sfrutta le risorse della cache attraverso una rete, ottimizzare le fasi di posizionamento e consegna creando opportunità di trasmissione multicasting, che comporta l'instradamento simultaneo di datagrammi a più destinatari in un'unica trasmissione. Nel loro studio, i ricercatori hanno proposto una nuova strategia che affronta due limitazioni dei sistemi di caching codificati esistenti.

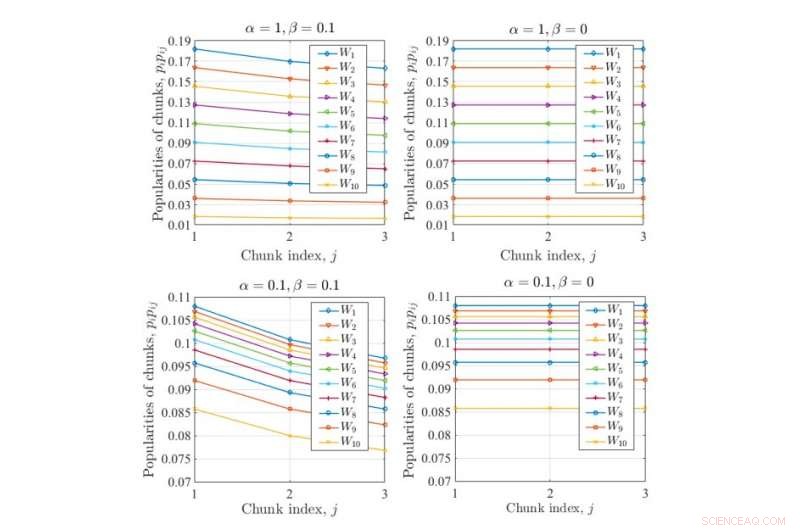

La popolarità dei pezzi video Wij , cioè., pipij dati diversi valori di α e β. Credito:Yang, Amiri &Gündüz

Finora, la maggior parte degli studi che sviluppano metodi per la memorizzazione nella cache codificata si sono concentrati principalmente su scenari statici, in cui un numero fisso di utenti effettua contemporaneamente richieste da una libreria di contenuti. Le prestazioni di questi schemi di memorizzazione nella cache sono misurate dalla latenza nel soddisfare le richieste di tutti gli utenti. Però, in realtà, persone in luoghi diversi iniziano effettivamente a guardare un video online in momenti diversi nel tempo, a volte interrompendolo prima della sua fine. Questo particolare comportamento dell'utente è rappresentato dal tasso di fidelizzazione del pubblico, una misura introdotta dalle principali piattaforme video come YouTube e Netfix, che definisce la parte di un particolare video che viene guardata dagli utenti, in media.

I tassi di fidelizzazione del pubblico possono aiutare i servizi di streaming a comprendere e modellare meglio la popolarità di diverse sezioni di contenuti video tra gli utenti. Nel loro studio, i ricercatori hanno scoperto che la memorizzazione nella cache parziale, in cui vengono memorizzate nella cache solo le parti più visualizzate di un video, potrebbe aiutare a ottenere una memorizzazione nella cache più efficiente.

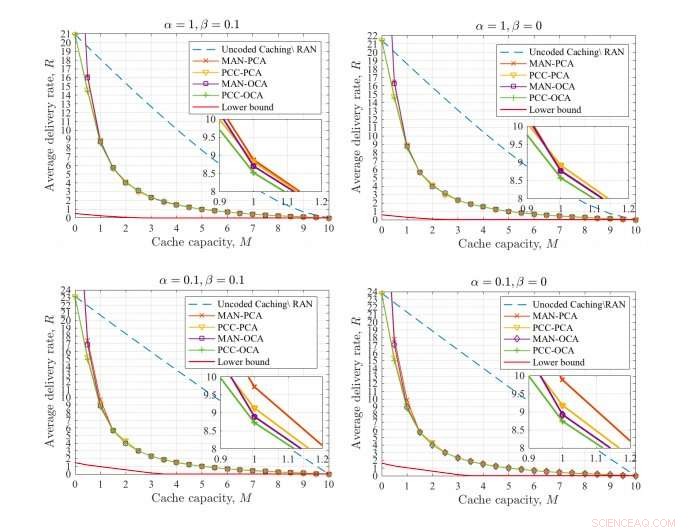

Confronto tra PCC, UOMO, memorizzazione nella cache non codificata e il limite inferiore dati diversi valori di α e β. Credito:Yang, Amiri &Gündüz

"Esaminiamo la memorizzazione nella cache codificata dei file video tenendo conto del tasso di fidelizzazione del pubblico per ogni video, " hanno spiegato i ricercatori nel loro articolo. "Riteniamo che ogni file video sia costituito da blocchi di uguale lunghezza, e il tasso di fidelizzazione del pubblico di ogni blocco è la frazione di utenti che guarda questo blocco tra le visualizzazioni totali del video corrispondente."

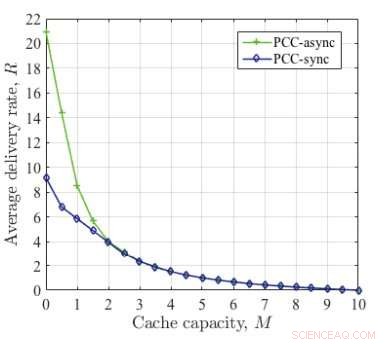

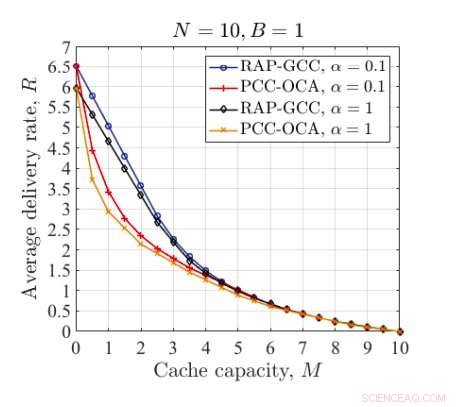

Confronto tra gli scenari di arrivo della domanda asincrono e sincrono, α =1 e =0,1. Credito:Yang, Amiri &Gündüz

Contrariamente alla letteratura precedente sulla memorizzazione nella cache codificata, in cui si presume che gli utenti rivelino le loro richieste contemporaneamente, i ricercatori propongono un modello dinamico di arrivo della domanda, chiamato cache codificata parziale (PCC). Questo modello è più realistico, in quanto considera che gli utenti iniziano e smettono di guardare un video in momenti diversi. Inoltre, i ricercatori hanno proposto due diversi schemi di allocazione della cache, che allocano le cache degli utenti a diversi pezzi dei file video nella libreria; chiamata allocazione della cache ottimale (OCA) e allocazione della cache basata sulla popolarità (PCA).

Confronto tra PCC con OCA e RAP-GCC con α =0,1 e α =1. Credito:Yang, Amiri &Gündüz

"I risultati hanno mostrato un miglioramento significativo con lo schema proposto rispetto alla memorizzazione nella cache non codificata in termini di velocità di consegna media, o l'estensione di altri metodi di consegna noti allo scenario asincrono, " hanno scritto i ricercatori nel loro articolo.

Nel futuro, questo nuovo schema di caching codificato parziale potrebbe aiutare ad affrontare i problemi con la bassa latenza e migliorare la distribuzione dei video popolari online in periodi di traffico dati elevato. Questo potrebbe essere molto utile per le piattaforme di streaming più diffuse, come YouTube, Netflix, e Amazon Prime Video.

Illustrazione degli arrivi della domanda per un sistema di caching asincrono con N ≥ 4 file e Amax ≥ 3 per le fasce orarie t =da 1 a 6 della fase di consegna. Nell'impostazione di memorizzazione nella cache in esame, abbiamo a1 =3, a2 =1, a3 =0, a4 =2, a5 =1 richiede, e K(1) =3, K(2) =4, K(3) =3, K(4) =4, K(5) =3 utenti serviti in ogni fascia oraria. Credito:Yang, Amiri &Gündüz

© 2018 Tech Xplore