L'odio online infuria ancora, spesso in bella vista. Credito:maxicam/Shutterstock.com

Poco dopo la sparatoria nella sinagoga di Pittsburgh, Ho notato che la parola "ebrei" era di tendenza su Twitter. Come ricercatore ed educatore sui social media, Ero preoccupato che la violenza si sarebbe diffusa online, come ha fatto in passato.

L'attività del presunto tiratore della sinagoga sul sito di social media Gab ha attirato l'attenzione sul ruolo di quel sito come alternativa piena di odio alle opzioni più tradizionali come Facebook e Twitter. Queste sono tra le piattaforme di social media che hanno promesso di combattere l'incitamento all'odio e gli abusi online sui loro siti.

Però, mentre esploravo l'attività online dopo la sparatoria, mi è diventato subito chiaro che i problemi non riguardano solo siti come Gab. Piuttosto, l'incitamento all'odio è ancora facile da trovare sui principali siti di social media, compreso Twitter. Ho anche identificato alcuni passaggi aggiuntivi che l'azienda potrebbe intraprendere.

Risposte incomplete ai nuovi termini di odio

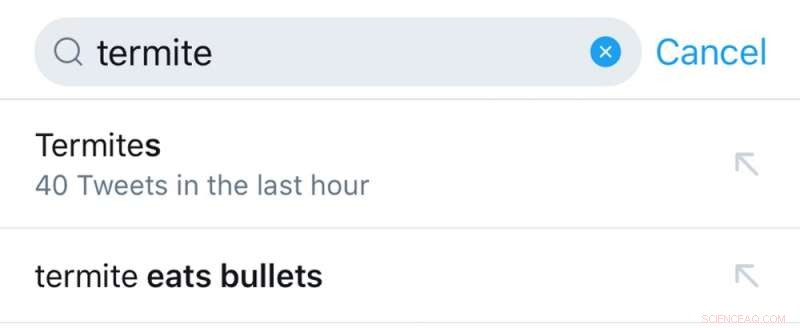

Mi aspettavo che nuove minacce apparissero online riguardo alla sparatoria di Pittsburgh, e c'erano segni che stava accadendo. In un recente attacco antisemita, Il leader della Nation of Islam Louis Farrakhan ha usato la parola "termite" per descrivere il popolo ebraico. ho cercato questo termine, sapendo che i razzisti avrebbero probabilmente usato il nuovo insulto come parola in codice per evitare di essere scoperti quando esprimevano antisemitismo.

Twitter non aveva sospeso l'account di Farrakhan sulla scia dell'ennesima delle sue dichiarazioni antisemite, e la funzione di ricerca di Twitter ha suggerito automaticamente che potrei cercare la frase "la termite mangia i proiettili". Ciò trasforma la casella di ricerca di Twitter in un cartellone pubblicitario.

La società aveva, però, apparentemente aggiustato alcuni dei suoi algoritmi interni, perché nessun tweet con usi antisemiti della parola "termite" è apparso nei miei risultati di ricerca.

Credito:Jennifer Grygiel, CC BY-ND

Post inosservati per anni

Mentre continuavo le mie ricerche per incitamento all'odio e appelli alla violenza contro gli ebrei, Ho trovato prove ancora più inquietanti di carenze nel sistema di moderazione dei contenuti di Twitter. Sulla scia delle elezioni statunitensi del 2016 e della scoperta che Twitter veniva utilizzato per influenzare le elezioni, la società ha affermato che stava investendo nell'apprendimento automatico per "rilevare e mitigare l'effetto sugli utenti di falsi, coordinato, e l'attività automatizzata dell'account." In base a ciò che ho trovato, questi sistemi non hanno individuato nemmeno molto semplice, minacce violente chiare e dirette e incitamento all'odio che sono stati sul suo sito per anni.

Quando ho segnalato un tweet pubblicato nel 2014 che sosteneva l'uccisione di ebrei "per divertimento, "Twitter l'ha rimosso lo stesso giorno, ma il suo avviso Twitter automatizzato standard non ha fornito alcuna spiegazione del motivo per cui è stato lasciato intatto per più di quattro anni.

L'odio gioca il sistema

Quando ho rivisto i tweet odiosi che non erano stati catturati dopo tutti quegli anni, Ho notato che molti non contenevano alcun testo:il tweet era solo un'immagine. Senza testo, i tweet sono più difficili per gli utenti, e gli algoritmi di identificazione dell'odio di Twitter, trovare. Ma gli utenti che cercano specificamente l'incitamento all'odio su Twitter possono quindi scorrere l'attività degli account che trovano, visualizzazione di messaggi ancora più odiosi.

Twitter sembra essere a conoscenza di questo problema:agli utenti che segnalano un tweet viene richiesto di rivedere alcuni altri tweet dallo stesso account e di inviarli contemporaneamente. Questo finisce per sottoporre alcuni più contenuti a revisione, ma lascia comunque spazio ad alcuni di passare inosservati.

Aiuto per i giganti della tecnologia in difficoltà

Poiché ho trovato tweet che ritenevo violassero le politiche di Twitter, Li ho segnalati. La maggior parte di essi è stata rimossa rapidamente, anche entro un'ora. Ma alcuni post ovviamente offensivi hanno impiegato diversi giorni per essere eliminati. Ci sono ancora alcuni tweet testuali che non sono stati rimossi, nonostante violi chiaramente le politiche di Twitter. Ciò dimostra che il processo di revisione dei contenuti dell'azienda non è coerente.

Un esempio di tweet odioso ha permesso di rimanere su Twitter per più di quattro anni. Credito:Jennifer Grygiel, CC BY-ND

Può sembrare che Twitter stia migliorando nella rimozione di contenuti dannosi e che stia rimuovendo molti contenuti e meme e sospendendo gli account, ma molte di queste attività non sono legate all'incitamento all'odio. Piuttosto, gran parte dell'attenzione di Twitter è stata su ciò che la società chiama "manipolazione coordinata, " come bot e reti di profili falsi gestiti da unità di propaganda del governo.

Secondo me, la società potrebbe compiere un passo significativo per sollecitare l'aiuto dei membri del pubblico, così come ricercatori ed esperti come me e i miei colleghi, per identificare i contenuti che incitano all'odio. È comune per le aziende tecnologiche, incluso Twitter, offrire pagamenti a persone che segnalano vulnerabilità di sicurezza nel loro software. Però, tutto ciò che l'azienda fa per gli utenti che segnalano contenuti problematici è inviare un messaggio generato automaticamente dicendo "grazie". La disparità nel modo in cui Twitter tratta i problemi del codice e i rapporti sui contenuti trasmette il messaggio che l'azienda dà la priorità alla sua tecnologia rispetto alla sua comunità.

Anziché, Twitter potrebbe pagare le persone per segnalare contenuti che violano le linee guida della community, offrendo ricompense finanziarie per eliminare le vulnerabilità sociali nel suo sistema, proprio come se quegli utenti lo aiutassero a identificare problemi software o hardware. Un dirigente di Facebook ha espresso preoccupazione per il fatto che questa potenziale soluzione potrebbe ritorcersi contro e generare più odio online, ma credo che il programma di ricompensa potrebbe essere strutturato e progettato in modo da evitare questo problema.

Molto altro da fare

Ci sono ulteriori problemi con Twitter che vanno oltre ciò che viene pubblicato direttamente sul proprio sito. Le persone che pubblicano incitamenti all'odio spesso sfruttano una caratteristica fondamentale di Twitter:la capacità dei tweet di includere collegamenti ad altri contenuti Internet. Questa funzione è fondamentale per il modo in cui le persone usano Twitter, condividere contenuti di reciproco interesse da tutto il web. Ma è anche un metodo per diffondere l'incitamento all'odio.

Ad esempio, un tweet può sembrare totalmente innocente, dicendo "Questo è divertente" e fornendo un collegamento. Ma il collegamento – a contenuti non pubblicati sui server di Twitter – fa apparire un messaggio pieno di odio.

Inoltre, Il sistema di moderazione dei contenuti di Twitter consente solo agli utenti di segnalare tweet odiosi e minacciosi, ma non agli account i cui profili stessi contengono messaggi simili. Alcuni di questi account, inclusi quelli con le immagini del profilo di Adolf Hitler, e nomi e nomi di Twitter che promuovono il rogo degli ebrei – non pubblicare nemmeno tweet o seguire altri utenti di Twitter. A volte possono semplicemente esistere per essere trovati quando le persone cercano parole nei loro profili, trasformando nuovamente la casella di ricerca di Twitter in un sistema di consegna. Questi account possono anche, anche se è impossibile saperlo, essere utilizzati per comunicare con altri su Twitter tramite messaggi diretti, utilizzando la piattaforma come canale di comunicazione nascosto.

Senza tweet o altre attività pubbliche, è impossibile per gli utenti segnalare questi account tramite il sistema di segnalazione dei contenuti standard. Ma sono altrettanto offensivi e dannosi e devono essere valutati e moderati proprio come gli altri contenuti del sito. Poiché le persone che cercano di diffondere l'odio diventano sempre più sofisticate, Le linee guida della community di Twitter, ma soprattutto i suoi sforzi di applicazione, devono essere aggiornati, e tieni il passo.

Se i siti di social media vogliono evitare di diventare - o rimanere - vettori di guerra dell'informazione e piaghe di idee e meme odiosi, hanno bisogno di intensificare molto più attivamente e, Proprio alla fine, far eseguire alle loro migliaia di dipendenti a tempo pieno la moderazione dei contenuti la ricerca come ha fatto un professore nel corso di un fine settimana.

Questo articolo è stato ripubblicato da The Conversation con una licenza Creative Commons. Leggi l'articolo originale.