trovare, e misurare l'incitamento all'odio dell'islamofobia sui social media. Credito:John Gomez/Shutterstock

In una mossa storica, un gruppo di parlamentari ha recentemente pubblicato una definizione operativa del termine islamofobia. Lo hanno definito "radicato nel razzismo", e come "un tipo di razzismo che prende di mira espressioni di musulmani o percepiti musulmani".

Nel nostro ultimo documento di lavoro, volevamo capire meglio la prevalenza e la gravità di tale incitamento all'odio islamofobo sui social media. Tale discorso danneggia le vittime mirate, crea un senso di paura tra le comunità musulmane, e contravviene ai principi fondamentali di correttezza. Ma abbiamo affrontato una sfida chiave:sebbene estremamente dannosa, L'incitamento all'odio islamofobo è in realtà piuttosto raro.

Miliardi di post vengono inviati sui social ogni giorno, e solo un piccolissimo numero di essi contiene ogni sorta di odio. Quindi abbiamo iniziato a creare uno strumento di classificazione utilizzando l'apprendimento automatico che rileva automaticamente se i tweet contengono o meno islamofobia.

Rilevamento dell'incitamento all'odio islamofobo

Sono stati fatti enormi passi avanti nell'uso dell'apprendimento automatico per classificare in modo robusto l'incitamento all'odio più generale, su larga scala e in modo tempestivo. In particolare, sono stati fatti molti progressi per classificare i contenuti in base al fatto che siano odiosi o meno.

Ma l'incitamento all'odio islamofobo è molto più sfumato e complesso di così. Si estende dalla gamma di attacchi verbali, abusare e insultare i musulmani per ignorarli; dall'evidenziare come sono percepiti come "diversi" al suggerire che non sono membri legittimi della società; dall'aggressione al licenziamento. Volevamo tenere conto di questa sfumatura con il nostro strumento in modo da poter classificare se il contenuto è islamofobo o meno e se l'islamofobia è forte o debole.

Abbiamo definito l'incitamento all'odio islamofobo come "qualsiasi contenuto prodotto o condiviso che esprima una negatività indiscriminata contro l'Islam oi musulmani". Questo differisce da, ma è ben allineato con la definizione operativa di islamofobia dei parlamentari, descritto sopra. Secondo le nostre definizioni, la forte islamofobia include affermazioni come "tutti i musulmani sono barbari", mentre l'islamofobia debole include espressioni più sottili, come "I musulmani mangiano un cibo così strano".

Essere in grado di distinguere tra islamofobia debole e forte non solo ci aiuterà a rilevare e rimuovere meglio l'odio, ma anche per comprendere le dinamiche dell'islamofobia, indagare sui processi di radicalizzazione in cui una persona diventa progressivamente più islamofoba, e fornire un supporto migliore alle vittime.

Credito:Vidgen e Yasseri

Impostazione dei parametri

Lo strumento che abbiamo creato si chiama classificatore di machine learning supervisionato. Il primo passo per crearne uno è creare un set di dati di formazione o test:è così che lo strumento impara ad assegnare i tweet a ciascuna delle classi:islamofobia debole, forte islamofobia e nessuna islamofobia. La creazione di questo set di dati è un processo difficile e dispendioso in termini di tempo poiché ogni tweet deve essere etichettato manualmente, quindi la macchina ha una base da cui imparare. Un ulteriore problema è che rilevare l'incitamento all'odio è intrinsecamente soggettivo. Quello che considero fortemente islamofobo, potresti pensare che sia debole, e viceversa.

Abbiamo fatto due cose per mitigare questo. Primo, abbiamo dedicato molto tempo alla creazione di linee guida per l'etichettatura dei tweet. Secondo, avevamo tre esperti che etichettavano ogni tweet, e ha utilizzato test statistici per verificare quanto fossero d'accordo. Abbiamo iniziato con 4, 000 tweet, campionati da un set di dati di 140 milioni di tweet che abbiamo raccolto da marzo 2016 ad agosto 2018. La maggior parte dei 4, 000 tweet non esprimevano alcuna islamofobia, quindi ne abbiamo rimossi molti per creare un set di dati bilanciato, composto da 410 forti, 484 debole, e 447 nessuno (in totale, 1, 341 tweet).

Il secondo passo è stato quello di costruire e mettere a punto il classificatore progettando caratteristiche e selezionando un algoritmo. Le funzionalità sono ciò che il classificatore utilizza per assegnare effettivamente ogni tweet alla classe giusta. La nostra caratteristica principale era un modello di word embedding, un modello di deep learning che rappresenta le singole parole come un vettore di numeri, che può quindi essere utilizzato per studiare la somiglianza delle parole e l'uso delle parole. Abbiamo anche identificato alcune altre caratteristiche dai tweet, come l'unità grammaticale, sentimento e il numero di menzioni delle moschee.

Una volta creato il nostro classificatore, il passo finale è stato valutarlo, cosa che abbiamo fatto applicandolo a un nuovo set di dati di tweet completamente invisibili. Abbiamo selezionato 100 tweet assegnati a ciascuna delle tre classi, quindi 300 in totale, e li hanno rietichettati dai nostri tre programmatori esperti. Questo ci permette di valutare le prestazioni del classificatore, confrontando le etichette assegnate dal nostro classificatore con le etichette effettive.

Il principale limite del classificatore era che faceva fatica a identificare i tweet islamofobici deboli poiché questi spesso si sovrapponevano a quelli forti e non islamofobici. Detto ciò, globale, la sua performance è stata forte. L'accuratezza (il numero di tweet correttamente identificati) era del 77% e la precisione del 78%. Grazie al nostro rigoroso processo di progettazione e collaudo, possiamo fidarci del fatto che il classificatore avrà probabilmente prestazioni simili quando viene utilizzato su larga scala "in the wild" su dati Twitter invisibili.

Usando il nostro classificatore

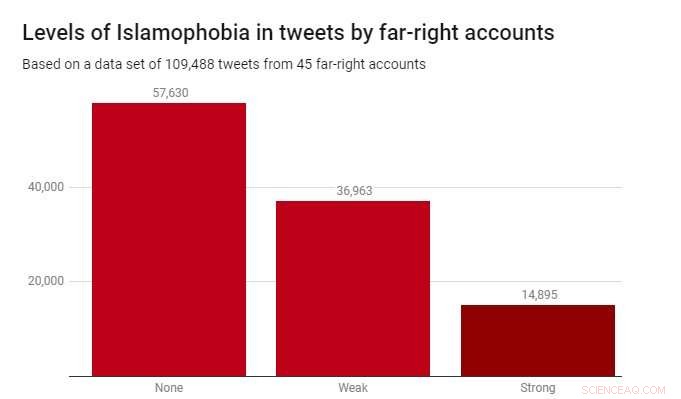

Abbiamo applicato il classificatore a un set di dati di 109, 488 tweet prodotti da 45 account di estrema destra nel 2017. Questi sono stati identificati dall'ente di beneficenza Hope Not Hate nei loro rapporti State of Hate 2015 e 2017. Il grafico sottostante mostra i risultati.

Mentre la maggior parte dei tweet – 52,6% – non erano islamofobici, l'islamofobia debole era considerevolmente più prevalente (33,8%) dell'islamofobia forte (13,6%). Ciò suggerisce che la maggior parte dell'islamofobia in questi resoconti di estrema destra è sottile e indiretta, piuttosto che aggressivo o palese.

Rilevare l'incitamento all'odio islamofobo è una sfida reale e urgente per i governi, aziende tecnologiche e accademici. Purtroppo, questo è un problema che non scomparirà e non ci sono soluzioni semplici. Ma se vogliamo seriamente rimuovere l'incitamento all'odio e l'estremismo dagli spazi online, e rendere le piattaforme di social media sicure per tutti coloro che le utilizzano, allora dobbiamo iniziare con gli strumenti appropriati. Il nostro lavoro mostra che è del tutto possibile realizzare questi strumenti, non solo per rilevare automaticamente i contenuti che incitano all'odio, ma anche per farlo in modo sfumato e dettagliato.

Questo articolo è stato ripubblicato da The Conversation con una licenza Creative Commons. Leggi l'articolo originale.