Credito:Andriano.cz/Shutterstock

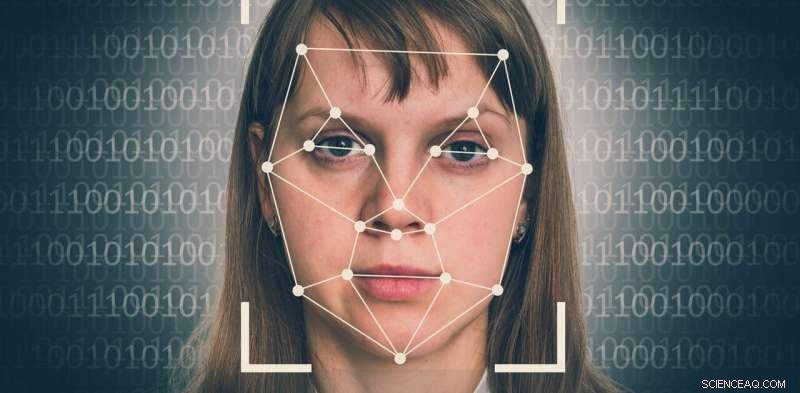

Ha il potenziale per rovinare le relazioni, reputazioni e la nostra realtà online. La tecnologia di intelligenza artificiale "Deepfake" promette di creare video falsificati così realistici che è quasi impossibile distinguerli dalla realtà. Finora è stato utilizzato principalmente per creare clip pornografiche alterate con volti di donne famose, ma una volta che le tecniche sono state perfezionate, deepfake revenge porn che pretende di mostrare alle persone che tradiscono i loro partner non sarà molto indietro.

Ma più che diventare un brutto strumento per stalker e molestatori, i deepfake minacciano di minare la fiducia nelle istituzioni politiche e nella società nel suo insieme. La Casa Bianca ha recentemente giustificato il divieto temporaneo di un giornalista dalle sue conferenze stampa utilizzando, secondo quanto riferito, filmati autentici di un incidente che coinvolge il giornalista. Immagina le implicazioni di vedere filmati ultrarealistici ma artificiali di leader di governo che pianificano omicidi, CEO in collusione con agenti stranieri o un famoso filantropo che abusa dei bambini.

Le cosiddette fake news hanno già aumentato lo scetticismo di molte persone nei confronti dei politici, giornalisti e altri personaggi pubblici. Sta diventando così facile creare scenari interamente immaginari che non possiamo più fidarci di alcun filmato al valore nominale. Questo minaccia la nostra politica, sistemi legali e dei media, per non parlare dei nostri rapporti personali. Avremo bisogno di creare nuove forme di consenso su cui fondare la nostra realtà sociale. Nuovi modi di controllare e distribuire il potere, alcuni politici, un po' di tecnologia, potrebbe aiutarci a raggiungere questo obiettivo.

scandali falsi, falsi politici

I deepfake fanno paura perché consentono di cooptare l'immagine di chiunque, e mettono in discussione la nostra capacità di fidarci di ciò che vediamo. Un uso ovvio dei deepfake sarebbe quello di coinvolgere falsamente le persone negli scandali. Anche se il filmato incriminante viene successivamente dimostrato di essere falso, il danno alla reputazione della vittima può essere impossibile da riparare. E i politici potevano modificare vecchi filmati di se stessi per far sembrare che avessero sempre sostenuto qualcosa che era diventato popolare di recente, aggiornando le proprie posizioni in tempo reale.

Potrebbero esserci anche personaggi pubblici del tutto immaginari, originale ma non autentico. Nel frattempo, le riprese video potrebbero diventare inutili come prova in tribunale. Le notizie trasmesse potrebbero essere ridotte a persone che discutono se le clip fossero autentiche o meno, utilizzando un'intelligenza artificiale sempre più complessa per cercare di rilevare i deepfake.

Ma la corsa agli armamenti che esiste già tra i creatori di contenuti falsi e coloro che rilevano o smascherano la disinformazione (come la "war room" pianificata per le fake news di Facebook) nasconde un problema più profondo. La semplice esistenza di deepfake mina la fiducia e la fiducia, così come la possibilità che un'elezione sia stata violata mette in dubbio la validità del risultato.

Mentre alcune persone possono essere ingannate dai deepfake, non è questo il vero problema. La posta in gioco è la struttura sociale sottostante in cui siamo tutti d'accordo che esiste una qualche forma di verità, e le realtà sociali che si fondano su questa fiducia. Non si tratta della fine della verità, ma la fine della fede nella verità:una società post-trust. Sulla scia di una massiccia disinformazione, anche le figure pubbliche oneste saranno facilmente ignorate o screditate. Le organizzazioni tradizionali che hanno sostenuto e consentito il consenso – governo, la stampa – non sarà più adatta allo scopo.

Fiducia blockchain

Nuove leggi per regolamentare l'uso dei deepfake saranno importanti per le persone che ne hanno realizzati video dannosi. Ma la politica e la legge da sole non salveranno i nostri sistemi di governo. Avremo bisogno di sviluppare nuove forme di consenso, nuovi modi per concordare situazioni sociali basate su forme alternative di fiducia.

Un approccio sarà quello di decentralizzare la fiducia, in modo che non abbiamo più bisogno di poche istituzioni per garantire l'autenticità delle informazioni e possiamo invece fare affidamento su più persone o organizzazioni con una buona reputazione. Un modo per farlo potrebbe essere quello di utilizzare blockchain, la tecnologia che alimenta Bitcoin e altre criptovalute.

Blockchain funziona creando un registro pubblico archiviato su più computer in tutto il mondo contemporaneamente e reso a prova di manomissione dalla crittografia. I suoi algoritmi consentono ai computer di concordare la validità di eventuali modifiche al registro, rendendo molto più difficile registrare informazioni false. In questo modo, la fiducia è distribuita tra tutti i computer che possono scrutarsi a vicenda, crescente responsabilità.

Società più democratica

Possiamo anche guardare a forme di governo e giornalismo più democratiche. Per esempio, la democrazia liquida consente agli elettori di votare direttamente su ogni questione o di assegnare temporaneamente i propri voti ai delegati in modo più flessibile e responsabile rispetto al passaggio del pieno controllo a un partito per anni. Ciò consentirebbe al pubblico di rivolgersi agli esperti per prendere decisioni al posto loro ove necessario, ma eliminerebbe rapidamente i politici che hanno ignorato le loro opinioni o hanno agito in modo disonesto, aumentare la fiducia e la legittimità nel sistema politico.

Nella stampa, potremmo passare a notizie più collaborative e democratizzate. I giornalisti tradizionali potrebbero utilizzare gli aspetti positivi dei social media per raccogliere informazioni da una gamma più diversificata di fonti. Questi contributori potrebbero quindi discutere e aiutare a scrutare la storia per costruire un consenso, migliorare la reputazione dei media.

Il problema con qualsiasi sistema che si basa sulla reputazione di individui chiave per creare fiducia è come impedire che tale reputazione venga utilizzata in modo improprio o danneggiata in modo fraudolento. Controlli come la verifica dell'account "segno di spunta blu" di Twitter per i personaggi pubblici possono aiutare, ma servono anche migliori tutele legali e tecniche:diritti più tutelati alla privacy, risposte migliori al comportamento antisociale online, e migliori tecnologie di miglioramento della privacy integrate dal design.

Le potenziali ramificazioni dei deepfake dovrebbero fungere da invito all'azione nel ridisegnare i sistemi di fiducia per essere più aperti, più decentralizzato e più collettivo. Ed ora è il momento di iniziare a pensare a un futuro diverso per la società.

Questo articolo è stato ripubblicato da The Conversation con una licenza Creative Commons. Leggi l'articolo originale.