I ricercatori utilizzano la differenziazione automatica e altre tecniche per rendere il deep learning più rapido e semplice. Credito:Purdue University

I sistemi di intelligenza artificiale basati sul deep learning stanno cambiando i dispositivi elettronici che ci circondano.

I risultati di questo deep learning sono qualcosa che si vede ogni volta che un computer capisce il nostro discorso, cerchiamo una foto di un amico o vediamo un annuncio posizionato in modo appropriato. Ma lo stesso deep learning richiede enormi cluster di computer e corse di una settimana.

"I metodi sviluppati dal nostro team internazionale ridurranno questo onere, " ha detto Jeffrey Mark Siskind, professore di ingegneria elettrica e informatica nel College of Engineering di Purdue. "I nostri metodi consentono alle persone con computer più modesti di eseguire i tipi di deep learning che un tempo richiedevano cluster multimilionari, e consentire ai programmatori di scrivere programmi in ore che prima richiedevano mesi."

Il deep learning utilizza al suo interno un particolare tipo di calcolo:una tecnica intelligente, denominata differenziazione automatica (AD) nella modalità di accumulo inverso, per calcolare in modo efficiente come le modifiche a un numero elevato di controlli influenzeranno un risultato.

"Sistemi software sofisticati e giganteschi cluster di computer sono stati costruiti per eseguire questo particolare calcolo, " disse Barak Pearlmutter, professore di informatica alla Maynooth University in Irlanda, e l'altro principale di questa collaborazione. "Questi sistemi sono alla base di gran parte dell'intelligenza artificiale nella società:riconoscimento vocale, ricerca Internet, comprensione dell'immagine, riconoscimento facciale, traduzione automatica e il posizionamento di annunci pubblicitari."

Una delle principali limitazioni di questi sistemi di deep learning è che supportano questo particolare calcolo AD in modo molto rigido.

"Questi sistemi funzionano solo su tipi molto ristretti di programmi per computer:quelli che consumano numeri sul loro input, eseguire le stesse operazioni numeriche su di essi indipendentemente dai loro valori, ed emettere i numeri risultanti, " ha detto Siskind.

I ricercatori hanno affermato che un'altra limitazione è che l'operazione AD richiede una grande quantità di memoria del computer. Queste restrizioni limitano le dimensioni e la complessità dei sistemi di deep learning che possono essere costruiti. Per esempio, rendono difficile costruire un sistema di deep learning che esegua una quantità variabile di calcoli a seconda della difficoltà del particolare input, uno che cerca di anticipare le azioni di un utente adattivo intelligente, o uno che produce come output un programma per computer.

Siskind ha affermato che la collaborazione mira a revocare queste restrizioni.

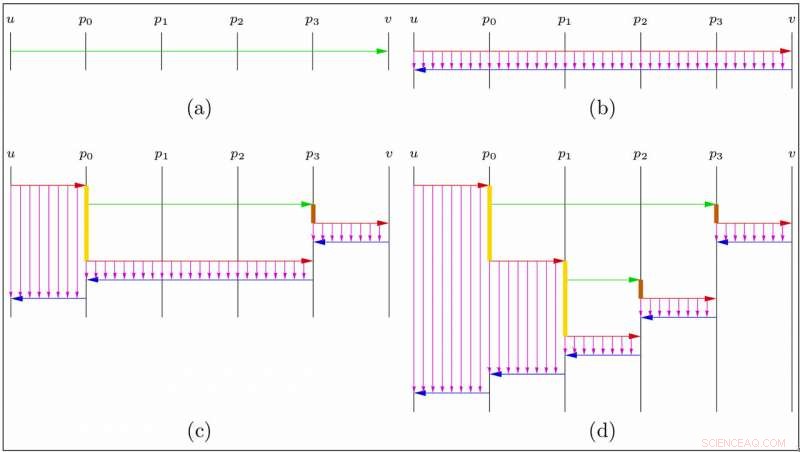

Una serie di innovazioni consente non solo l'AD in modalità inversa, ma altri modi di AD, da utilizzare in modo efficiente; affinché queste operazioni siano in cascata, e applicato non solo a calcoli rigidi ma anche a programmi per computer arbitrari; per aumentare l'efficienza di questi processi; e per ridurre notevolmente la quantità di memoria del computer richiesta.

"Di solito questo tipo di guadagni arriva al prezzo di aumentare l'onere per i programmatori di computer, " Disse Siskind. "Ecco, le tecniche sviluppate consentono questa maggiore flessibilità ed efficienza, riducendo notevolmente il lavoro che i programmatori di computer che costruiscono sistemi di intelligenza artificiale dovranno svolgere".

Per esempio, una tecnica chiamata "checkpoint reverse AD" per ridurre i requisiti di memoria era precedentemente nota, ma potrebbe essere applicato solo in impostazioni limitate, era molto ingombrante, e richiedeva una grande quantità di lavoro extra da parte dei programmatori di computer che costruivano i sistemi di deep learning.

Un metodo sviluppato dal team consente la riduzione dei requisiti di memoria da applicare a qualsiasi programma per computer, e non richiede lavoro aggiuntivo da parte dei programmatori di computer che costruiscono i sistemi di intelligenza artificiale.

"La massiccia riduzione della RAM necessaria per l'addestramento dei sistemi di intelligenza artificiale dovrebbe consentire la costruzione di sistemi più sofisticati, e dovrebbe consentire l'apprendimento automatico su macchine più piccole:smartphone invece di enormi cluster di computer, " ha detto Siskind.

Nel complesso, questa tecnologia ha il potenziale per rendere molto più semplice la creazione di sofisticati sistemi di intelligenza artificiale basati sull'apprendimento profondo.

"Questi progressi teorici vengono integrati in un'implementazione completa altamente efficiente che funziona sia su CPU che su GPU e supporta un'ampia gamma di componenti standard utilizzati per costruire modelli di deep learning, " ha detto Siskind.