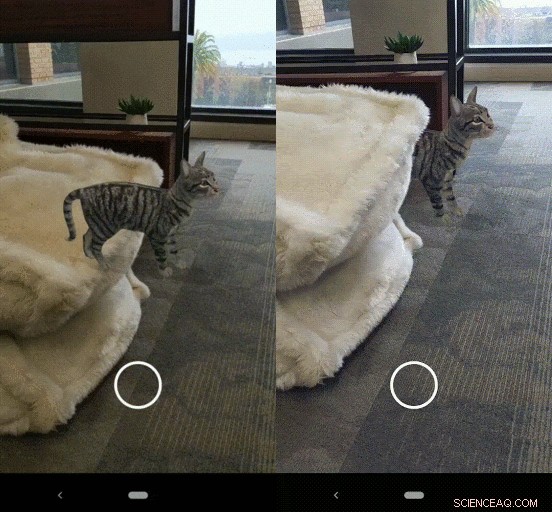

Un gatto virtuale con occlusione disattivata e con occlusione attiva. Credito:Google

Così, una fotocamera per smartphone va bene solo per scattare istantanee? Non portare discorsi del genere agli ingegneri della realtà aumentata di Google. Unire il reale e il virtuale - e vincere oggetti speciali per fondere il reale con il virtuale - è ciò che Google ha in mente come motivazione per gli sviluppatori che vogliono approfondire l'AR.

"Siamo abituati all'AR a portata di mano, regalandoci esperienze utili e divertenti. I tuoi contenuti, anche se, spesso sembra che sia incollato sullo schermo piuttosto che nel mondo." Questo è Konstantine Tsotsos, ingegnere del software, Google, parlando in un video. Chiede allettante (come ha fatto il team di Google), "E se ARCore potesse potenziare la tua fotocamera? Portare il mondo nel tuo telefono?" Così, come? Dandoti colore. E profondità.

Google continua a far girare la testa con la sua piattaforma, l'ultimo avanzamento dei quali sta portando fuori una funzione di profondità. ARCore ti consente di creare esperienze di realtà aumentata. "Utilizzando diverse API, ARCore consente al telefono di rilevare il suo ambiente, comprendere il mondo e interagire con le informazioni.

Questo video in cui è apparso Tsotsos era per introdurre l'API ARCore Depth. In realtà, il video si è rivelato tanto un invito alla collaborazione quanto un annuncio di funzionalità della piattaforma.

Gli ingegneri ritengono che questo progresso di profondità stia solo grattando la superficie di ciò che è possibile con la nuova funzionalità. "Abbiamo bisogno di sviluppatori come te, aiutaci anche tu a costruire il futuro." Ha detto che coloro che hanno idee che vorrebbero costruire utilizzando l'API Depth possono compilare un modulo.

Ha detto che stavano cercando sviluppatori nel 2020 per aiutarli a costruire una nuova ondata di esperienze AR e non vedevano l'ora di vedere cosa costruissero con l'API Depth. Gli sviluppatori potrebbero aiutarli a "esplorare e testare l'API Depth nelle app del mondo reale su larga scala, con un piano per rendere la funzione ampiamente disponibile."

Nicole Lee in Engadget ha detto che Google stava incorporando una "Depth API" che introdurrà l'occlusione, comprensione 3D, e un nuovo livello di realismo. Lee era nell'ufficio di Google di San Francisco dove ha visitato gli sviluppatori che lavorano con la nuova API ARCore Depth per creare una mappa di profondità utilizzando una normale fotocamera per smartphone. Ha detto che una "profonda comprensione del mondo" ha permesso agli sviluppatori di giocare con "la fisica del mondo reale, interazione di superficie e altro ancora."

Questa è una nuova offerta nella piattaforma e consente di creare una mappa di profondità tramite algoritmi di profondità dal movimento e una singola telecamera. Quando viene utilizzato, ARCore sta facendo due cose:(1) tracciare la posizione del dispositivo mobile mentre si muove, e (2) costruire la sua comprensione del mondo reale.

Un'esperienza demo che abbiamo creato in cui devi schivare e lanciare cibo a un robot chef. Credito:Google

Shahram Izadi, Direttore della Ricerca e Ingegneria, scrivendo nel blog di Google Developers, ha spiegato cosa sta succedendo per dare agli sviluppatori i loro risultati realistici:

"L'API ARCore Depth consente agli sviluppatori di utilizzare i nostri algoritmi di profondità dal movimento per creare una mappa di profondità utilizzando una singola fotocamera RGB. La mappa di profondità viene creata prendendo più immagini da diverse angolazioni e confrontandole mentre muovi il telefono per stimare il distanza da ogni pixel."

Un aggiornamento della tecnologia ARCore di Google può rilevare la profondità in una stanza e nascondere oggetti virtuali dietro quelli reali utilizzando solo una singola fotocamera del telefono, ha detto CNET, "e i primi risultati sembrano promettenti".

Aspettati un tempo reale, rappresentazione pixel per pixel della distanza dalle superfici fisiche nella vista della telecamera.

L'occlusione è l'abilitazione attualmente in mostra nelle opportunità di intelligenza artificiale "immersive" di Google per gli sviluppatori. "Inizieremo a rendere disponibile l'occlusione in Scene Viewer, " disse Izadi, "lo strumento per sviluppatori che potenzia l'AR nella ricerca, a un set iniziale di oltre 200 milioni di dispositivi Android abilitati per ARCore oggi [il blog è stato pubblicato il 9 dicembre]."

Si diceva che oltre 200 dispositivi Android fossero compatibili con ARCore. "Con una sola telecamera in movimento, Tsotsos ha detto nel video, "possiamo darvi una comprensione 3-D del mondo in oltre 200 milioni di telefoni Android." Ha detto che possono iniziare a occludere oggetti (come l'animale in agguato tra i cespugli sullo schermo del suo telefono).

David Kim, un altro ingegnere informatico di Google, preso da lì. Ha detto che quando una telecamera capisce lo spazio 3-D, la fotocamera ha alcune opzioni positive, dove può scontrarsi con il mondo, o anche attenersi ad esso, invece di rimbalzare.

Così, i personaggi si muovono nel tuo spazio in modo naturale. Poi c'è l'altro vantaggio di particelle dall'aspetto realistico nella scena:neve che si accumula, pioggia scrosciante. Ora, ha detto Kim, se il tuo telefono ha un sensore di profondità attivo, tutti questi effetti dello spazio di profondità possono migliorare ulteriormente.

Izadi ha ripetuto l'invito al reclutatore:"Se sei interessato a provare la nuova API Depth, si prega di compilare il nostro modulo di chiamata per collaboratori."

© 2019 Scienza X Rete