Credito:Zhang et al.

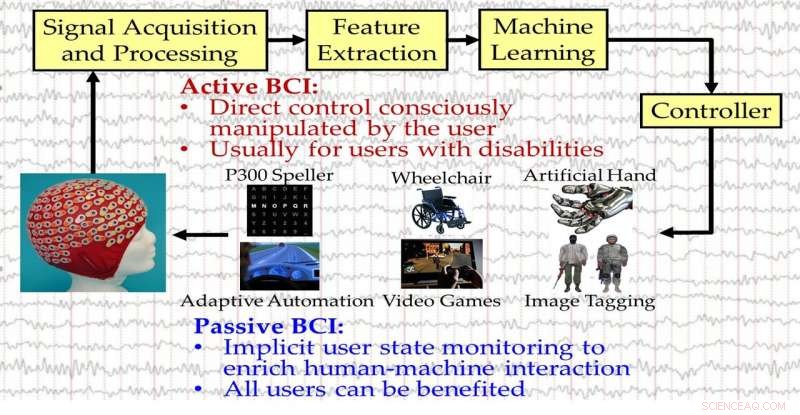

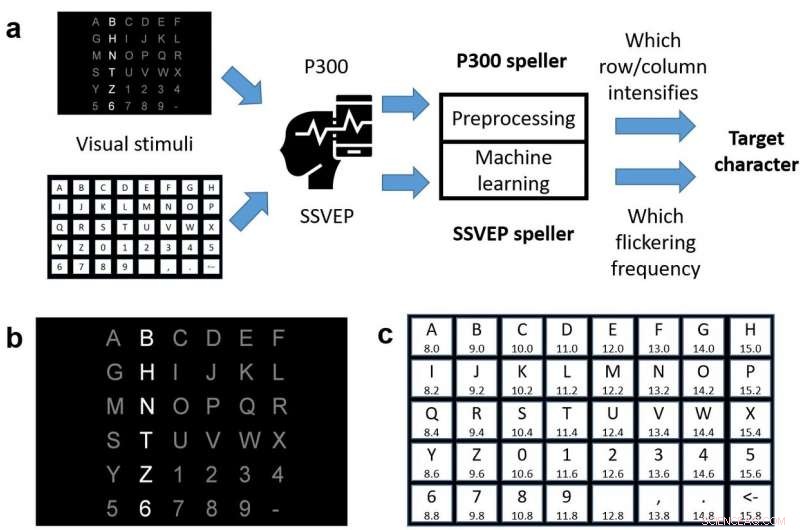

Le interfacce cervello-computer (BCI) sono strumenti in grado di connettere il cervello umano con un dispositivo elettronico, tipicamente utilizzando l'elettroencefalografia (EEG). Negli ultimi anni, i progressi nell'apprendimento automatico (ML) hanno consentito lo sviluppo di ortografici BCI più avanzati, dispositivi che consentono alle persone di comunicare con i computer utilizzando i propri pensieri.

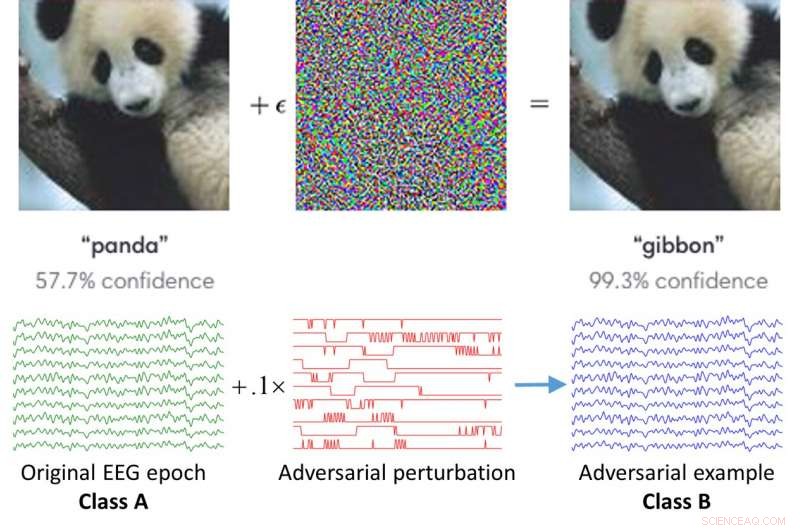

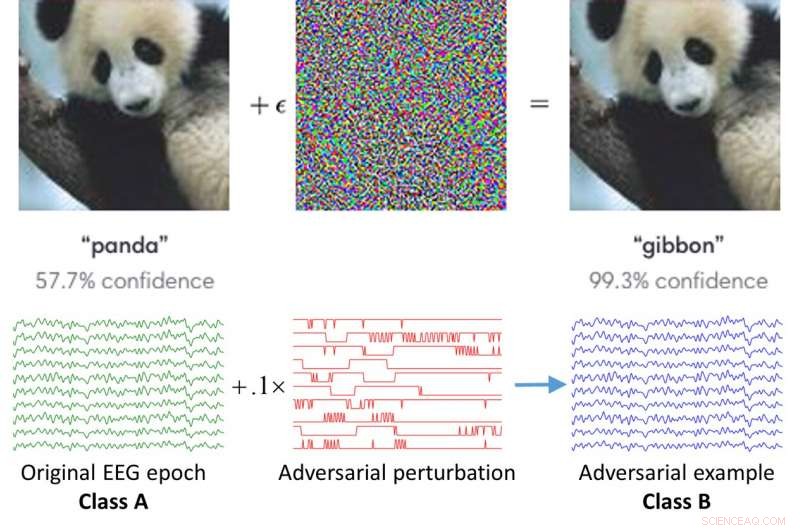

Finora, la maggior parte degli studi in questo settore si è concentrata sullo sviluppo di classificatori BCI più veloci e affidabili, piuttosto che indagare sulle loro possibili vulnerabilità di sicurezza. Ricerca recente, però, suggerisce che gli algoritmi di apprendimento automatico a volte possono essere ingannati dagli aggressori, se sono utilizzati nella visione artificiale, riconoscimento vocale, o altri domini. Questo viene spesso fatto usando esempi contraddittori, che sono minuscole perturbazioni nei dati che sono indistinguibili dagli esseri umani.

I ricercatori della Huazhong University of Science and Technology hanno recentemente condotto uno studio sulla sicurezza degli speller BCI basati su EEG, e più specificamente, come sono influenzati dalle perturbazioni contraddittorie. La loro carta, pre-pubblicato su arXiv, suggerisce che gli speller BCI sono ingannati da queste perturbazioni e sono quindi altamente vulnerabili agli attacchi avversari.

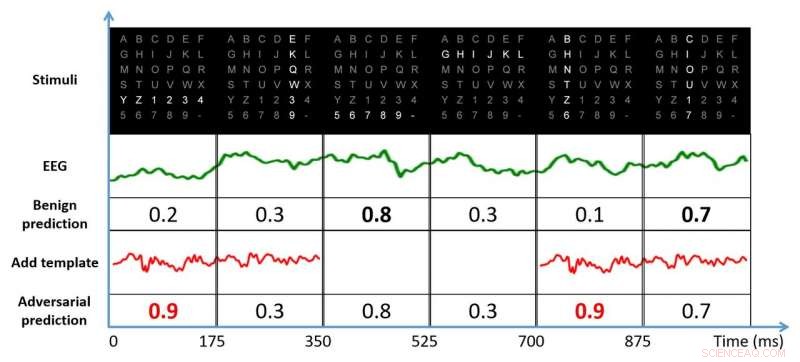

"Questo articolo mira a esporre un problema di sicurezza critico negli speller BCI basati su EEG e, più in generale, BCI basati su EEG, che ha ricevuto poca attenzione prima, "Dongrui Wu, uno dei ricercatori che ha condotto lo studio, ha detto a TechXplore. "Dimostra che si possono generare minuscoli modelli di perturbazione EEG contraddittori per attacchi target sia per P300 che per speller a potenziale evocato visivo allo stato stazionario (SSVEP), cioè., indurre in errore la classificazione a qualsiasi personaggio l'attaccante vuole, indipendentemente da quale sia il carattere voluto dall'utente."

Credito:Zhang et al.

Gli speller P300 BCI sono già utilizzati in diverse impostazioni, anche nelle cliniche, valutare o rilevare disturbi della coscienza. Gli attacchi contraddittori agli speller BCI potrebbero quindi avere numerose conseguenze, che vanno da semplici problemi di usabilità a gravi diagnosi errate del paziente.

"Riteniamo che una nuova e più dettagliata comprensione di come le perturbazioni EEG contraddittorie influenzino la classificazione BCI possa informare la progettazione di BCI per difendersi da tali attacchi, "Spiega Wu.

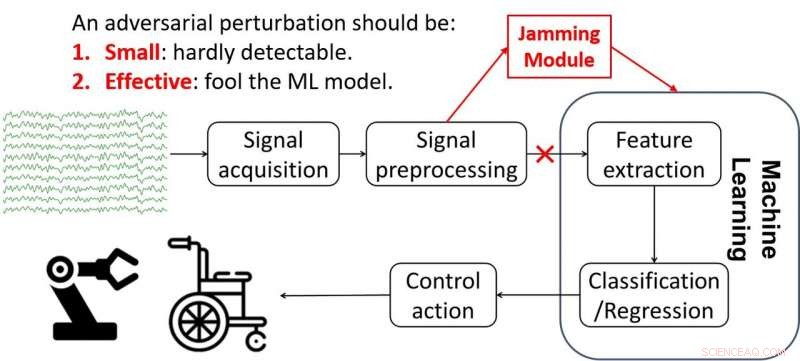

Wu e i suoi colleghi hanno scoperto che per portare a termine con successo un attacco contraddittorio su uno speller BCI, l'attaccante deve solo accedere ad alcuni dei dati utilizzati per addestrare il dispositivo. Può usare questi dati per addestrare il modello di perturbazione, successivamente aggiungendo il modello a prove EEG benigne per eseguire l'attacco.

Gli attuali approcci per condurre attacchi contraddittori hanno due limitazioni principali. Primo, richiedono alcuni campioni EEG specifici del soggetto per creare il modello di perturbazione contraddittorio. Secondo, per eseguire l'attacco in modo più efficace, l'attaccante deve conoscere il momento esatto dello stimolo EEG. Se l'attaccante supera con successo queste limitazioni, l'impatto del suo attacco potrebbe essere molto maggiore.

Credito:Zhang et al.

"La difesa dagli attacchi avversari è un problema di ricerca comune in molte applicazioni di machine learning, per esempio., visione computerizzata, riconoscimento vocale, e BCI, " Wu ha detto. "Se conosciamo l'approccio che l'attaccante prende, allora possiamo sviluppare strategie per difenderci, proprio come ci difendiamo dai virus informatici:prima scoppia un virus e poi troviamo il modo per ucciderlo."

Gli aggressori cercano sempre di trovare nuovi modi per eludere le misure di sicurezza, quindi è importante che i ricercatori continuino a indagare sulle vulnerabilità del sistema e trovino nuove misure di sicurezza. Sebbene sia inevitabile sviluppare soluzioni di sicurezza mirate dopo che è stata identificata una vulnerabilità specifica, scoprire problemi generali con un sistema e prendere precauzioni può essere molto utile.

Lo studio condotto da Wu e dai suoi colleghi ha contribuito a svelare i rischi generali per la sicurezza associati ai BCI basati su EEG. Le loro scoperte potrebbero aiutare a identificare soluzioni provvisorie che potrebbero ridurre l'impatto degli attacchi contraddittori su questi dispositivi.

Credito:Zhang et al.

Credito:Zhang et al.

Credito:Zhang et al.

Wu e i suoi colleghi sperano che la loro ricerca incoraggerà gli altri a indagare sui limiti e le vulnerabilità degli speller basati su EEG o di altri dispositivi BCI. Le loro scoperte potrebbero in definitiva aprire la strada allo sviluppo di tecniche per rafforzare la sicurezza delle BCI, prevenire diagnosi errate e altri effetti indesiderati degli attacchi contraddittori.

"Vogliamo sottolineare che l'obiettivo di questo studio non è danneggiare i BCI basati su EEG, ma per dimostrare che sono possibili gravi attacchi contraddittori ai BCI basati su EEG e quindi esporre un problema di sicurezza critico che ha ricevuto poca attenzione prima, " Wu ha detto. "Nella nostra ricerca futura, abbiamo in programma di sviluppare strategie per difenderci da tali attacchi. Nel frattempo, speriamo che il nostro studio possa attirare più attenzione dei ricercatori sulla sicurezza dei BCI basati su EEG".

© 2020 Scienza X Rete