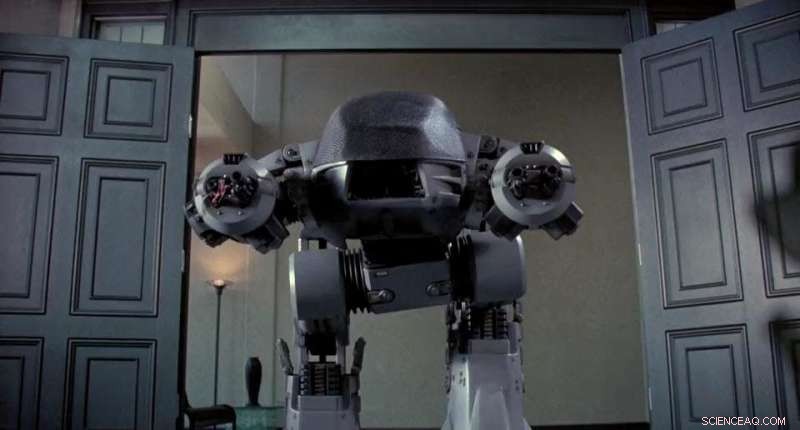

Il robot ED-209 del film RoboCop non si è comportato come previsto. Credito:IMDB/RoboCop

Immagina di vivere in una città intelligente che conosce il tuo volto e segue ogni tuo movimento:i luoghi in cui vai, le persone che vedi, e tutte le cose che fai lungo la strada.

Col tempo, l'intelligenza artificiale autonoma (AI) costruisce un profilo che riporta la probabilità di commettere un crimine. Quando il rischio è alto, la polizia interviene preventivamente. Benvenuto nell'iper-sorveglianza e nella prossima generazione di polizia predittiva.

Sia l'India che la Cina stanno attualmente implementando questo livello di sorveglianza per ridurre i tassi di criminalità e individuare i terroristi prima che colpiscano.

Il Giappone sta anche esaminando i sistemi predittivi in vista delle Olimpiadi di Tokyo del 2020. Londra e altrove nel Regno Unito utilizzano da tempo una tecnologia simile.

Potrebbe già accadere nella città in cui vivi.

Pervasivo, la sorveglianza in tempo reale come questa è possibile perché più potente, i computer che macinano numeri possono elaborare i torrenti di dati di riconoscimento facciale e analisi dell'andatura provenienti da migliaia di videocamere, il tutto coordinato da un'IA avanzata che può dare un senso a tutto.

Non troppo tempo fa, ci siamo affidati a pattuglie di polizia attente per garantire la sicurezza pubblica. Era quando vivevamo in comunità abbastanza piccole dove le persone si conoscevano di vista.

Ma mentre le città continuavano a crescere, diventando troppo grande per l'ufficiale di polizia da solo, televisione a circuito chiuso (CCTV), sono entrati in uso i sistemi di riconoscimento facciale e predittivi di prima generazione.

La moralità dell'iper-sorveglianza

L'opinione è divisa sull'etica della polizia predittiva.

I sostenitori della privacy e i libertari civili hanno preoccupazioni, se non obiezioni, a questo livello di sorveglianza – temendo che potesse diventare uno strumento di discriminazione.

Nel frattempo, I sostenitori della sicurezza pubblica e dell'antiterrorismo sostengono che la tecnologia predittiva ha un grande potenziale per contrastare gli attacchi terroristici e altre minacce alla sicurezza pubblica.

Entrambi gli argomenti hanno forza e validità, quindi la domanda è:dove tracciamo esattamente il confine tra l'interesse pubblico e la libertà individuale?

La risposta sarà diversa caso per caso. Ogni giurisdizione deve negoziare la risposta tenendo conto di tutte le preoccupazioni delle parti interessate.

Da quando i terroristi hanno attaccato negli Stati Uniti l'11 settembre Nel 2001 il grado di sorveglianza e perquisizione negli aeroporti è aumentato notevolmente.

In tempo, il pubblico dei viaggiatori arrivò ad accettare la situazione come nel proprio interesse e in quello dei propri compagni di viaggio.

La privacy inizia e finisce alla porta d'ingresso

È generalmente accettato il diritto alla privacy nella propria casa. Quando chiudi la porta d'ingresso, puoi ragionevolmente aspettarti che nessuno guardi e ascolti.

L'eccezione è quando sei a casa ma sei impegnato in attività criminali che minacciano la comunità. È qui che in questo caso tracciamo il confine tra i diritti individuali e il bene superiore.

Ma quando esci, chiunque può guardarti se lo desidera. Potrebbero anche sentire la conversazione che stai avendo. Non c'è diritto alla privacy dallo sguardo del pubblico, e non lo è mai stato.

Ma guardare è diverso dal fare previsioni e la scomoda verità è che la tecnologia di polizia predittiva ha il potenziale per essere utilizzata come strumento di oppressione. Gestire questo rischio in modo aperto, la società democratica è certamente una sfida, ma non insormontabile con controlli e contrappesi.

Soppesare rischi e benefici

Data l'esperienza complessiva della polizia predittiva, sembra che ci sia un forte motivo per il suo uso continuato.

In Australia, Per esempio, Secondo quanto riferito, 15 attacchi terroristici sono stati sventati negli ultimi tre anni grazie al lavoro della polizia supportato da algoritmi informatici.

La domanda è, come riduciamo i rischi a un livello accettabile?

La risposta breve è stabilire un quadro giuridico che garantisca la trasparenza etica in qualsiasi metodo di polizia predittiva dell'IA, compreso il modo in cui gli algoritmi sono messi insieme.

Garantirebbe inoltre rigorosamente che i dati inseriti nei sistemi predittivi siano accurati e imparziali. Come con qualsiasi sistema informatico, l'output è buono solo quanto l'input:spazzatura in, spazzatura fuori, come dice il proverbio.

Ciò è necessario per affrontare le preoccupazioni in corso sui pregiudizi intrinseci nei sistemi predittivi.

È stato osservato che non tutte le forze di polizia sono uguali. Negli Stati Uniti ci sono non meno di 12, 000 forze di polizia locali. Ci sono sicuramente delle differenze, riflesso nella qualità della leadership e nella disponibilità di risorse.

Partnership uomo/IA

La polizia non è perfetta e gli ufficiali umani non lo fanno sempre bene.

Ma quando si tratta di intelligenza artificiale nella polizia, Credo che nelle forze dell'ordine dovrebbe sempre esserci un posto per gli istinti finemente affinati di un ufficiale umano esperto temperato da un sistema di controlli e contrappesi.

La tecnologia dovrebbe sempre essere subordinata all'essere umano, assumendo il ruolo di aiutante di supporto decisionale.

Quel modo, quando l'era dell'ipersorveglianza arriva nella tua città natale, sarà un essere umano responsabile, non una macchina – per quanto intelligente possa essere – che decide se una persona rappresenta un grave rischio per la sicurezza pubblica.

Questo articolo è stato originariamente pubblicato su The Conversation. Leggi l'articolo originale.