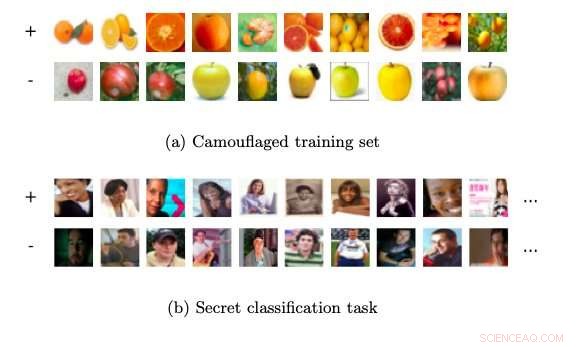

Esempio di mimetizzazione del training set. Credito:Sen et al.

I ricercatori dell'Università del Wisconsin-Madison e dell'Amherst College hanno recentemente introdotto una nuova forma di steganografia nel dominio dell'apprendimento automatico chiamata "camuffamento del set di addestramento". Il loro quadro, delineato in un documento pre-pubblicato su arXiv, consente a un agente di apprendimento automatico di nascondere l'intenzione e l'obiettivo di un'attività a un osservatore di terze parti.

La steganografia è una tecnica di crittografia che protegge o nasconde i dati incorporando messaggi all'interno di altri messaggi. Nel loro recente studio, i ricercatori di UW-Madison hanno specificamente considerato uno scenario in cui un agente di apprendimento automatico (Alice), cerca di addestrare un secondo agente (Bob) su un compito di classificazione segreta, senza che un terzo agente (Eve) che intercetta ne venga a conoscenza.

"Immagina che Alice abbia un set di formazione su un'attività di classificazione illecita di machine learning, " scrivono i ricercatori nel loro articolo. "Alice vuole che Bob (un sistema di apprendimento automatico) impari il compito. Però, inviare il set di addestramento o il modello addestrato a Bob può sollevare sospetti se la comunicazione viene monitorata."

Nello scenario immaginato dai ricercatori, un terzo agente di nome Eve assume il ruolo di verificatore di dati che monitora le comunicazioni tra Alice e Bob. Quando Eve diventa sospettosa di ciò che Alice sta inviando a Bob, può interrompere la comunicazione tra di loro, rifiutandosi di fornire i dati che stanno scambiando. Eve agisce come un auditor che sta cercando di capire se un set di dati di addestramento è legittimo, prima di trasmetterlo allo studente.

"L'invio del set di addestramento privato rivelerebbe l'intenzione di Alice; anche l'invio della direzione dei parametri del modello solleverà sospetti, " spiegano i ricercatori nel loro articolo. "Alice deve camuffare la comunicazione affinché sembri banale a Eva, evitando in anticipo trucchi di programmazione eccessivi con Bob."

L'approccio steganografia ideato dai ricercatori consente ad Alice di calcolare un secondo set di addestramento su un compito di classificazione completamente diverso e apparentemente benigno, senza destare il sospetto di Eva. Lo fa trovando un set di dati che sembra possa essere applicato a un'attività particolare, mentre può infatti insegnare a un agente a svolgere bene un compito diverso. Applicando il suo algoritmo di apprendimento standard a questo secondo set di addestramento, Bob può recuperare approssimativamente il classificatore sull'attività originale.

L'approccio alla stenografia ideato dai ricercatori è stato un po' un caso, come è emerso da un progetto non correlato nell'area dell'apprendimento automatico. Un sistema che hanno sviluppato aveva creato una serie di set didattici, uno dei quali includeva un punto erroneamente etichettato. Ciò li ha incoraggiati a indagare se un agente potesse insegnare a un altro agente come completare un'attività, mentre lo mimetizza con un altro compito.

I ricercatori hanno effettuato una serie di esperimenti utilizzando compiti di classificazione reali e hanno dimostrato la fattibilità del loro approccio. Il loro studio suggerisce che molte informazioni possono essere nascoste semplicemente sfruttando il fatto che per ogni dato compito, ci sono diversi modelli che possono funzionare bene su di esso.

Alcuni dei ricercatori coinvolti nello studio stanno ora effettuando ulteriori studi nel campo della steganografia. Altri, come Scott Alfeld, stanno indagando su scenari contraddittori in cui un utente malintenzionato perturba le istanze di addestramento in uno spazio continuo, piuttosto che selezionare un sottoinsieme di esempi, come nel caso del training set camouflage.

© 2019 Science X Network