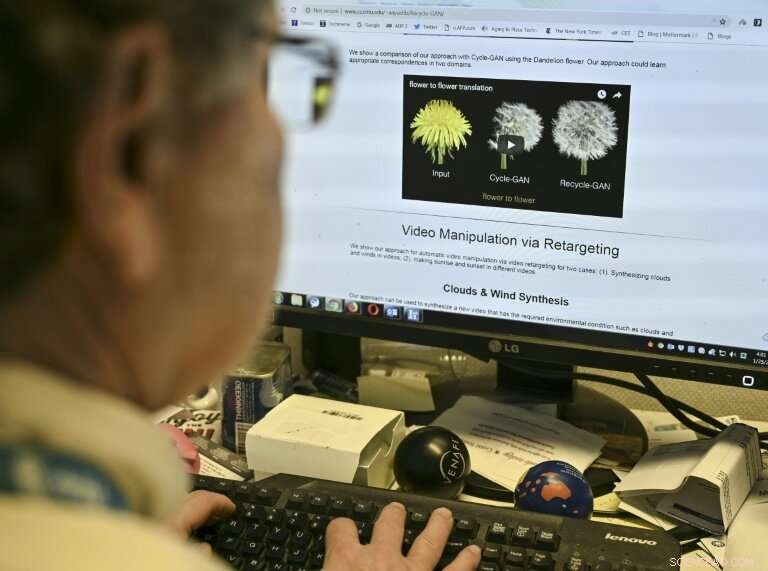

Paul Scharre del Center for a New American Security guarda un video "deepfake" dell'ex presidente degli Stati Uniti Barack Obama manipolato per mostrargli le parole pronunciate dall'attore Jordan Peele il 24 gennaio, 2019, a Washington

Se vedi un video di un politico che pronuncia parole che non pronuncerebbe mai, o una star di Hollywood che appare improbabile in un film per adulti da quattro soldi, non aggiustare il televisore:potresti semplicemente assistere al futuro delle "notizie false".

I video "deepfake" che manipolano la realtà stanno diventando più sofisticati grazie ai progressi dell'intelligenza artificiale, creando il potenziale per nuovi tipi di disinformazione con conseguenze devastanti.

Con l'avanzare della tecnologia, crescono le preoccupazioni su come i deepfake possano essere utilizzati per scopi nefasti da hacker o attori statali.

"Non siamo ancora al punto di vedere i deepfake armati, ma quel momento sta arrivando, "Robert Chesney, un professore di legge dell'Università del Texas che ha studiato l'argomento, ha detto all'Afp.

Chesney sostiene che i deepfake potrebbero aumentare l'attuale tumulto sulla disinformazione e influenzare le operazioni.

"Un deepfake o una serie di deepfake ben pianificati e ben pianificati potrebbero dare la mancia a un'elezione, scatenare la violenza in una città innescata da disordini civili, sostenere le narrazioni degli insorti sulle presunte atrocità di un nemico, o esacerbare le divisioni politiche in una società, Danielle Citron, professoressa di Chesney e dell'Università del Maryland, ha dichiarato in un post sul blog per il Council on Foreign Relations.

Paul Scharre, un membro anziano del Center for a New American Security, un think tank specializzato in intelligenza artificiale e problemi di sicurezza, ha affermato che è quasi inevitabile che i deepfake vengano utilizzati nelle prossime elezioni.

La manipolazione digitale può essere buona per Hollywood, ma le nuove tecniche "deepfake" potrebbero creare un nuovo tipo di disinformazione, secondo i ricercatori

Un video falso potrebbe essere distribuito per diffamare un candidato, Scharre ha detto, o per consentire alle persone di negare eventi reali catturati su video autentico.

Con credibili video falsi in circolazione, Ha aggiunto, "le persone possono scegliere di credere a qualsiasi versione o narrativa che vogliono, e questa è una vera preoccupazione".

Il ritorno di Chaplin?

La manipolazione dei video esiste da decenni e può essere innocua o persino divertente, come nell'apparizione digitale di Peter Cushing in "Rogue One:A Star Wars Story" del 2016 "22 anni dopo la sua morte.

I ricercatori della Carnegie Mellon University lo scorso anno hanno rivelato tecniche che semplificano la produzione di deepfake tramite l'apprendimento automatico per dedurre i dati mancanti.

Nell'industria cinematografica, "la speranza è che possiamo riavere vecchie star del cinema come Charlie Chaplin, ", ha detto Aayush Bansal.

Gli esperti dicono che un modo importante per affrontare i deepfake è aumentare la consapevolezza del pubblico, rendendo le persone più scettiche su quella che era considerata una prova inconvertibile

La divulgazione di app che realizzano video falsi realistici minaccia di minare la nozione di verità nei media, processi penali e molti altri settori, sottolineano i ricercatori.

"Se possiamo mettere delle parole nella bocca di qualcuno, è abbastanza spaventoso, "dice Siwei Lyu, professore di informatica alla State University di New York ad Albany, chi sta ricercando il rilevamento dei deepfake.

"Sfuma il confine tra ciò che è vero e ciò che è falso. Se non possiamo davvero fidarci che le informazioni siano autentiche, non è meglio che non avere alcuna informazione".

Il rappresentante Adam Schiff e altri due legislatori hanno recentemente inviato una lettera al direttore dell'intelligence nazionale Dan Coats chiedendo informazioni su cosa sta facendo il governo per combattere i deepfake.

"Video falsi, immagini o audio potrebbero essere utilizzati per prendere di mira individui per ricatti o per altri scopi nefasti, " hanno scritto i legislatori.

"Di maggiore preoccupazione per la sicurezza nazionale, potrebbero anche essere utilizzati da attori stranieri o nazionali per diffondere disinformazione".

I produttori di "Rogue One:A Star Wars Story, "Gli attori Peter Cushing e Carrie Fisher ricreati digitalmente dopo la loro morte usando tecniche simili a quelle impiegate per i video "deepfake"

Separare il falso dal reale

I ricercatori stanno lavorando da tempo a metodi di rilevamento migliori, con il supporto di aziende private come Google ed enti governativi come la Defense Advanced Research Projects Agency (DARPA) del Pentagono, che ha avviato un'iniziativa forense dei media nel 2015.

La ricerca di Lyu si è concentrata sul rilevamento di falsi, in parte analizzando il tasso di ammiccamento degli occhi di un individuo.

Ma riconosce che anche rilevare i falsi potrebbe non essere sufficiente, se un video diventa virale e porta al caos.

"È più importante interrompere il processo che analizzare i video, " ha detto Lyu.

Mentre i deepfake si sono evoluti per diversi anni, l'argomento è stato messo a fuoco con la creazione lo scorso aprile di un video che mostra l'ex presidente Barack Obama che usa una parolaccia per descrivere il suo successore Donald Trump, una trovata coordinata dal regista Jordan Peele e BuzzFeed.

Un giornalista dell'AFP vede un esempio di video "deepfake" manipolato usando l'intelligenza artificiale, dai ricercatori della Carnegie Mellon University

Anche nel 2018 una proliferazione di video porno "face swap" che utilizzavano immagini di Emma Watson, Scarlett Johansson e altre celebrità hanno chiesto di vietare i deepfake da Reddit, Twitter e Pornhub, sebbene non fosse chiaro se potessero far rispettare le politiche.

Scharre said there is "an arms race between those who are creating these videos and security researchers who are trying to build effective tools of detection."

But he said an important way to deal with deepfakes is to increase public awareness, making people more skeptical of what used to be considered incontrovertible proof.

"After a video has gone viral it may be too late for the social harm it has caused, " Egli ha detto.

© 2019 AFP