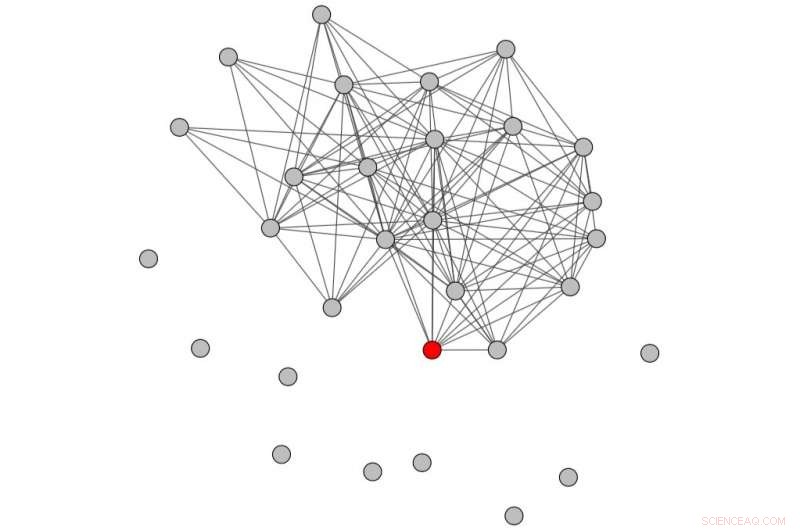

Grafico conversazionale ottenuto considerando un periodo di tempo precedente l'abuso. Credito:Papegnie et al.

Un team di ricercatori dell'Università di Avignone ha recentemente sviluppato un sistema per rilevare automaticamente gli abusi nelle comunità online. Questo sistema, presentato in un articolo pre-pubblicato su arXiv, è risultato superare gli approcci esistenti per rilevare gli abusi e moderare i contenuti generati dagli utenti.

"Le comunità online in continua crescita offrono l'opportunità di diffondere idee attraverso Internet, garantire un certo anonimato agli utenti, " hanno detto i ricercatori a TechXplore, Via Posta Elettronica. "Però, questi spazi hanno spesso utenti che mostrano comportamenti abusivi. Per i leader della comunità, è importante moderare questi atti dolosi, poiché non farlo potrebbe avvelenare la comunità, innescare l'esodo degli utenti ed esporre gli amministratori a problemi legali."

La moderazione dei contenuti generati dagli utenti online viene generalmente eseguita manualmente da persone; quindi, può essere sia costoso che dispendioso in termini di tempo. Per ridurre i costi, i ricercatori hanno cercato di sviluppare strumenti di moderazione dei contenuti completamente automatizzati che potrebbero sostituire o aiutare i moderatori umani.

"In questo lavoro, formuliamo il compito della moderazione dei contenuti come un problema di classificazione, e applicare il nostro metodo a un corpus di messaggi scambiati dai giocatori di un MMORPG, un gioco di ruolo online multigiocatore di massa, " hanno detto i ricercatori.

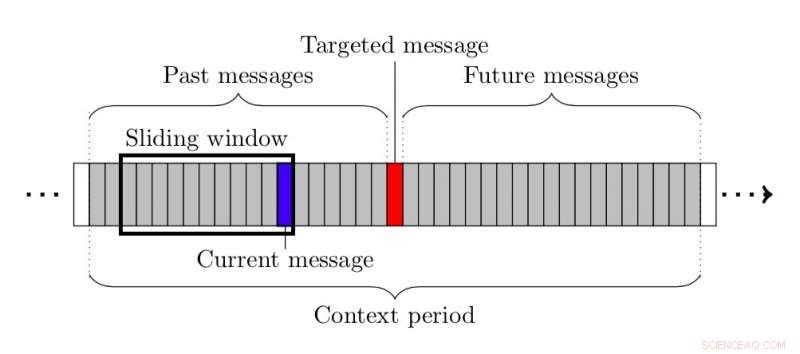

Come primo passo, i ricercatori hanno estratto le reti di conversazione dai registri di chat grezzi che rappresentano le conversazioni in cui è stato inviato ogni messaggio offensivo, e li caratterizzano utilizzando misure topologiche. Hanno usato i loro risultati come caratteristiche, formazione di un classificatore per rilevare gli abusi sulle piattaforme online.

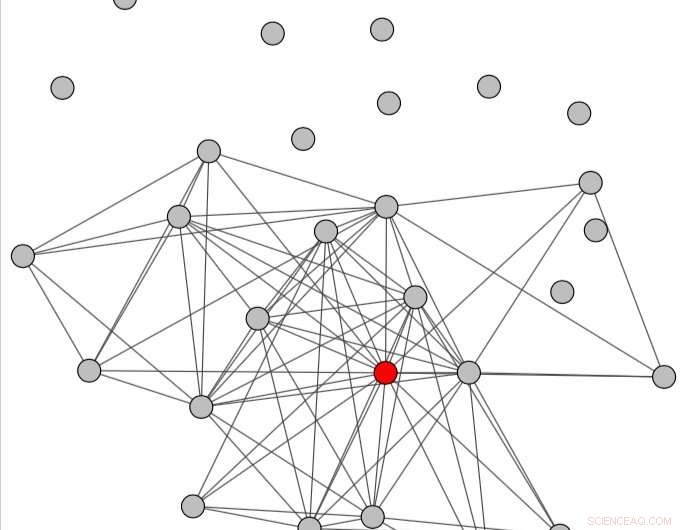

Il grafico conversazionale ottenuto considerando un periodo di tempo successivo all'abuso. Credito:Papegnie et al.

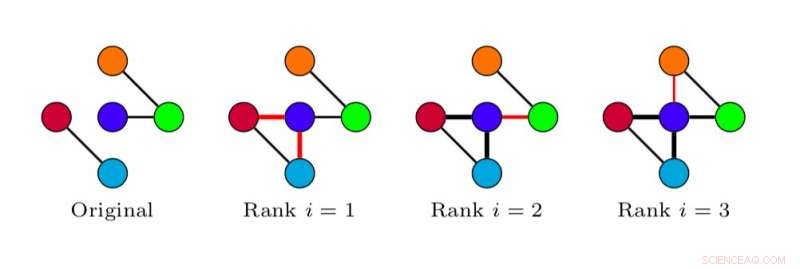

Durante l'estrazione delle reti di conversazione, i ricercatori hanno seguito un metodo in tre fasi. Primo, hanno identificato il sottoinsieme di messaggi che avrebbero usato per estrarre la rete. Quindi, hanno selezionato un sottoinsieme di utenti che erano i probabili destinatari di ciascun messaggio. Finalmente, hanno aggiunto bordi e rivisto i loro pesi in base a questi potenziali destinatari di messaggi.

"I metodi esistenti per il rilevamento automatico dei messaggi abusivi si concentrano sul contenuto testuale dei messaggi scambiati, che solleva molte questioni:problemi specifici della lingua, errori di sintassi, errori di ortografia, offuscazione, e altri, " hanno spiegato i ricercatori. "Al contrario, utilizziamo solo la presenza/assenza di interazioni tra utenti, cioè il fatto che si scambiano dei messaggi (o no), in opposizione alla natura dei messaggi scambiati. Ignorare il contenuto ci ha permesso di risolvere questi problemi".

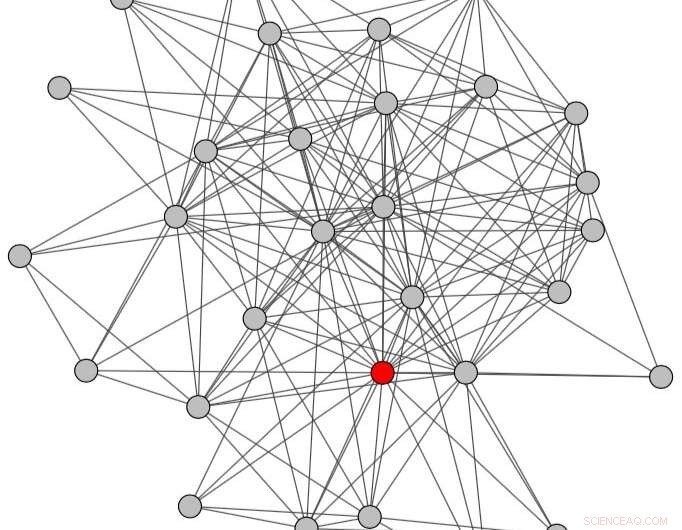

Essenzialmente, i ricercatori hanno modellato le conversazioni online utilizzando un grafico in cui i nodi rappresentano gli utenti ei collegamenti rappresentano gli scambi di messaggi. Utilizzando misure specifiche del grafico, sono stati in grado di osservare differenze nel modo in cui le conversazioni sono strutturate a seconda che contengano o meno messaggi offensivi. Queste differenze sono state poi utilizzate per addestrare un classificatore a rilevare gli abusi nelle conversazioni tra utenti.

Grafico conversazionale ottenuto considerando l'intero periodo di tempo (cioè sia prima che dopo l'abuso). Credito:Papegnie et al.

"Il nostro primo sforzo, presentato in un precedente articolo, si basava sull'approccio tradizionale, cioè., utilizzava il contenuto testuale dei messaggi, " hanno spiegato i ricercatori. "Quando abbiamo proposto questo metodo basato su grafici, non ci aspettavamo che funzionasse così bene; abbiamo anche pensato che avrebbe comportato prestazioni inferiori rispetto al metodo basato sui contenuti. Siamo rimasti molto sorpresi di ottenere risultati significativamente migliori. Questa è la scoperta più significativa del nostro studio:che, almeno per questo compito specifico, la struttura della conversazione è più discriminante della natura del contenuto scambiato."

Credito:Papegnie et al.

Credito:Papegnie et al.

I ricercatori hanno testato il loro sistema su un set di dati di commenti degli utenti di un gioco MMORPG francese e hanno scoperto che ha superato gli approcci esistenti, con una misura F di 83,89 quando si utilizza l'intero set di funzionalità. Riducendo il set di funzionalità e mantenendo solo le caratteristiche più discriminanti, sono stati in grado di ridurre drasticamente i tempi di elaborazione, pur mantenendo ottime prestazioni. Nel futuro, il loro approccio basato su grafici potrebbe essere applicato anche ad altre attività di classificazione dei messaggi, come il rilevamento di troll online.

"Cercheremo ora di unire entrambi gli approcci (basato sul contenuto e sul grafico), al fine di verificare se usufruiscono di informazioni simili, nel qual caso i risultati sarebbero simili, o se si basano su informazioni complementari, in quale caso, la loro combinazione dovrebbe portare a miglioramenti nelle prestazioni, " hanno aggiunto i ricercatori. "Allora, vogliamo passare a un metodo più automatizzato per caratterizzare i nostri grafici conversazionali, chiamati incorporamenti di grafi. È un metodo basato sul deep learning che consiste nell'addestrare una rete neurale per ottenere una rappresentazione efficiente dei grafici. A confronto, attualmente facciamo questa parte del lavoro manualmente, tramite un'attività chiamata selezione delle funzioni."

© 2019 Scienza X Rete