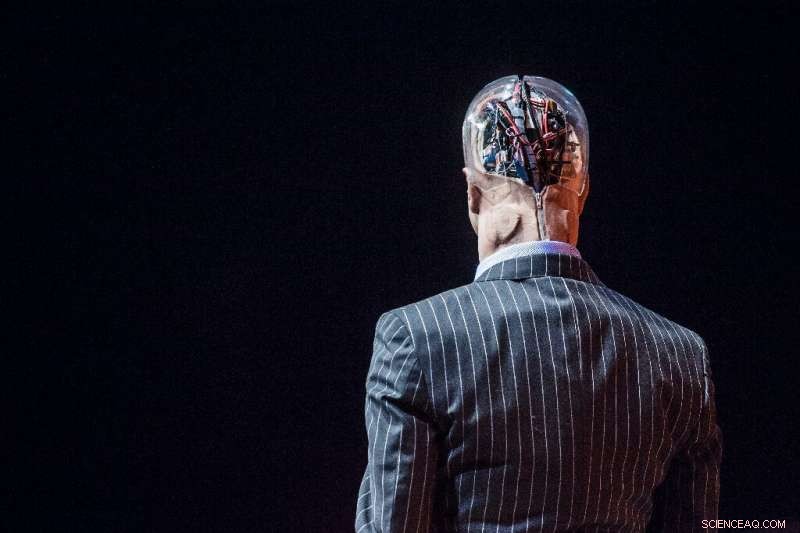

L'UE riconosce di aver mancato la rivoluzione di Internet, e vuole assicurarsi che non si ripeta quell'errore con il fiorente campo dell'intelligenza artificiale

L'UE ha presentato mercoledì la sua strategia per l'intelligenza artificiale mentre cerca di raggiungere la Cina e gli Stati Uniti e dissipare i timori di un controllo simile al Grande Fratello.

L'UE ha affermato che costruire la fiducia sarebbe un principio guida, con usi ad alto rischio dell'IA nella salute, sicurezza o dei trasporti che devono far fronte a requisiti più severi in materia di trasparenza e controllo umano. Le applicazioni a basso rischio verrebbero in gran parte lasciate in pace.

L'altra ambizione sarà quella di offrire alle aziende e alle università l'accesso alla montagna di dati che guida l'AI, con il blocco che sta valutando di costringere i giganti della tecnologia a condividere i dati o ad affrontare sanzioni.

"Vogliamo che l'applicazione di queste nuove tecnologie meriti la fiducia dei nostri cittadini, Lo ha detto ai giornalisti la presidente della Commissione europea Ursula von der Leyen.

"Ecco perché stiamo promuovendo un responsabile, approccio umano-centrico all'intelligenza artificiale."

I funzionari dell'UE sono desiderosi di definire le regole dell'IA e spingere i loro campioni, riconoscendo che l'Europa e le sue aziende sono state aggirate da Google della Silicon Valley, Facebook e Apple, così come giocatori cinesi come Tencent.

"Non siamo noi che dobbiamo adattarci alle piattaforme di oggi. Sono le piattaforme che devono adattarsi all'Europa, Lo ha detto in conferenza stampa il commissario Ue all'Industria Thierry Breton.

"La battaglia per i dati industriali inizia ora e l'Europa sarà il principale campo di battaglia. L'Europa ha tutto ciò di cui ha bisogno per essere un leader".

Le proposte sono il primo passo di un lungo cammino legislativo, con Bruxelles che spera in progetti di legge entro la fine dell'anno.

Ma i piani di vasta portata dovranno affrontare pressioni furiose da parte di colossi e governi e richiederanno la ratifica da parte del Parlamento europeo.

"L'intelligenza artificiale non è buona o cattiva in sé. Tutto dipende da perché e come viene usata, " ha affermato il vicepresidente esecutivo della Commissione europea sulla politica digitale, Margrethe Vestager.

"Precisione" richiesta

La Commissione, il braccio esecutivo dell'UE, cercherà di ripetere l'impatto del GDPR, il suo regolamento sulla protezione dei dati che è diventato uno standard globale.

Le lobby aziendali hanno accolto con favore l'approccio pratico alle applicazioni a basso rischio dell'IA, sollevata dal fatto che Bruxelles si stia ritirando dalla regolamentazione generale.

"Sosteniamo l'approccio mirato e basato sul rischio, " disse Cecilia Bonefeld-Dahl, il capo di DigitalEurope, una lobby tecnologica.

"Sarà importante mantenere la nuova regolamentazione focalizzata e limitata ai casi veramente ad alto rischio".

Cristoforo Padilla, un vicepresidente IBM, ha sollecitato una "regolamentazione di precisione" che applicasse "regole diverse per diversi livelli di rischio".

Ciò garantirebbe che "imprese e consumatori abbiano fiducia nella tecnologia", Egli ha detto.

I funzionari dell'UE si sono astenuti dal chiedere limiti al riconoscimento facciale, uno degli esempi più controversi di intelligenza artificiale.

Per adesso, hanno affermato che la legislazione esistente ne limita già gli usi, ma il blocco avvierà un dibattito sul tema per determinare dove i cittadini europei lo accetterebbero.

© 2020 AFP