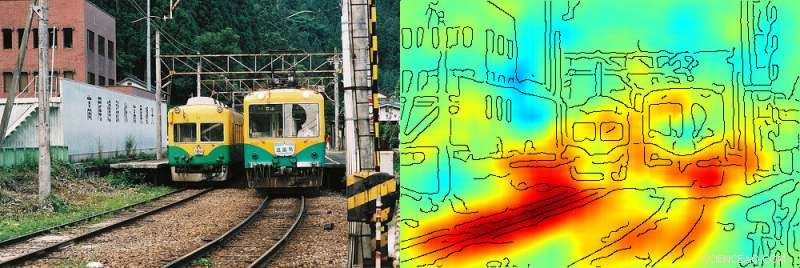

Qui il sistema AI classifica un'immagine come un treno perché sono presenti binari. Attestazione:Fraunhofer HHI

L'intelligenza artificiale (AI) è già saldamente radicata nella nostra vita quotidiana e sta conquistando sempre più territorio. Per esempio, gli assistenti vocali sono già un elemento quotidiano negli smartphone di molte persone, auto e case. I progressi nel campo dell'IA si basano principalmente sull'uso delle reti neurali. Imitando la funzionalità del cervello umano, le reti neurali collegano tra loro unità definite matematicamente. Ma in passato non si sapeva solo come una rete neurale prendesse le decisioni. Ricercatori dell'Istituto Fraunhofer per le telecomunicazioni, Istituto Heinrich Hertz, HHI e Technische Universität Berlin hanno sviluppato una tecnologia che rivela i criteri utilizzati dai sistemi di intelligenza artificiale quando prendono decisioni. L'innovativo metodo Spectral Relevance Analysis (SpRAy) basato sulla tecnologia Layer-wise Relevance Propagation fornisce una prima occhiata all'interno della "scatola nera".

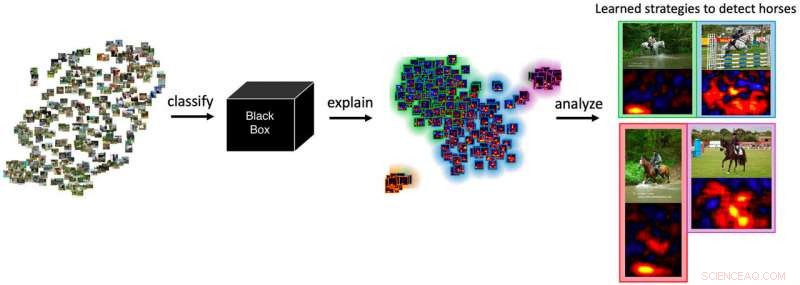

Oggi è quasi impossibile trovare un'area in cui l'intelligenza artificiale sia irrilevante, sia nella produzione, pubblicità o comunicazioni. Molte aziende utilizzano sistemi di apprendimento e intelligenza artificiale in rete, ad esempio per generare previsioni precise della domanda e prevedere esattamente il comportamento dei clienti. Questo approccio può essere utilizzato anche per adeguare i processi logistici regionali. La sanità si avvale anche di specifiche attività di IA, come la generazione di prognosi sulla base di dati strutturati. Ciò svolge un ruolo, ad esempio, nel riconoscimento delle immagini:le immagini radiografiche vengono immesse in un sistema di intelligenza artificiale che quindi emette una diagnosi. Il corretto rilevamento del contenuto dell'immagine è fondamentale anche per la guida autonoma, dove i segnali stradali, alberi, pedoni e ciclisti devono essere identificati con assoluta precisione. E questo è il nocciolo della questione:i sistemi di intelligenza artificiale devono fornire strategie di risoluzione dei problemi assolutamente affidabili in aree di applicazione sensibili come la diagnostica medica e in aree critiche per la sicurezza. Però, in passato non era del tutto chiaro come i sistemi di intelligenza artificiale prendessero le decisioni. Per di più, le previsioni dipendono dalla qualità dei dati di input. Ricercatori dell'Istituto Fraunhofer per le telecomunicazioni, Istituto Heinrich Hertz, HHI e Technische Universität Berlin hanno ora sviluppato una tecnologia, Propagazione della pertinenza a livello di livelli (LRP), il che rende spiegabili le previsioni dell'IA e così facendo rivela strategie di soluzione dei problemi inaffidabili. Un ulteriore sviluppo della tecnologia LRP, denominata Analisi di rilevanza spettrale (SpRAy), identifica e quantifica un ampio spettro di comportamenti decisionali appresi e quindi identifica decisioni indesiderabili anche in enormi set di dati.

AI trasparente

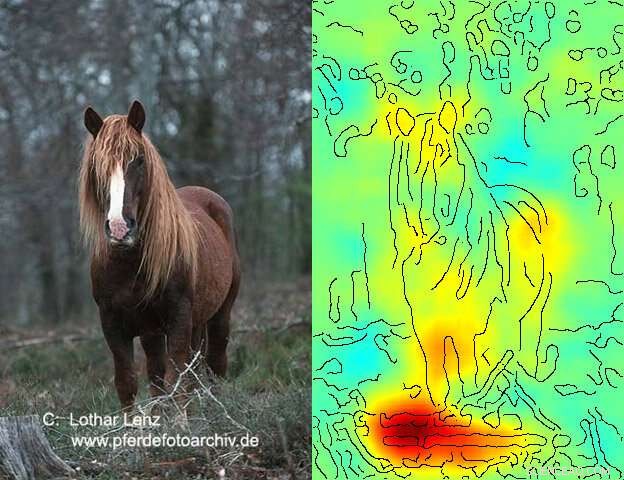

Qui il sistema AI assegna l'immagine alla categoria corretta in base al banner del copyright. Tuttavia, la strategia di soluzione è difettosa. Attestazione:Fraunhofer HHI

In pratica la tecnologia identifica i singoli elementi di input che sono stati utilizzati per fare una previsione. Così, ad esempio, quando un'immagine di un campione di tessuto viene immessa in un sistema di intelligenza artificiale, l'influenza di ogni singolo pixel è quantificata nei risultati della classificazione. In altre parole, oltre a prevedere quanto sia "maligno" o "benigno" il tessuto ripreso, il sistema fornisce anche informazioni sulla base di questa classificazione. "Non solo il risultato dovrebbe essere corretto, anche la strategia della soluzione. Nel passato, I sistemi di intelligenza artificiale sono stati trattati come scatole nere. I sistemi erano affidabili per fare le cose giuste. Con il nostro software open source, che utilizza la propagazione della pertinenza per livello, siamo riusciti a rendere trasparente il processo di ricerca delle soluzioni dei sistemi di intelligenza artificiale, "dice il dottor Wojciech Samek, capo del gruppo di ricerca "Machine Learning" presso Fraunhofer HHI. "Stiamo utilizzando LRP per visualizzare e interpretare le reti neurali e altri modelli di apprendimento automatico. Usiamo LRP per misurare l'influenza di ogni variabile di input nella previsione complessiva e analizzare le decisioni prese dai classificatori, " aggiunge il dottor Klaus-Rob-ert Müller, Professore di Machine Learning alla TU Berlin.

Strategie di soluzione inaffidabili

Fidarsi dei risultati delle reti neurali significa necessariamente capire come funzionano. Secondo i test del gruppo di ricerca, I sistemi di intelligenza artificiale non sempre applicano le migliori strategie per raggiungere una soluzione. Per esempio, un noto sistema di intelligenza artificiale classifica le immagini in base al contesto. Assegnava le fotografie alla categoria "Nave" quando nell'immagine era visibile una grande quantità di acqua. Non risolveva il compito effettivo di riconoscere le immagini delle navi, anche se nella maggior parte dei casi ha individuato le foto giuste. "Molti algoritmi di intelligenza artificiale utilizzano strategie inaffidabili e arrivano a soluzioni altamente poco pratiche, "dice Samek, riassumendo i risultati delle indagini.

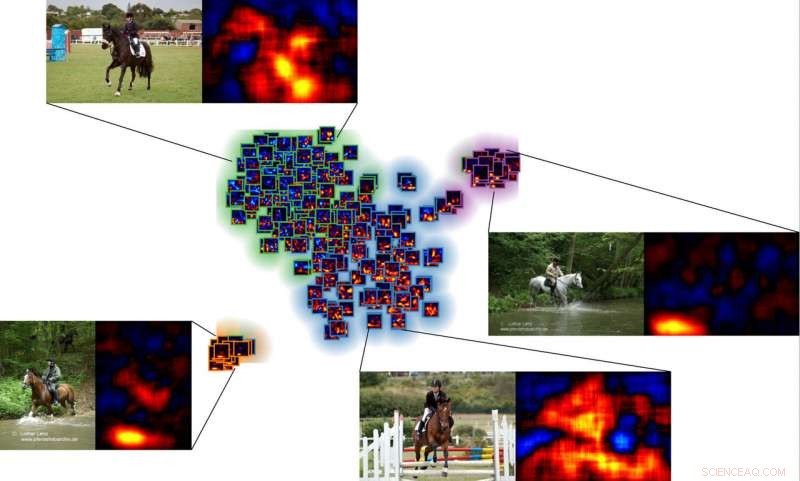

La nuova tecnologia Spectral-wise Relevance Analysis rende visibili i criteri utilizzati dai sistemi di intelligenza artificiale quando prendono decisioni. Attestazione:Fraunhofer HHI

Guardare le reti neurali pensare

La tecnologia LRP decodifica la funzionalità delle reti neurali e scopre quali caratteristiche vengono utilizzate, ad esempio per identificare un cavallo come cavallo e non come asino o mucca. Identifica le informazioni che fluiscono attraverso il sistema in ogni nodo della rete. Ciò rende possibile investigare reti neurali anche molto profonde.

I team di ricerca Fraunhofer HHI e TU Berlin stanno attualmente formulando nuovi algoritmi per l'indagine di ulteriori domande al fine di rendere i sistemi di intelligenza artificiale ancora più affidabili e robusti. I partner del progetto hanno pubblicato i risultati della loro ricerca sulla rivista Comunicazioni sulla natura .

La propagazione della pertinenza a livello di livelli fornisce uno sguardo all'interno della "scatola nera". Attestazione:Fraunhofer HHI

IA, apprendimento automatico e altro

L'intelligenza artificiale si occupa dello sviluppo di sistemi in grado di risolvere in modo indipendente i problemi e agire in modo analogo ai modelli di pensiero e comportamento umani. Attualmente i maggiori progressi sono stati compiuti nel campo dell'apprendimento automatico, un sottocampo dell'IA. Il machine learning si occupa di metodi di estrazione della conoscenza dai dati e dei contesti di apprendimento autonomo contenuti nei dati. Il progresso è il risultato dell'utilizzo di reti neurali artificiali basate su connessioni tra unità di calcolo matematiche che in linea di principio imitano la struttura neurale del cervello umano. Un sottocampo dell'apprendimento automatico, apprendimento profondo, copre una classe di nuove procedure che rendono possibile insegnare e addestrare complesse reti neurali artificiali. Queste reti sono costituite da un gran numero di livelli collegati tra loro in strutture a più livelli.