L’analisi del comportamento animale è uno strumento fondamentale in vari studi, che vanno dalla ricerca neuroscientifica di base alla comprensione delle cause e dei trattamenti delle malattie. È ampiamente applicato non solo nella ricerca biologica ma anche in vari campi industriali, inclusa la robotica.

Recentemente sono stati compiuti sforzi per analizzare accuratamente i comportamenti degli animali utilizzando la tecnologia dell’intelligenza artificiale. Tuttavia, esistono ancora limitazioni affinché l'intelligenza artificiale possa riconoscere in modo intuitivo diversi comportamenti come possono fare gli osservatori umani.

La ricerca tradizionale sul comportamento animale prevede principalmente la ripresa degli animali con una singola telecamera e l’analisi di dati a bassa dimensione come il tempo e la frequenza di movimenti specifici. Il metodo di analisi ha fornito all'IA i risultati corrispondenti per ogni dato di addestramento, in modo simile a fornire semplicemente all'IA domande insieme alla chiave di risposta.

Sebbene questo metodo sia semplice, richiede tempo e una supervisione umana ad alta intensità di lavoro per creare i dati. Anche il pregiudizio dell'osservatore è un fattore, poiché i risultati dell'analisi possono essere distorti dal giudizio soggettivo dello sperimentatore.

Per superare queste limitazioni, un gruppo di ricerca congiunto guidato dal direttore C. Justin Lee del Center for Cognition and Sociality presso l'Institute for Basic Science, e Cha Meeyoung, il capo investigatore (CI) del Data Science Group presso l'IBS Center for Scienze matematiche e computazionali (anche professore presso la Scuola di Informatica del KAIST), ha sviluppato un nuovo strumento analitico chiamato SUBTLE (Spectrogram-UMAP-Based Temporal-Link Embedding). SUBTLE classifica e analizza il comportamento degli animali attraverso l'apprendimento dell'intelligenza artificiale basato su informazioni di movimento 3D.

L'articolo è pubblicato sull'International Journal of Computer Vision .

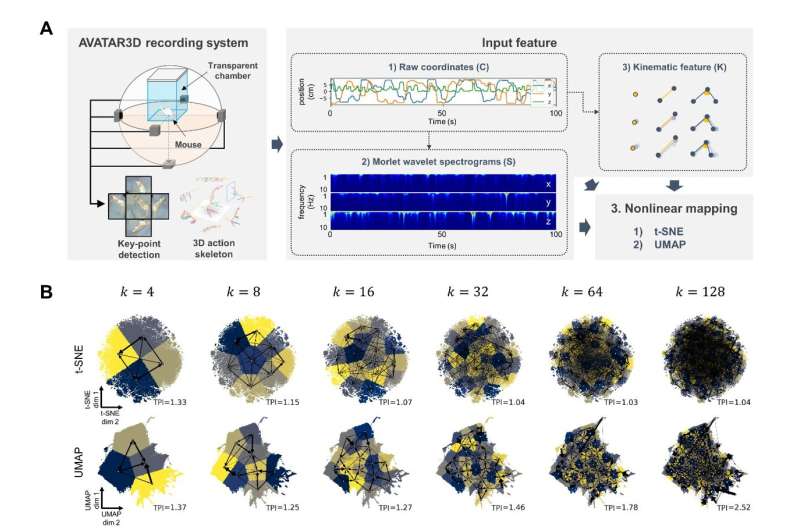

Innanzitutto, il team di ricerca ha registrato i movimenti dei topi utilizzando più telecamere, estraendo le coordinate di nove punti chiave come testa, gambe e fianchi per ottenere dati sul movimento dello scheletro in azione 3D nel tempo.

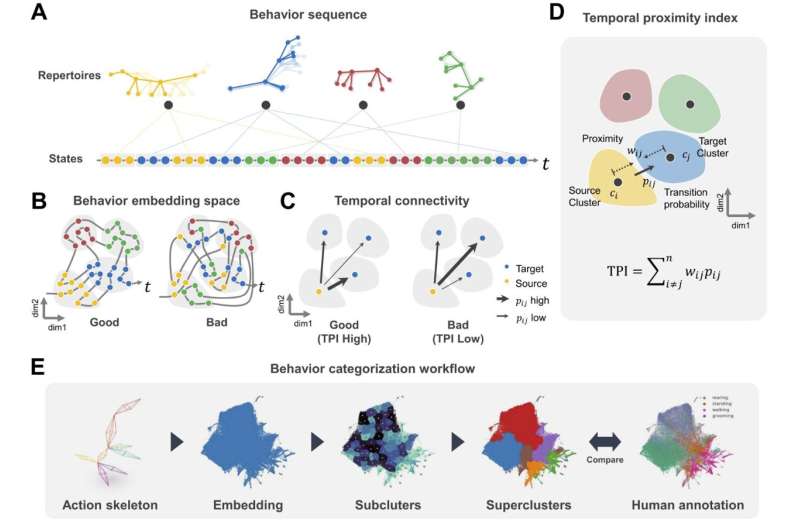

Hanno quindi ridotto i dati delle serie temporali in due dimensioni per l'incorporamento, un processo che crea una raccolta di vettori corrispondenti a ciascun dato, consentendo di rappresentare dati complessi in modo più conciso e significativo.

Successivamente, i ricercatori hanno raggruppato stati comportamentali simili in sottocluster e hanno raggruppato questi sottocluster in supercluster che rappresentano modelli di comportamento standardizzati (repertori), come camminare, stare in piedi, pulirsi, ecc.

Durante questo processo, hanno proposto una nuova metrica chiamata Temporal Proximity Index (TPI) per valutare i cluster di dati comportamentali. Questa metrica misura se ciascun cluster include lo stesso stato comportamentale e rappresenta effettivamente i movimenti temporali, in modo simile al modo in cui gli esseri umani considerano importanti le informazioni temporali quando classificano il comportamento.

CI Cha Meeyoung ha dichiarato:"L'introduzione di nuovi parametri di valutazione e dati di riferimento per facilitare l'automazione della classificazione del comportamento animale è il risultato della collaborazione tra neuroscienze e scienza dei dati. Ci aspettiamo che questo algoritmo sia utile in vari settori che richiedono il riconoscimento di modelli di comportamento , compresa l'industria della robotica, che mira a imitare i movimenti degli animali."

Il direttore C. Justin Lee, che ha guidato questa ricerca, ha dichiarato:"Abbiamo sviluppato un efficace quadro di analisi del comportamento che riduce al minimo l'intervento umano e allo stesso tempo comprende i comportamenti complessi degli animali applicando meccanismi di riconoscimento dei modelli di comportamento umano. Questo quadro ha significative applicazioni industriali e può anche essere utilizzato come strumento per acquisire conoscenze più approfondite sui principi del riconoscimento del comportamento nel cervello."

Inoltre, nell’aprile dello scorso anno il gruppo di ricerca ha trasferito la tecnologia SUBTLE ad Actnova, una società specializzata nell’analisi dei test comportamentali clinici e non clinici basati sull’intelligenza artificiale. Il team ha utilizzato il sistema di analisi del comportamento animale di Actnova, AVATAR3D, per ottenere dati di movimento 3D degli animali per questa ricerca.

Il team di ricerca ha inoltre reso open source il codice di SUBTLE e, attraverso il servizio web SUBTLE, è disponibile un'interfaccia grafica (GUI) intuitiva per facilitare l'analisi del comportamento degli animali per i ricercatori che non hanno familiarità con la programmazione.

Ulteriori informazioni: Jea Kwon et al, SUBTLE:An Unsupervised Platform with Temporal Link Embedding that Maps Animal Behavior, International Journal of Computer Vision (2024). DOI:10.1007/s11263-024-02072-0

Fornito da Institute for Basic Science