I ricercatori del Cluster of Excellence Collective Behavior hanno sviluppato un quadro di visione artificiale per la stima della postura e il tracciamento dell’identità che possono utilizzare sia in ambienti interni che in natura. Si tratta di un passo importante verso il tracciamento senza marcatori degli animali in natura utilizzando la visione artificiale e l'apprendimento automatico.

Due piccioni beccano i cereali in un parco a Costanza. Un terzo piccione vola dentro. Ci sono quattro telecamere nelle immediate vicinanze. I dottorandi Alex Chan e Urs Waldmann del Cluster of Excellence Collective Behavior dell'Università di Costanza stanno filmando la scena. Dopo un'ora, tornano con il filmato in ufficio per analizzarlo con un sistema di visione artificiale per la stima della postura e il monitoraggio dell'identità.

Il quadro rileva e disegna una scatola attorno a tutti i piccioni. Registra le parti centrali del corpo e determina la loro postura, la loro posizione e la loro interazione con gli altri piccioni che li circondano. Tutto ciò avviene senza che venga attaccato alcun contrassegno ai piccioni o che sia necessario l’intervento di un essere umano per aiutare. Questo non sarebbe stato possibile solo pochi anni fa.

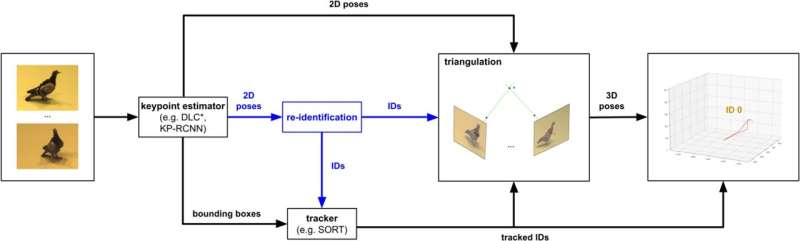

Recentemente si sono sviluppati rapidamente metodi senza marcatori per il monitoraggio della postura degli animali, ma mancano ancora strutture e parametri di riferimento per il monitoraggio di grandi gruppi di animali in 3D. Per superare questa lacuna, il ricercatore Urs Waldmann del Cluster of Excellence Collective Behavior dell’Università di Costanza e Alex Chan dell’Istituto Max Planck di comportamento animale e i loro colleghi presentano 3D-MuPPET, un quadro per stimare e monitorare pose 3D fino a 10 piccioni a velocità interattiva utilizzando più visualizzazioni di telecamere.

La ricerca è stata recentemente pubblicata sull'International Journal of Computer Vision .

3D-MuPPET, che sta per 3D Multi-Pigeon Pose Estimation and Tracking, è un framework di visione artificiale per la stima della postura e il tracciamento dell'identità per un massimo di 10 singoli piccioni da quattro visualizzazioni della telecamera, sulla base dei dati raccolti sia in ambienti in cattività che anche in selvaggio.

"Abbiamo addestrato un rilevatore di punti chiave 2D e punti triangolati in 3D, e abbiamo anche dimostrato che i modelli addestrati sui dati di un singolo piccione funzionano bene con i dati di più piccioni", spiega Waldmann. Questo è un primo esempio di monitoraggio della postura di animali in 3D per un intero gruppo fino a 10 individui.

Pertanto, il nuovo quadro fornisce ai biologi un metodo concreto per creare esperimenti e misurare la postura degli animali per l’analisi comportamentale automatica. "Questo quadro rappresenta una pietra miliare importante nel monitoraggio della postura degli animali e nell'analisi comportamentale automatica", afferma Chan.

Oltre al monitoraggio dei piccioni in casa, il quadro è esteso anche ai piccioni in natura. "Utilizzando un modello in grado di identificare il contorno di qualsiasi oggetto in un'immagine chiamato Segment Anything Model, abbiamo ulteriormente addestrato un rilevatore di punti chiave 2D con un piccione mascherato dai dati in cattività, quindi abbiamo applicato il modello ai video dei piccioni all'aperto senza alcuna messa a punto aggiuntiva del modello ," afferma Chan.

3D-MuPPET presenta uno dei primi casi di studio su come passare dal monitoraggio degli animali in cattività al monitoraggio degli animali in natura, consentendo di misurare i comportamenti su scala precisa degli animali nei loro habitat naturali. I metodi sviluppati possono potenzialmente essere applicati ad altre specie in lavori futuri, con potenziale applicazione per la ricerca sul comportamento collettivo su larga scala e il monitoraggio delle specie in modo non invasivo.

3D-MuPPET presenta una struttura potente e flessibile per i ricercatori che desiderano utilizzare la ricostruzione della postura 3D di più individui per studiare il comportamento collettivo in qualsiasi ambiente o specie. Finché sono disponibili una configurazione multi-camera e uno strumento per la stima della postura 2D, la struttura può essere applicata per monitorare le posture 3D di qualsiasi animale.

Ulteriori informazioni: Urs Waldmann et al, 3D-MuPPET:stima e monitoraggio della posa multi-piccione 3D, International Journal of Computer Vision (2024). DOI:10.1007/s11263-024-02074-y

Fornito dall'Università di Costanza