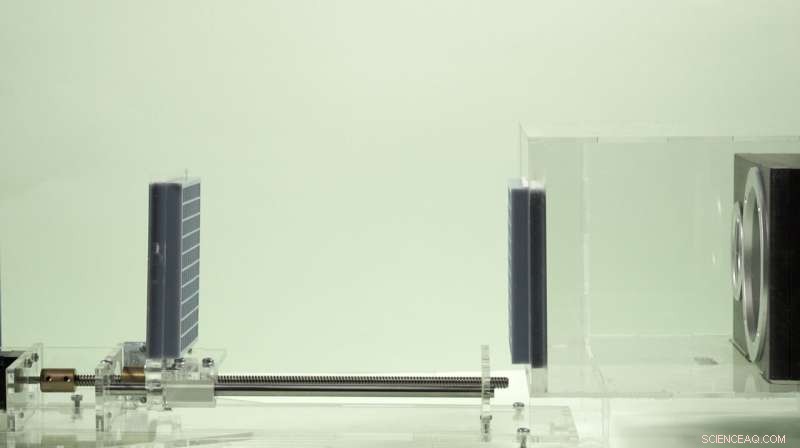

La versione attuale del proiettore acustico del Sussex. L'altoparlante è contenuto nella parte posteriore, insieme alla telecamera di localizzazione e una delle lenti acustiche. La parte in bianco è la seconda lente acustica nel telescopio. Credito:Università del Sussex

Un team di ricerca dell'Università del Sussex ha dimostrato il primo proiettore sonoro in grado di seguire un individuo in movimento e trasmettere un messaggio acustico mentre si muove, a una conferenza tecnologica e mediatica di alto profilo a Los Angeles.

Il dott. Gianluca Memoli e i suoi colleghi hanno dimostrato quello che ritengono essere il primo proiettore sonoro al mondo con obiettivo autozoom in una conferenza alla 46a Conferenza ed esposizione internazionale sulla computer grafica e le tecniche interattive (SIGGRAPH 2019) questa settimana.

Dott. Memoli, Docente in Novel Interfaces and Interactions presso la School of Engineering and Informatics dell'Università del Sussex che ha guidato la ricerca, ha dichiarato:"Progettando materiali acustici su una scala inferiore alla lunghezza d'onda del suono per creare lenti acustiche sottili, il cielo è il limite in nuove potenziali applicazioni acustiche.

"Secoli di design ottico possono ora essere applicati all'acustica. Riteniamo che questa tecnologia possa essere sfruttata per molte applicazioni positive tra cui messaggi di allarme personalizzati in mezzo alla folla, esperienze immersive senza cuffie, l'equivalente audio degli effetti speciali."

Il sistema funziona con un software di tracciamento facciale interno che viene utilizzato per pilotare un telescopio acustico controllato da Arduino per focalizzare il suono su un bersaglio in movimento.

La telecamera a basso costo è in grado di tracciare una persona e comandare la distanza tra due lenti acustiche, offrendo una sfera sonora di circa 6 cm di diametro davanti al bersaglio, che poi risponde al movimento dell'individuo.

Uno dei primi prototipi del telescopio, utilizzato per il test. Il principio di base è che la lunghezza focale combinata delle due lenti (in grigio) dipende dalla loro distanza reciproca. Anche nella foto c'è un altoparlante (a destra). Credito:Università del Sussex

Joshua Kybett, lo studente del secondo anno al Sussex che ha progettato il monitoraggio, aggiunge:"Dal momento che le lenti acustiche possono essere stampate in 3D per solo £ 100, volevamo una tecnica di tracciamento che funzionasse con un budget simile. Con una webcam da £ 10 ($ 12), questo è un decimo dei sistemi di tracciamento standard.

"Inoltre, il nostro metodo è stato progettato per richiedere il consenso dell'utente per funzionare. Questo requisito garantisce che la tecnologia non possa essere utilizzata in modo intrusivo, né fornire suoni a un pubblico riluttante."

Thomas Graham, il ricercatore della Scuola di Ingegneria e Informatica che esegue le misurazioni e le simulazioni, dice:"Nel nostro studio, ci siamo ispirati alle fotocamere con zoom automatico che estendono i loro obiettivi in modo che corrispondano alla distanza di un bersaglio.

"Abbiamo usato un sistema molto simile, con anche lo stesso suono meccanico del motore. Credo che il nostro lavoro sia anche il primo passo verso il palmare, telecamere acustiche a basso costo."

Il team di ricerca sta ora lavorando per espandere le capacità del sistema oltre il tracciamento per una sola direzione e oltre un'ottava, per garantire che possa essere ampliato per coprire la maggior parte del parlato e delle melodie di base e alla fine per fornire un brano musicale completo.

Arash Pour Yazdan, chi ha progettato l'elettronica, ha dichiarato:"SIGGRAPH è un luogo in cui si discutono idee emergenti e futuristiche. Questa è la conferenza in cui giganti dell'intrattenimento come Disney, Marvel e Microsoft si incontrano per condividere le loro visioni:è stato il luogo perfetto per dimostrare come pensiamo che il suono possa essere gestito in futuro".