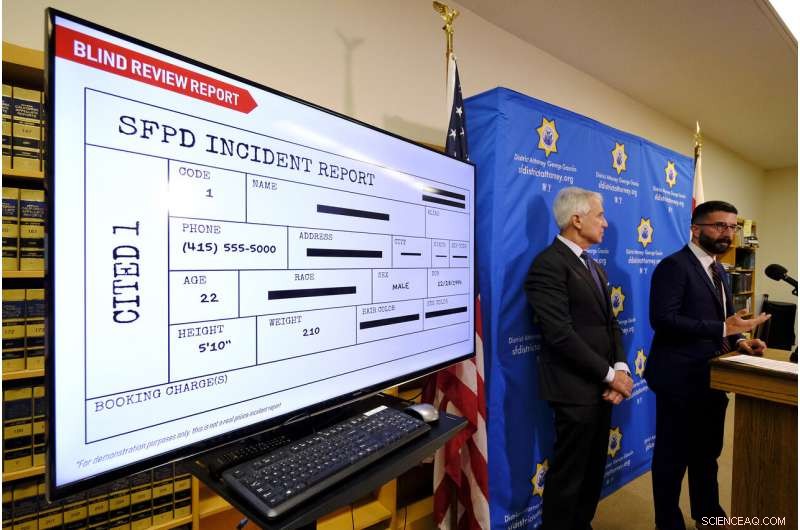

Con un rapporto su un incidente di polizia non vedente visualizzato, Il procuratore distrettuale di San Francisco George Gascon, sinistra, e Alex Chohlas-Wood, Vicedirettore, Laboratorio di politica computazionale di Stanford, parlare dell'implementazione di uno strumento di intelligenza artificiale per rimuovere potenziali distorsioni nelle decisioni di addebito, durante una conferenza stampa mercoledì, 12 giugno 2019, a San Francisco. In un esperimento unico nel suo genere, I pubblici ministeri di San Francisco si stanno rivolgendo all'intelligenza artificiale per ridurre i pregiudizi nei tribunali penali. (Foto AP/Eric Risberg)

In un esperimento unico nel suo genere, I pubblici ministeri di San Francisco si stanno rivolgendo all'intelligenza artificiale per ridurre i pregiudizi razziali nei tribunali, adottando un sistema che elimini alcuni dettagli identificativi dai verbali di polizia e lasci solo i fatti chiave per governare le decisioni di addebito.

Il procuratore distrettuale George Gascon ha annunciato mercoledì che il suo ufficio inizierà a utilizzare la tecnologia a luglio per "togliere la razza dall'equazione" al momento di decidere se accusare i sospetti di un crimine.

Gli esperti di giustizia penale affermano di non aver mai sentito parlare di un progetto simile, e hanno applaudito l'idea come un creativo, sforzo coraggioso per rendere le pratiche di ricarica più daltoniche.

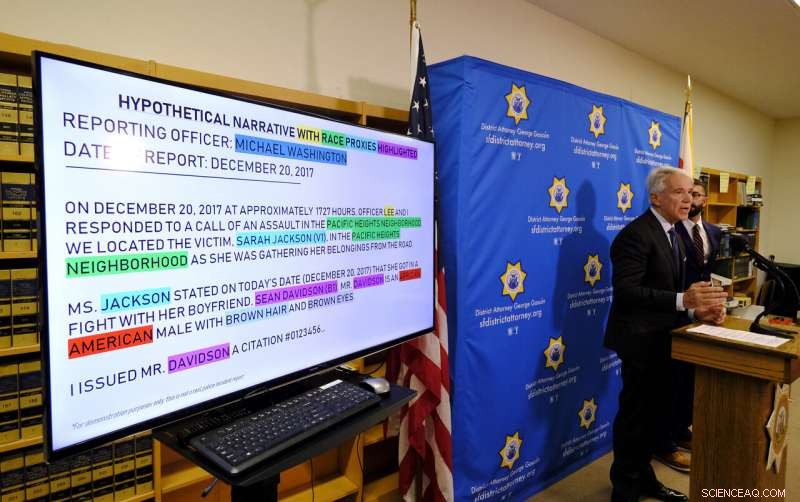

L'ufficio di Gascon ha lavorato con scienziati e ingegneri di dati presso lo Stanford Computational Policy Lab per sviluppare un sistema che accetta i rapporti elettronici della polizia e rimuove automaticamente il nome di un sospetto, razza e colore dei capelli e degli occhi. Saranno rimossi anche i nomi dei testimoni e degli agenti di polizia, insieme a specifici quartieri o contrade che potrebbero indicare la razza dei soggetti coinvolti.

"Il sistema di giustizia penale ha avuto un impatto orribile sulle persone di colore in questo paese, soprattutto afroamericani, per generazioni, "Gascone ha detto in un'intervista prima dell'annuncio. "Se tutti i pubblici ministeri hanno tolto la corsa dall'immagine quando hanno preso decisioni sulle accuse, probabilmente saremmo in un posto molto migliore come nazione di quello che siamo oggi".

Con un ipotetico rapporto di polizia visualizzato, Il procuratore distrettuale di San Francisco George Gascon parla dell'implementazione di uno strumento di intelligenza artificiale per rimuovere il potenziale di parzialità nelle decisioni di addebito durante una conferenza stampa mercoledì, 12 giugno 2019, a San Francisco. In un esperimento unico nel suo genere, I pubblici ministeri di San Francisco si stanno rivolgendo all'intelligenza artificiale per ridurre i pregiudizi nei tribunali penali. Stanno adottando un sistema che rimuove alcuni dettagli identificativi dai rapporti della polizia e lascia solo i fatti chiave per governare le decisioni di addebito. Gascon ha annunciato che il suo ufficio inizierà a utilizzare la tecnologia a luglio per "togliere la razza dall'equazione" al momento di decidere se accusare i sospetti di un crimine. (Foto AP/Eric Risberg)

Gascon ha affermato che il suo obiettivo era sviluppare un modello che potesse essere utilizzato altrove, e la tecnologia sarà offerta gratuitamente ad altri pubblici ministeri in tutto il paese.

"Li raccomando davvero, è una mossa coraggiosa, "ha detto Lucy Lang, un ex procuratore della città di New York e direttore esecutivo dell'Institute for Innovation in Prosecution presso il John Jay College of Criminal Justice.

La tecnologia si affida agli esseri umani per raccogliere i fatti iniziali, che può ancora essere influenzato da pregiudizi razziali. I pubblici ministeri prenderanno una prima decisione di accusa sulla base del rapporto redatto dalla polizia. Quindi esamineranno l'intero rapporto, con dettagli restaurati, per vedere se ci sono motivi attenuanti per riconsiderare la prima decisione, ha detto Guascone.

Lang e altri esperti hanno affermato che non vedono l'ora di vedere i risultati e che si aspettano che il sistema sia un work in progress.

Il procuratore distrettuale di San Francisco George Gascon, sinistra, annuncia l'implementazione di uno strumento di intelligenza artificiale per rimuovere il potenziale di parzialità nelle decisioni di addebito come Alex Chohlas-Wood, Vicedirettore, Laboratorio di politica computazionale di Stanford, ascolta durante una conferenza stampa mercoledì, 12 giugno 2019, a San Francisco. In un esperimento unico nel suo genere, I pubblici ministeri di San Francisco si stanno rivolgendo all'intelligenza artificiale per ridurre i pregiudizi nei tribunali penali. (Foto AP/Eric Risberg)

Il procuratore distrettuale di San Francisco George Gascon, sinistra, annuncia l'implementazione di uno strumento di intelligenza artificiale per rimuovere il potenziale di parzialità nelle decisioni di addebito come Alex Chohlas-Wood, Vicedirettore, Laboratorio di politica computazionale di Stanford, ascolta durante una conferenza stampa mercoledì, 12 giugno 2019, a San Francisco. In un esperimento unico nel suo genere, I pubblici ministeri di San Francisco si stanno rivolgendo all'intelligenza artificiale per ridurre i pregiudizi nei tribunali penali. (Foto AP/Eric Risberg)

In questo martedì, 16 febbraio 2016 foto d'archivio, Il procuratore distrettuale di San Francisco George Gascon è mostrato in una conferenza stampa a San Francisco, Di mercoledì, 12 giugno 2019, Gascon annuncia quello che sembra essere il primo programma del suo genere che utilizza l'intelligenza artificiale per ridurre i pregiudizi nel sistema di giustizia penale. A partire dal prossimo mese, i pubblici ministeri decideranno se incriminare un sospetto sulla base di rapporti di polizia "daltonici" in cui i nomi, la razza e altri dettagli identificativi sono stati rimossi. (Foto AP/Jeff Chiu)

"Tanto di cappello per aver provato cose nuove, " ha detto Phillip Atiba Goff, presidente del Center for Policing Equity. "Ci sono così tanti fattori contestuali che potrebbero indicare razza ed etnia che è difficile immaginare come anche un umano possa eliminarli tutti".

Uno studio del 2017 commissionato dal procuratore distrettuale di San Francisco ha rilevato "sostanziali disparità razziali ed etniche negli esiti della giustizia penale". Gli afroamericani rappresentavano solo il 6% della popolazione della contea, ma hanno rappresentato il 41% degli arresti tra il 2008 e il 2014.

Lo studio ha trovato "poche prove di pregiudizi palesi contro qualsiasi razza o gruppo etnico" tra i pubblici ministeri che processano i reati. Ma Gascon ha detto che voleva trovare un modo per aiutare a eliminare un pregiudizio implicito che potrebbe essere innescato dalla razza di un sospetto, un nome dal suono etnico o un quartiere pieno di criminalità dove sono stati arrestati.

Dopo che inizia, il programma sarà rivisto settimanalmente, disse Maria Mckee, il direttore dell'analisi e della ricerca del DA.

La mossa arriva dopo che San Francisco il mese scorso è diventata la prima città degli Stati Uniti a vietare l'uso del riconoscimento facciale da parte della polizia e di altre agenzie cittadine. La decisione riflette un crescente contraccolpo contro la tecnologia AI mentre le città cercano di regolamentare la sorveglianza da parte delle agenzie municipali.

© 2019 The Associated Press. Tutti i diritti riservati.