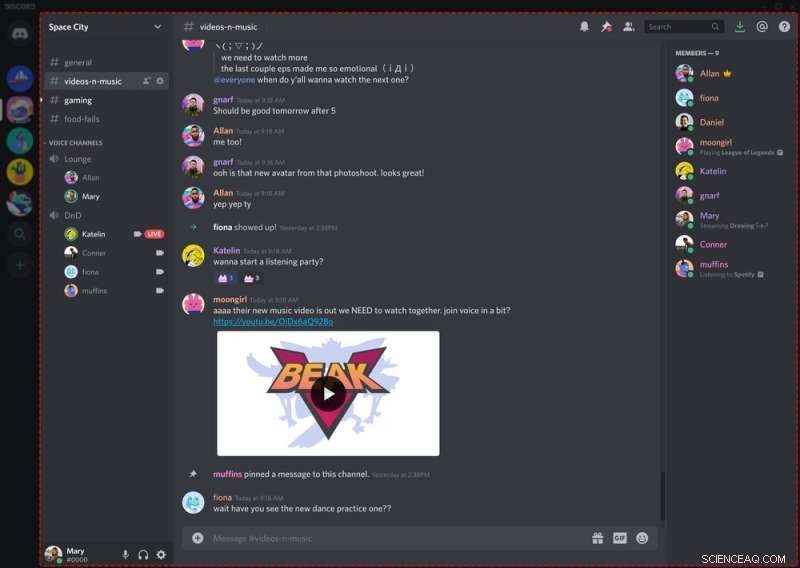

Discord è un altro modo in cui le persone possono riunirsi e comunicare online. Credito:Discordia

Sin dai primi giorni di Internet negli anni '80, collegarsi online ha significato essere coinvolti in una comunità. Inizialmente, c'erano server di chat dial-up, elenchi di e-mail e gruppi di discussione basati su testo incentrati su interessi specifici.

Dall'inizio degli anni 2000, le piattaforme di social media di appello di massa hanno raccolto questi piccoli spazi in spazi più grandi, consentendo alle persone di trovare i propri piccoli angoli di Internet, ma solo con interconnessioni con gli altri. Ciò consente ai siti di social media di suggerire nuovi spazi a cui gli utenti possono unirsi, che si tratti di una discussione di quartiere locale o di un gruppo con lo stesso hobby, e di vendere pubblicità mirata. Ma la comunità di nicchia dei piccoli gruppi sta tornando con gli adulti, i bambini e gli adolescenti.

Quando Discord è stato inizialmente rilasciato nel 2015, molti videogiochi non consentivano ai giocatori di parlare tra loro utilizzando la chat vocale dal vivo durante il gioco, o richiedevano loro di pagare prezzi premium per farlo. Discord era un'app che consentiva la chat vocale e di testo in tempo reale, in modo che gli amici potessero allearsi per superare un ostacolo o semplicemente chattare mentre esploravano un mondo di gioco. Le persone usano ancora Discord per questo, ma al giorno d'oggi la maggior parte dell'attività sul servizio fa parte di una comunità più ampia di un paio di amici che si incontrano per giocare.

Examining Discord fa parte della mia ricerca su come studiosi, sviluppatori e responsabili politici potrebbero progettare e mantenere spazi online sani.

Un po' vecchia scuola

Discord è apparso per la prima volta nel mio radar nel 2017, quando un conoscente mi ha chiesto di unirmi al gruppo di supporto di uno scrittore. Gli utenti di Discord possono creare le proprie comunità, chiamate server, con collegamenti condivisibili a cui partecipare e scegliere se il server è pubblico o privato.

Il server del gruppo dello scrittore sembrava una chat room della vecchia scuola, ma con più canali che segmentavano le diverse conversazioni che le persone stavano avendo. Mi ha ricordato le descrizioni delle prime chat online e delle comunità basate su forum che ospitavano lunghe conversazioni tra persone di tutto il mondo.

Le persone nel server degli autori si sono subito rese conto che alcuni membri della nostra comunità erano adolescenti di età inferiore ai 18 anni. Sebbene il proprietario del server avesse mantenuto lo spazio solo su invito, ha evitato di dire "no" a chiunque avesse richiesto l'accesso. Dopotutto, doveva essere una comunità di supporto per le persone che lavoravano a progetti di scrittura. Perché dovrebbe voler escludere qualcuno?

Non voleva cacciare gli adolescenti, ma è stato in grado di apportare alcune modifiche utilizzando il sistema di moderazione del server di Discord. I membri della comunità dovevano rivelare la propria età ea chiunque avesse meno di 18 anni veniva assegnato un "ruolo" speciale che li etichettava come minorenne. Quel ruolo ha impedito loro di accedere ai canali che abbiamo contrassegnato come "non sicuri per il lavoro" o "NSFW". Alcuni degli scrittori stavano lavorando su romanzi rosa espliciti e non volevano sollecitare feedback dagli adolescenti. E a volte, gli adulti volevano solo avere il proprio spazio.

Mentre ci siamo occupati di costruire uno spazio online sicuro per gli adolescenti, ci sono ancora dei pericoli presenti con un'app come Discord. La piattaforma è criticata per la mancanza di controllo parentale. I termini del servizio stabiliscono che nessuno sotto i 13 anni dovrebbe iscriversi a Discord, ma molti giovani utilizzano la piattaforma a prescindere.

Inoltre, ci sono persone che hanno usato Discord per organizzare e incoraggiare la retorica odiosa, comprese le ideologie neonaziste. Altri hanno utilizzato la piattaforma per il traffico di materiale pedopornografico.

Tuttavia, Discord sostiene che questo tipo di attività è illegale e sgradito sulla sua piattaforma, e la società vieta regolarmente server e utenti che afferma perpetuano il danno.

Opzioni per la sicurezza

Ogni server Discord a cui mi sono unito da allora ha avuto una certa protezione sui giovani e sui contenuti inappropriati. Che si tratti di canali soggetti a limiti di età o semplicemente di rifiutarsi di consentire ai minori di unirsi a determinati server, le comunità di Discord a cui partecipo condividono un'accresciuta preoccupazione per la sicurezza dei giovani su Internet.

Tuttavia, ciò non significa che ogni server Discord sarà sempre al sicuro per i suoi membri. I genitori dovrebbero comunque prendersi il tempo per parlare con i propri figli di ciò che stanno facendo nei loro spazi online. Anche qualcosa di innocuo come il popolare ambiente di gioco per bambini Roblox può andare male nell'ambiente giusto.

E mentre i server in cui sono stato coinvolto sono stati gestiti con cura, non tutti i server Discord sono regolati in questo modo. Oltre ai server privi di una regolamentazione uniforme, i proprietari di account possono mentire sulla loro età e identità quando si registrano per un account. E ci sono nuovi modi per gli utenti di comportarsi male o infastidire gli altri su Discord, come lo spamming di audio rumoroso e inappropriato.

Ma, come con altre moderne piattaforme di social media, esistono misure di sicurezza per aiutare gli amministratori a mantenere le comunità online sicure per i giovani, se lo desiderano. I membri del server possono etichettare un intero server "NSFW", andando oltre le etichette di canale singolo e bloccando account minori da intere comunità. Ma se non lo fanno, i funzionari dell'azienda possono farlo da soli. Quando si accede a Discord su un dispositivo iOS, i server NSFW non sono visibili a nessuno, nemmeno agli account appartenenti a persone adulte. Inoltre, Discord gestisce una Moderator Academy per supportare la formazione di moderatori volontari in grado di gestire in modo appropriato un'ampia gamma di situazioni.

Controlli più forti

A differenza di molte altre popolari piattaforme di social media attuali, i server Discord spesso funzionano come comunità chiuse, con inviti necessari per partecipare. Ci sono anche grandi server aperti invasi da milioni di utenti, ma il design di Discord integra strumenti di moderazione dei contenuti per mantenere l'ordine.

Ad esempio, un creatore di server ha uno stretto controllo su chi ha accesso a cosa e quali autorizzazioni può avere ogni membro del server per inviare, eliminare o gestire i messaggi. In addition, Discord allows community members to add automations to a server, continuously monitoring activity to enforce moderation standards.

With these protections, people use servers to form tight-knit, closed spaces safe from chaotic public squares like Twitter and less visible to the wider online world. This can be positive, keeping spaces safer from bullies, trolls and disinformation spreaders. In my own research, young people have mentioned their Discord servers as the safe, private space they have online in contrast to messy public platforms.

However, moving online activity to more private spaces also means that those well-regulated, healthy communities are less discoverable for vulnerable groups that might need them. For example, new fathers looking for social support are sometimes more inclined to access it through open subreddits rather than Facebook groups.

Discord's servers are not the first closed communities on the internet. They are, essentially, the same as old-school chat rooms, private blogs and curated mailing lists. They will have the same problems and opportunities as previous online communities.

Discussion about self-protection

In my view, the solution to this particular problem is not necessarily banning particular practices or regulating internet companies. Research into youth safety online finds that government regulation aimed at protecting minors on social media rarely has the desired outcome, and more often results in disempowering and isolating youth instead.

Just as parents and caring adults tell the kids in their lives about recognizing dangerous situations in the physical world, talking about healthy online interactions can help young people protect themselves in the online world. Many youth-focused organizations, and many internet companies, have internet safety information aimed at kids of all ages.

Whenever young people hop onto the next technology fad, there will inevitably be panic over how the adults, companies and society may or may not be keeping young people safe. What is most important in these situations is to remember that talking to young people about how they use those technologies, and what to do in difficult situations, can be an effective way to help them avoid serious harm online.