Studio di algoritmi e trasparenza algoritmica da più livelli di analisi. Credito:politica dell'informazione.

L'uso di algoritmi nel governo sta trasformando il modo in cui i burocrati lavorano e prendono decisioni in diverse aree, come l'assistenza sanitaria o la giustizia penale. Gli esperti affrontano le sfide di trasparenza dell'utilizzo di algoritmi nelle procedure decisionali a livello macro, meso-, e micro-livelli in questo numero speciale di Politica delle informazioni .

Gli algoritmi di apprendimento automatico hanno un enorme potenziale per rendere i servizi governativi più equi ed efficaci e hanno il potenziale di "liberare" il processo decisionale dalla soggettività umana, secondo recenti ricerche. Gli algoritmi sono utilizzati in molti contesti di servizio pubblico. Per esempio, all'interno del sistema giuridico è stato dimostrato che gli algoritmi possono prevedere la recidiva meglio dei giudici dei tribunali penali. Allo stesso tempo, i critici evidenziano diversi pericoli del processo decisionale algoritmico, come pregiudizi razziali e mancanza di trasparenza.

Alcuni studiosi hanno sostenuto che l'introduzione di algoritmi nelle procedure decisionali può causare profondi cambiamenti nel modo in cui i burocrati prendono le decisioni e che gli algoritmi possono influenzare routine e strutture organizzative più ampie. Questo numero speciale sulla trasparenza degli algoritmi presenta sei contributi per affinare la nostra comprensione concettuale ed empirica dell'uso degli algoritmi nel governo.

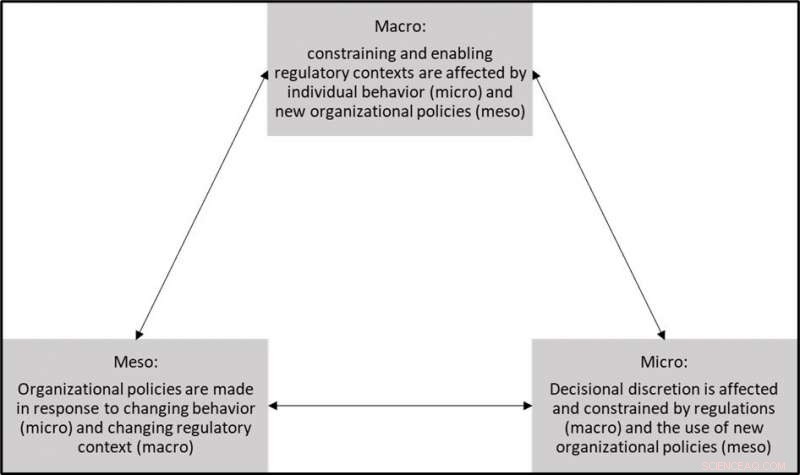

"C'è stata un'ondata di critiche verso la 'scatola nera' del processo decisionale algoritmico nel governo, " spiegano i Guest Editor Sarah Giest (Leiden University) e Stephan Grimmelikhuijsen (Utrecht University). "In questa raccolta di numeri speciali, dimostriamo che non basta spacchettare i dettagli tecnici degli algoritmi, ma guarda anche alle istituzioni, organizzativo, e contesto individuale all'interno del quale questi algoritmi operano per capire veramente come possiamo ottenere algoritmi trasparenti e responsabili nel governo. Per esempio, i regolamenti possono consentire meccanismi di trasparenza, eppure le organizzazioni creano nuove politiche su come dovrebbero essere usati gli algoritmi, e i singoli dipendenti pubblici creano nuovi repertori professionali. Tutti questi livelli interagiscono e influenzano la trasparenza algoritmica nelle organizzazioni pubbliche".

Le sfide alla trasparenza per l'uso degli algoritmi trascendono i diversi livelli di governo, dal livello europeo ai singoli burocrati pubblici. Queste sfide possono anche assumere forme diverse; la trasparenza può essere abilitata o limitata da strumenti tecnici, linee guida normative o politiche organizzative. Gli articoli in questo numero affrontano le sfide della trasparenza dell'uso degli algoritmi a livello macro, meso-, e microlivello. Il livello macro descrive i fenomeni da una prospettiva istituzionale:quali sistemi nazionali, le normative e le culture giocano un ruolo nel processo decisionale algoritmico. Il meso-livello presta principalmente attenzione al livello organizzativo e di squadra, mentre il livello micro si concentra sugli attributi individuali, come credenze, motivazione, interazioni, e comportamenti.

"Gli appelli a 'mantenere gli esseri umani nel giro' possono essere punti controversi se non riusciamo a capire come gli algoritmi influenzano il processo decisionale umano e come la progettazione algoritmica influisce sulle possibilità pratiche di trasparenza e discrezione umana, " nota Rik Peeters, professore di ricerca di Pubblica Amministrazione presso il Center for Research and Teaching in Economics (CIDE) di Città del Messico. In una revisione della recente letteratura accademica sulla dinamica a microlivello dei sistemi algoritmici, discute tre variabili di progettazione che determinano le precondizioni per la trasparenza e la discrezione umane e identifica quattro principali fonti di variazione nell'"interazione uomo-algoritmo".

L'articolo trae due conclusioni principali:in primo luogo, gli agenti umani sono raramente completamente "fuori dal giro, " e i livelli di supervisione e override progettati negli algoritmi dovrebbero essere intesi come un continuum. Il secondo riguarda la razionalità limitata, comportamento soddisfacente, bias di automazione, e meccanismi di coping in prima linea che giocano un ruolo cruciale nel modo in cui gli esseri umani usano gli algoritmi nei processi decisionali.

Per la ricerca futura, il dott. Peeters suggerisce di esaminare più da vicino i meccanismi comportamentali in combinazione con l'identificazione delle competenze rilevanti dei burocrati nel trattare con gli algoritmi. "Senza una conoscenza di base degli algoritmi con cui devono lavorare i burocrati dello schermo e della strada, è difficile immaginare come possano usare correttamente la loro discrezione e valutare criticamente procedure e risultati algoritmici. I professionisti dovrebbero avere una formazione sufficiente per supervisionare gli algoritmi con cui stanno lavorando".

A livello macro, gli algoritmi possono essere uno strumento importante per consentire la trasparenza istituzionale, scrive Alex Ingrams, dottorato di ricerca, Governance e affari globali, Istituto della Pubblica Amministrazione, Università di Leida, Leida, Paesi Bassi. Questo studio valuta un approccio di apprendimento automatico per aprire commenti pubblici per la creazione di politiche per aumentare la trasparenza istituzionale del commento pubblico in un processo legislativo negli Stati Uniti. L'articolo applica un'analisi di apprendimento automatico non supervisionata di migliaia di commenti pubblici inviati all'Amministrazione per la sicurezza dei trasporti degli Stati Uniti su una proposta di regolamento del 2013 per l'uso di nuovi scanner di imaging per tutto il corpo negli aeroporti. L'algoritmo evidenzia i cluster di argomenti salienti nei commenti pubblici che potrebbero aiutare i responsabili delle politiche a comprendere i processi aperti dei commenti pubblici. "Gli algoritmi non dovrebbero essere soggetti solo alla trasparenza, ma possono anche essere utilizzati come strumento di trasparenza nel processo decisionale del governo, " commenta il dottor Ingrams.

"La certezza normativa in combinazione con la capacità organizzativa e gestionale guiderà il modo in cui la tecnologia viene sviluppata e utilizzata e quali meccanismi di trasparenza sono in atto per ogni fase, " notano i Guest Editors. "Da soli questi sono problemi più grandi da affrontare in termini di sviluppo e approvazione di leggi o fornitura di formazione e orientamento per dirigenti pubblici e burocrati. Il fatto che siano collegati complica ulteriormente questo processo. Evidenziare questi collegamenti è un primo passo per vedere il quadro più ampio del motivo per cui i meccanismi di trasparenza sono messi in atto in alcuni scenari e non in altri e apre la porta ad analisi comparative per ricerche future e nuove intuizioni per i responsabili politici. Per sostenere l'uso responsabile e trasparente degli algoritmi, la ricerca futura dovrebbe esaminare l'interazione tra micro, meso-, e dinamiche a livello macro”.

"Siamo orgogliosi di presentare questo numero speciale, il centesimo numero di Politica delle informazioni . La sua attenzione alla governance dell'IA dimostra il nostro continuo desiderio di affrontare le questioni contemporanee nell'eGovernment e l'importanza di mostrare ricerche eccellenti e le intuizioni offerte dalle prospettive della politica dell'informazione, " aggiungono il professor Albert Meijer (Università di Utrecht) e il professor William Webster (Università di Stirling), Caporedattori.