Dal lancio del vaccino contro il COVID-19 nel 2021, le fake news sui social media sono state ampiamente accusate della bassa diffusione del vaccino negli Stati Uniti, ma una ricerca del MIT Sloan School of Management Ph.D. la candidata Jennifer Allen e il professor David Rand ritengono che la colpa sia altrove.

In un nuovo articolo pubblicato su Science e coautori di Duncan J. Watts dell'Università della Pennsylvania, i ricercatori introducono una nuova metodologia per misurare l'impatto causale dei contenuti dei social media su larga scala. Dimostrano che i contenuti fuorvianti provenienti dalle principali fonti di notizie, piuttosto che la vera e propria disinformazione o "notizie false", sono stati il principale motore dell'esitazione nei confronti dei vaccini su Facebook.

"La disinformazione è stata correlata a molte sfide sociali, ma non ci sono molte ricerche che dimostrano che l'esposizione alla disinformazione causa effettivamente danni", ha spiegato Allen.

Durante la pandemia di COVID-19, ad esempio, la diffusione della disinformazione relativa al virus e al vaccino ha ricevuto una notevole attenzione da parte del pubblico. Tuttavia, la ricerca esistente ha, per la maggior parte, stabilito solo correlazioni tra il rifiuto del vaccino e fattori come la condivisione di disinformazione online, e ha ampiamente trascurato il ruolo dei contenuti "scettici sui vaccini", che erano potenzialmente fuorvianti ma non contrassegnati come disinformazione da Facebook. -dama.

Per colmare questa lacuna, i ricercatori hanno innanzitutto posto una domanda chiave:cosa sarebbe necessario affinché la disinformazione o qualsiasi altro tipo di contenuto avesse un impatto di vasta portata?

"Per cambiare il comportamento su larga scala, i contenuti non devono solo essere sufficientemente persuasivi da convincere le persone a non vaccinarsi, ma devono anche essere ampiamente visti", ha affermato Allen. "Il danno potenziale deriva dalla combinazione di persuasione ed esposizione."

Per quantificare la capacità persuasiva del contenuto, i ricercatori hanno condotto esperimenti randomizzati in cui hanno mostrato a migliaia di partecipanti al sondaggio i titoli di 130 storie relative ai vaccini – inclusi sia contenuti mainstream che disinformazione nota – e hanno testato come tali titoli hanno influenzato le loro intenzioni di vaccinarsi contro il COVID-19. 19.

I ricercatori hanno anche chiesto a un gruppo separato di intervistati di valutare i titoli in base a vari attributi, tra cui plausibilità e inclinazione politica. Un fattore ha previsto in modo affidabile gli impatti sulle intenzioni di vaccinazione:la misura in cui un titolo suggeriva che il vaccino fosse dannoso per la salute di una persona.

Utilizzando la "saggezza della folla" e gli strumenti di intelligenza artificiale per l'elaborazione del linguaggio naturale, Allen e i suoi coautori hanno estrapolato i risultati del sondaggio per prevedere il potere persuasivo di tutti i 13.206 URL relativi al vaccino che sono stati ampiamente visualizzati su Facebook nei primi tre mesi del vaccino. implementazione.

Combinando queste previsioni con i dati di Facebook che mostrano il numero di utenti che hanno visualizzato ciascun URL, i ricercatori hanno potuto prevedere l’impatto complessivo di ciascun titolo:il numero di persone che avrebbe potuto convincere a non vaccinarsi. I risultati sono stati sorprendenti.

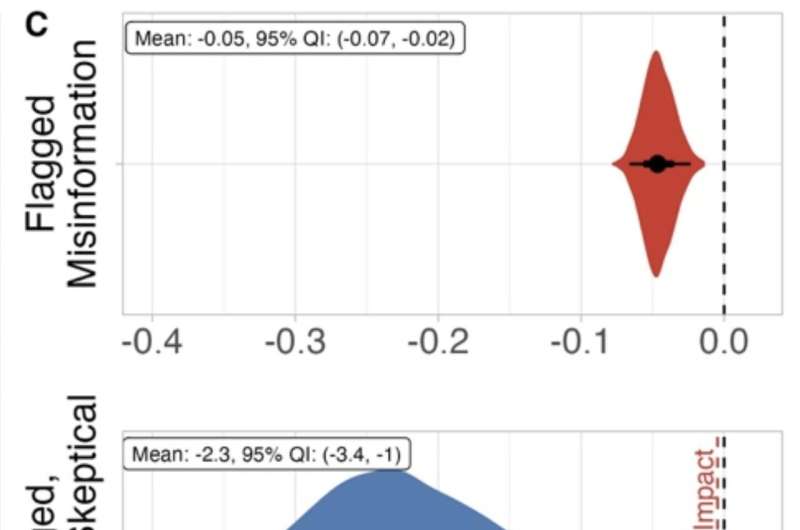

Contrariamente alla percezione popolare, i ricercatori hanno stimato che i contenuti scettici sui vaccini hanno ridotto le intenzioni di vaccinazione 46 volte di più rispetto alla disinformazione segnalata dai fact-checker.

La ragione? Anche se la disinformazione segnalata era più dannosa quando vista, aveva una portata relativamente bassa. In totale, i titoli relativi ai vaccini nel set di dati di Facebook hanno ricevuto 2,7 miliardi di visualizzazioni, ma i contenuti contrassegnati come disinformazione hanno ricevuto solo lo 0,3% di tali visualizzazioni, mentre i contenuti provenienti da domini classificati come poco credibili hanno ricevuto il 5,1%.

"Anche se il contenuto palesemente falso ha ridotto maggiormente le intenzioni di vaccinazione quando viene visualizzato, relativamente poche persone lo hanno visto", ha spiegato Rand. "In sostanza, ciò significa che esiste questa classe di contenuti della zona grigia che sono meno dannosi in termini di esposizione ma sono visti molto più spesso, e quindi complessivamente di maggiore impatto, che sono stati ampiamente trascurati sia dagli accademici che dalle società di social media."

In particolare, molti degli URL di maggior impatto all’interno del set di dati erano articoli provenienti da fonti tradizionali che mettevano in dubbio la sicurezza del vaccino. Ad esempio, il più visto è stato un articolo, proveniente da una fonte di notizie mainstream molto apprezzata, che suggeriva che un medico fosse morto due settimane dopo aver ricevuto il vaccino COVID-19. Questo singolo titolo ha ricevuto 54,9 milioni di visualizzazioni, più di sei volte le visualizzazioni combinate di tutte le informazioni segnalate come disinformazione.

Sebbene il corpo di questo articolo riconoscesse l’incertezza sulla causa della morte del medico, il titolo “clickbait” era altamente indicativo e implicava che probabilmente il responsabile fosse il vaccino. Ciò è significativo poiché la stragrande maggioranza degli spettatori sui social media probabilmente non fa mai clic per leggere oltre il titolo.

Secondo Rand, un'implicazione di questo lavoro è che i media devono prestare maggiore attenzione ai titoli, anche se ciò significa che non attirano l'attenzione.

"Quando scrivi un titolo, non dovresti semplicemente chiederti se è falso o no", ha detto. "Dovresti chiederti se il titolo rischia di causare percezioni imprecise."

Per le piattaforme, ha aggiunto Allen, la ricerca sottolinea anche la necessità di una moderazione più sfumata, in tutti gli argomenti, non solo nella salute pubblica.

"La moderazione dei contenuti si concentra sull'identificazione delle informazioni più clamorosamente false, ma questo potrebbe non essere un modo efficace per identificare i contenuti complessivamente più dannosi", afferma. "Le piattaforme dovrebbero anche dare priorità alla revisione dei contenuti delle persone o delle organizzazioni con il maggior numero di follower, bilanciando al contempo la libertà di espressione. Dobbiamo investire in più ricerca e soluzioni creative in questo spazio, ad esempio strumenti di moderazione in crowdsourcing come X's Community Notes."

"Le decisioni sulla moderazione dei contenuti possono essere davvero difficili a causa della tensione intrinseca tra il voler mitigare i danni e consentire alle persone di esprimersi", ha affermato Rand. "Il nostro documento introduce un quadro per aiutare a bilanciare questo compromesso consentendo alle aziende tecnologiche di quantificare effettivamente il danno potenziale."

E i compromessi potrebbero essere grandi. Un'analisi esplorativa degli autori ha rilevato che se gli utenti di Facebook non fossero stati esposti a questi contenuti scettici sui vaccini, ben 3 milioni di americani in più avrebbero potuto essere vaccinati.

"Non possiamo semplicemente ignorare questo contenuto dell'area grigia", ha concluso Allen. "Le vite avrebbero potuto essere salvate."